Introducción

La competencia entre laboratorios de inteligencia artificial está generando una carrera hacia la reducción de la seguridad en los modelos, lo que plantea un problema colectivo que requiere una solución regulatoria eficaz.

Análisis central

Problemas estructurales

Se identifican cuatro desafíos principales: la competencia que impulsa a los laboratorios a sacrificar seguridad, la asimetría de información entre reguladores y empresas, el problema de velocidad entre la evolución tecnológica y la legislación, y la necesidad de intervención preventiva para evitar daños irreversibles.

Modelo de autorregulación supervisada

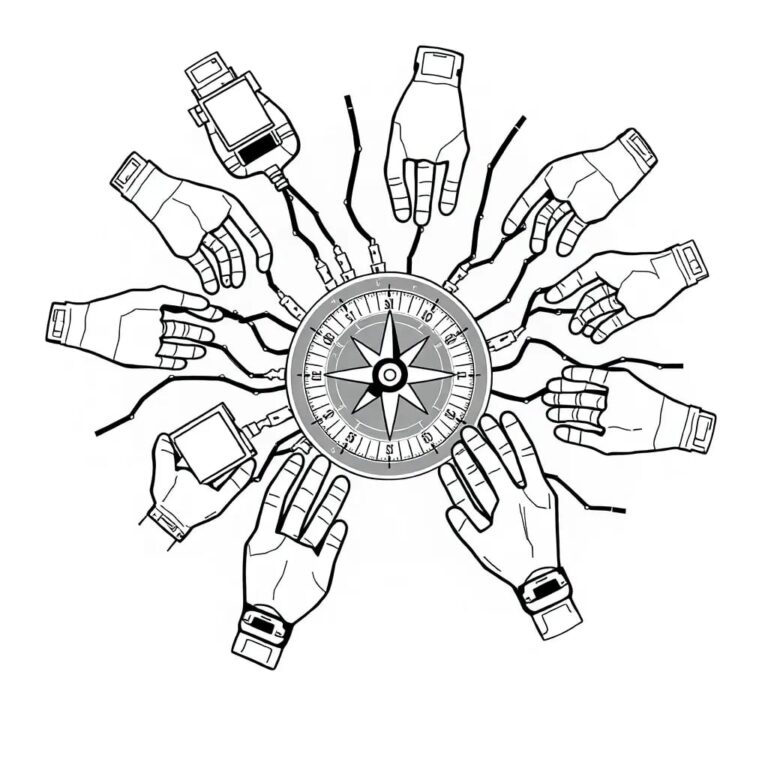

Un enfoque propuesto es adaptar el modelo de organizaciones autorreguladoras supervisadas que se utiliza en los mercados financieros. Estas entidades elaborarían normas vinculantes, sujetas a la aprobación y supervisión de una autoridad gubernamental, y financiarían sus actividades mediante cuotas de los participantes.

Ventajas del modelo

Este esquema combina la experiencia del sector con la rendición de cuentas pública, permite actualizaciones rápidas de normas para seguir el ritmo de la innovación y ofrece mecanismos de sanción como multas o suspensión de modelos que no cumplan los requisitos de seguridad.

Implicaciones y riesgos

La implementación de una organización autorreguladora en IA podría mitigar la carrera hacia la inseguridad y mejorar la disponibilidad de información crítica para la evaluación de riesgos. Sin embargo, persisten riesgos de captura por parte de la industria, la necesidad de garantizar una representación independiente adecuada y la obligación de establecer una base legal clara que evite conflictos de competencia.

Conclusión

Adaptar el modelo de autorregulación supervisada al sector de la IA ofrece una vía viable para abordar los desafíos de seguridad, asimetría de información y ritmo de cambio tecnológico. La clave del éxito radica en diseñar una estructura legal robusta, garantizar la independencia de los órganos de supervisión y asegurar la participación obligatoria de los laboratorios relevantes.