AI en 2026: Los servicios financieros avanzan, pero el riesgo y la gobernanza deben ponerse al día

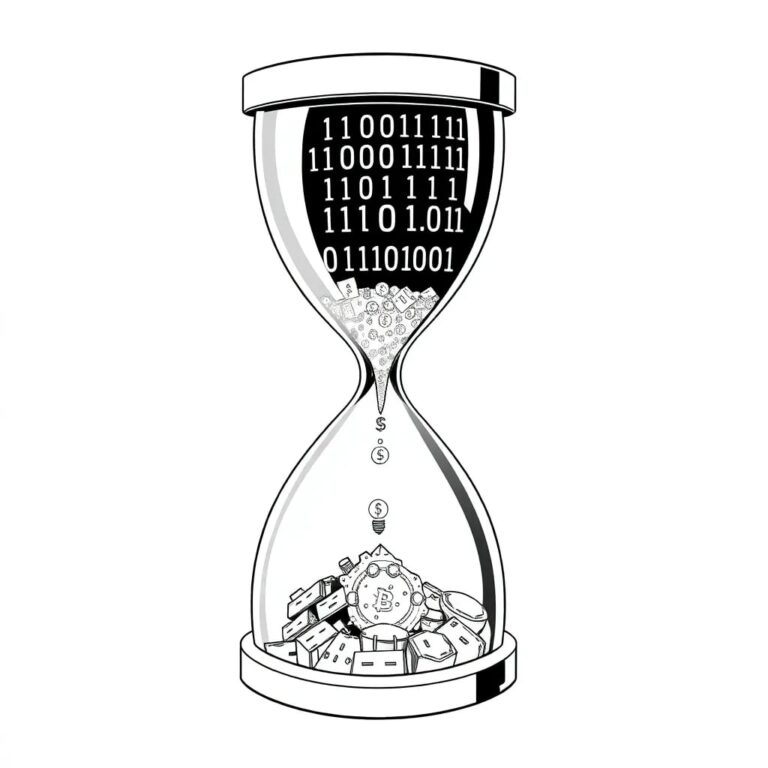

La inteligencia artificial (IA) está profundamente integrada en los servicios financieros, pero la gobernanza y la supervisión no han avanzado al mismo ritmo, creando crecientes riesgos operacionales, regulatorios y de confianza para las empresas y asesores.

A medida que avanzamos en 2026, es evidente que la IA ya no es una ambición futurista para los servicios financieros. Se ha integrado cada vez más en las operaciones diarias de bancos, aseguradoras y gestores de patrimonio, en áreas como la detección de fraudes en tiempo real y la toma de decisiones crediticias, así como en la personalización de la experiencia del cliente.

La toma de decisiones impulsada por IA

Las decisiones habilitadas por IA ahora influyen en aprobaciones de crédito, alertas de fraude, perfiles de riesgo y segmentación de clientes. A diferencia de los sistemas tradicionales, los modelos modernos son a menudo adaptativos, actualizándose a medida que llegan nuevos datos. Los controles heredados que dependen de la validación puntual y las pruebas históricas no son suficientes por sí solos. Sin supervisión continua, las empresas corren el riesgo de un deterioro del rendimiento, sesgos ocultos que afectan los resultados y decisiones difíciles de explicar a clientes o reguladores.

Más allá de la gestión de riesgos de modelos tradicionales

La gestión de riesgos de modelos tradicionales sigue siendo fundamental, pero necesita ser complementada para la IA. Las empresas deben adoptar monitoreo continuo, gobernanza del ciclo de vida y documentación rigurosa del linaje de datos, entrenamiento, pruebas y actualizaciones. Esto no solo se trata de cumplimiento; también es cuestión de resiliencia. Los modelos no monitoreados pueden degradarse silenciosamente hasta que los problemas se hacen visibles para los clientes o supervisores.

Un panorama de amenazas cibernéticas más amplio y dinámico

La IA amplía tanto la superficie de ataque como los vectores de ataque. Amenazas como el envenenamiento de datos, la inversión de modelos y los ataques de inyección de instrucciones están creciendo en sofisticación. La protección efectiva ahora requiere una combinación de disciplina en ciberseguridad y una comprensión de cómo los modelos aprenden y se comportan con el tiempo, especialmente donde están en juego los datos y la confianza de los clientes.

Responsabilidad y supervisión ética

La responsabilidad de la gobernanza de la IA se está trasladando decisivamente a las juntas y a la alta dirección, junto con los controles de ciberseguridad y financieros. Esto incluye asegurar que el personal esté capacitado no solo para usar herramientas de IA, sino también para comprender los riesgos regulatorios, reputacionales, financieros, éticos y operativos y cómo gestionarlos.

La regulación eleva el estándar

Las expectativas regulatorias se están endureciendo. La Ley de IA de la UE y los estándares emergentes están impulsando a las empresas a incorporar principios de IA responsable desde el principio, cubriendo la clasificación de riesgos, la documentación, la transparencia y el monitoreo post-mercado, en lugar de adaptar controles posteriormente.

La gobernanza como ventaja competitiva

El diferenciador en 2026 no será cuán ampliamente se despliega la IA, sino cuán inteligentemente se gobierna. Las empresas que inviertan en supervisión robusta, transparencia y marcos éticos innovarán con confianza, protegerán a los clientes y responderán de manera creíble al escrutinio regulatorio. Para los asesores y sus clientes, una gobernanza efectiva de la IA no es un tema técnico abstracto, sino fundamental para la confianza, la resiliencia y la credibilidad del asesoramiento financiero en un mundo cada vez más automatizado.