Diferencia entre el lenguaje ético y la competencia moral en la inteligencia artificial

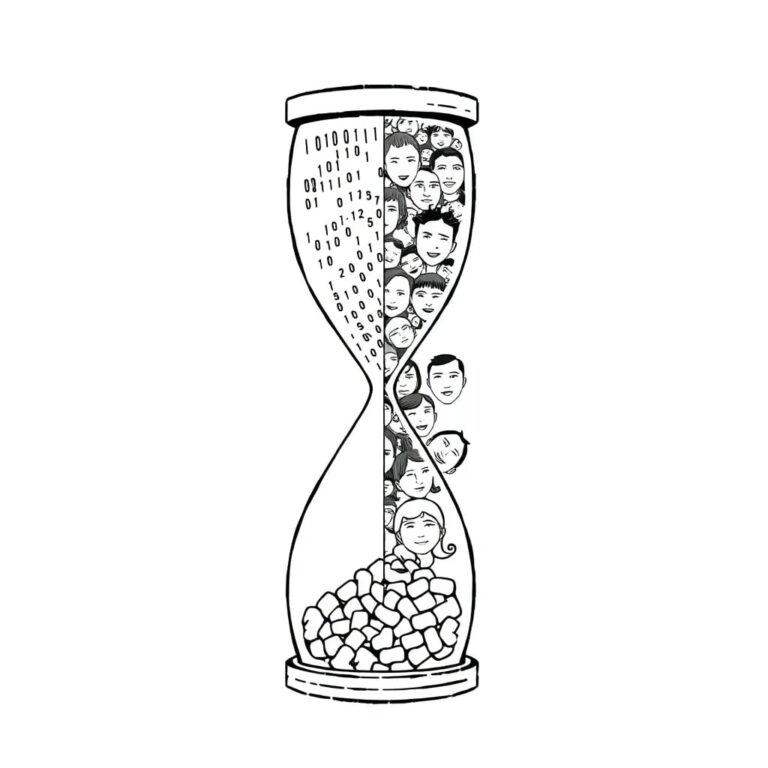

Se está destacando una distinción crítica entre la inteligencia artificial que suena ética y la que demuestra un razonamiento moral genuino, una diferencia que tiene implicaciones significativas para las aplicaciones cada vez más complejas de esta tecnología. Estudios recientes sugieren que los modelos de lenguaje grandes pueden imitar convincentemente el lenguaje ético sin poseer verdaderas competencias morales; estos sistemas sobresalen en identificar patrones estadísticos en el texto, en lugar de participar en juicios éticos razonados.

Un sistema que suena ético no es lo mismo que un sistema que razona éticamente. Investigaciones han analizado más de 300,000 conversaciones con un chatbot, identificando más de 3,300 valores distintos expresados, y encontraron que el modelo reflejaba en gran medida los valores del usuario, lo que genera preocupaciones sobre la implementación de lo que algunos expertos llaman «una función de autocompletar muy costosa» en la toma de decisiones de alto riesgo.

La capacidad de los modelos de lenguaje

Los modelos de lenguaje grandes generan texto que parece abordar dilemas éticos complejos; sin embargo, investigaciones emergentes indican que esta capacidad proviene de la predicción estadística más que de un razonamiento moral genuino. Investigaciones recientes han resaltado la distinción entre sonar éticamente y ser realmente ético, lo que lleva a la necesidad de nuevos métodos de evaluación enfocados en la «competencia moral».

La esencia de este fenómeno radica en cómo se construyen estos modelos; predicen la palabra siguiente más probable basada en patrones aprendidos de grandes conjuntos de datos de texto y código. Este proceso, aunque efectivo para imitar el discurso ético humano, no implica la comprensión de los principios subyacentes.

Implicaciones y riesgos

La investigación ha revelado que cuando se les presenta conceptos como la construcción de comunidad o el crecimiento personal, los chatbots frecuentemente refuerzan esos temas. Sin embargo, la resistencia del sistema a las solicitudes de los usuarios es rara, ocurriendo en aproximadamente el 3% de las interacciones, típicamente en situaciones donde se solicita generar contenido dañino.

La creciente sofisticación de los modelos de lenguaje grandes plantea un desafío crítico; aunque son capaces de generar texto alineado éticamente, estos sistemas pueden carecer de verdaderas capacidades de razonamiento moral. Esto plantea preocupaciones sobre su implementación en procesos de toma de decisiones de alto riesgo. Es cada vez más evidente la necesidad de sistemas capaces de formalizar reglas éticas, no solo de modelado de lenguaje predictivo.

Conclusión

Es fundamental promover un enfoque que no solo se centre en la generación de respuestas que suenen éticamente correctas, sino que también busque demostrar una verdadera «competencia moral». Esto implica un cambio hacia sistemas construidos sobre marcos éticos formales, asegurando que la inteligencia artificial sea utilizada de manera responsable y que enriquezca la comprensión humana en lugar de reemplazarla.