Riesgo sin fronteras: el uso malicioso de la IA y el alcance global de la Ley de IA de la UE

Mensajes clave

La Ley de Inteligencia Artificial (IA) de la UE es una de las primeras regulaciones vinculantes sobre IA en todo el mundo. Los responsables políticos de la UE pretendían que sirviera como un modelo para la gobernanza global de la IA, apoyándose en el llamado Efecto Bruselas.

En un ámbito tan dinámico y transformador como la IA, la calidad regulatoria es un requisito previo para influir como modelo. Esta calidad incluye proporcionar una cobertura adecuada de los riesgos más críticos asociados con el uso, despliegue y adopción de la IA.

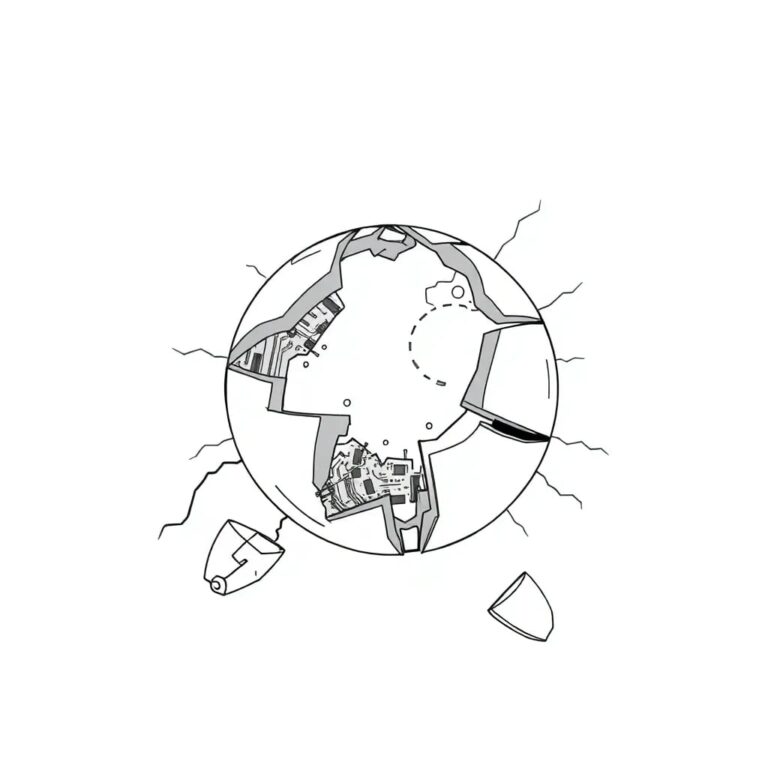

Entre esos riesgos se encuentra el uso malicioso, que surge del uso intencionado de las capacidades de la IA para causar daño. Este análisis evalúa las disposiciones de la Ley de IA frente a los riesgos de uso malicioso.

Análisis

Los esfuerzos de seguridad de la IA ante presiones competitivas son cruciales en el actual panorama geopolítico, donde la carrera por el dominio de la IA se centra más en el liderazgo tecnológico que en la seguridad y gestión de riesgos. Esto se refleja en las políticas, inversiones y avances científicos de los actores geopolíticos clave.

La Ley de IA de la UE destaca al ser una de las primeras regulaciones vinculantes. A diferencia de otros gobiernos, la Ley de IA regula casos de uso concretos según su riesgo anticipado. Sin embargo, su cobertura de los riesgos de uso malicioso es desigual.

Desigualdades en la cobertura de riesgos de uso malicioso

La cobertura de los riesgos de uso malicioso en la Ley de IA es desigual. Cuatro sub-riesgos no reciben cobertura directa, mientras que otros cuatro son abordados solo de manera parcial o indirecta. Solo uno está sujeto a prohibiciones y salvaguardas extensas.

Los riesgos de armas biológicas, IA rebeldes, armas autónomas y concentración de poder no están regulados. Por otro lado, los riesgos de desinformación, contenido falso y engaños, y ofensas cibernéticas son solo parcialmente abordados.

Limitaciones de diseño de la Ley de IA

La cobertura desigual de riesgos en la Ley de IA se debe a su diseño, que busca evitar redundancias en la regulación. Esto significa que muchos de los riesgos de uso malicioso son complementados por otras leyes de la UE. Sin embargo, estas decisiones de diseño debilitan su valor como modelo global.

Además, la Ley de IA excluye el uso personal de sistemas de IA, lo que crea importantes vacíos en la cobertura de uso malicioso.

Conclusiones

A pesar de ser un paso importante para la gobernanza de la IA, el alcance y la influencia global de la Ley de IA se verán limitados tanto por obstáculos de implementación como por su diseño. Los responsables políticos de la UE deben reconocer las importantes limitaciones en la cobertura de riesgos y la necesidad de ajustes regulatorios para abordar de manera efectiva los riesgos de uso malicioso.