DOT Usará Inteligencia Artificial para Redactar Regulaciones de Seguridad, y Eso Preocupa a la Gente

Pronto, las regulaciones de seguridad que mantienen los aviones en el aire, protegen a los pasajeros de automóviles y previenen explosiones en gasoductos podrían ser redactadas por inteligencia artificial. Esto preocupa a algunas personas dentro del Departamento de Transporte, especialmente dado el enfoque en la cantidad en lugar de la calidad, con el Departamento buscando algo que sea «suficientemente bueno».

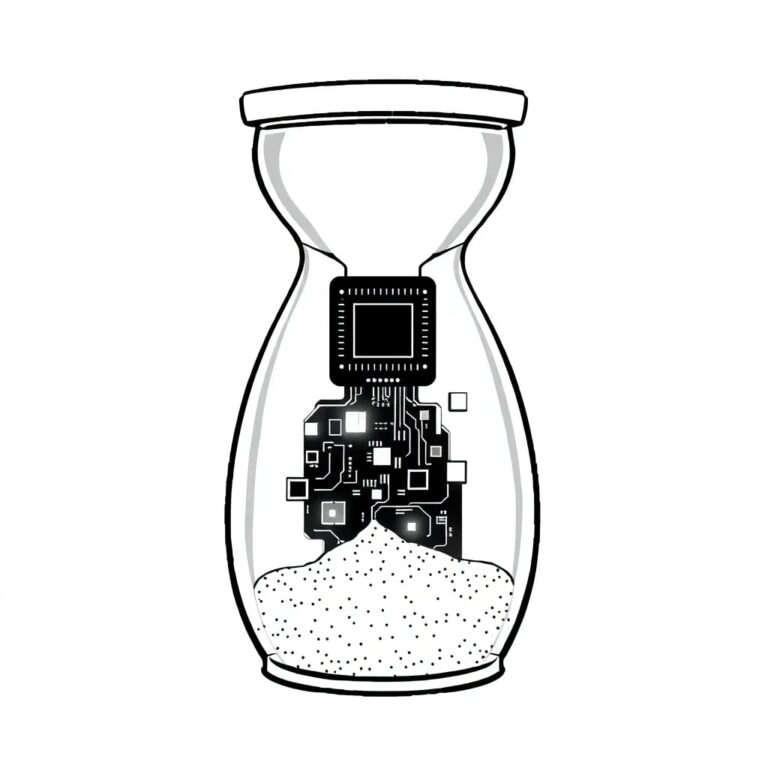

La llamada inteligencia artificial ha tocado todos los aspectos de nuestras vidas. Todo está relacionado con IA hoy en día, aunque no hay nada inteligente al respecto. El término «inteligencia artificial» casi siempre se refiere a grandes modelos de lenguaje, que son todo menos inteligentes. En cambio, son buenos para predecir qué palabra (o píxel) puede ser mejor utilizada junto a otra, analizando incontables contextos similares y qué habrían elegido los humanos.

Las «alucinaciones» de la IA son comunes, aunque las frases escritas por un chatbot parecen tener sentido al principio. Ese modelo de lenguaje no tiene absolutamente ninguna idea sobre el significado de las palabras que está generando, ni mucho menos es inteligente. A pesar de esto, los modelos de lenguaje son utilizados cada vez más por personas que son demasiado perezosas para hacer su propia investigación. La desventaja es que estas personas a menudo no tienen forma de saber si el chatbot es correcto.

Preocupaciones en el Departamento de Transporte

Esto debería explicar por qué algunas personas dentro del Departamento de Transporte están preocupadas por que ahora se quiera utilizar chatbots de IA para redactar regulaciones de seguridad en su trabajo. Los empleados temen que cualquier error de la IA pueda resultar en regulaciones defectuosas que, en el mejor de los casos, podrían llevar a litigios y demandas. En el peor de los casos, podrían resultar en lesiones y muertes en el sistema de transporte.

Durante una demostración de las capacidades de redacción de Gemini, el modelo de lenguaje produjo un documento que carecía de texto clave, que un empleado tuvo que completar. Sin embargo, el principal abogado del Departamento de Transporte no parece estar preocupado. En una reunión de diciembre, explicó que quería Gemini porque podía redactar reglas en menos de 30 minutos, en lugar de semanas o meses para asesores humanos.

«No necesitamos la regla perfecta sobre XYZ», dijo a los empleados del Departamento de Transporte en la reunión. «Ni siquiera necesitamos una regla muy buena sobre XYZ. Queremos algo suficientemente bueno.»

Implicaciones y Riesgos

Sin embargo, estas reglas afectan cada faceta de la seguridad en el transporte, y «suficientemente bueno» simplemente no es suficiente. En este caso, cualquier error podría tener serias consecuencias. Parece «extremadamente irresponsable», confesó un empleado. Entre las reglas redactadas con la ayuda de Gemini se encuentra una regla de la Administración Federal de Aviación que aún no se ha publicado.

Aparentemente, se ha solicitado que las agencias federales adopten la IA a un ritmo acelerado. Sin embargo, la redacción de leyes y regulaciones no ha sido mencionada específicamente. No obstante, el abogado del Departamento de Transporte quiere que sea «la punta de lanza» en este esfuerzo y «la primera agencia que esté completamente habilitada para usar IA en la redacción de reglas.»