La supervisión centrada en el ser humano en sistemas multi-agente es obsoleta

Introducción

Nueva investigación sobre sistemas de inteligencia artificial (IA) advierte que depender de controles centrados en el ser humano, como paneles de transparencia, herramientas de explicabilidad y supervisión basada en interfaces, produce una falsa sensación de control sobre sistemas cuyo comportamiento más significativo surge más allá de la intervención humana directa.

Por qué la gobernanza de la IA centrada en el ser humano está fallando

La mayoría de los regímenes de gobernanza de IA aún asumen que los humanos son el principal foco de agencia. Las regulaciones, pautas éticas y programas de gobernanza corporativa enfatizan la supervisión humana, el control del usuario y explicaciones posteriores a la salida del sistema. Estas herramientas son efectivas cuando los sistemas de IA funcionan como ayudas a la decisión o servicios aislados. Sin embargo, se vuelven mucho menos efectivas cuando los resultados se producen a través de interacciones máquina a máquina.

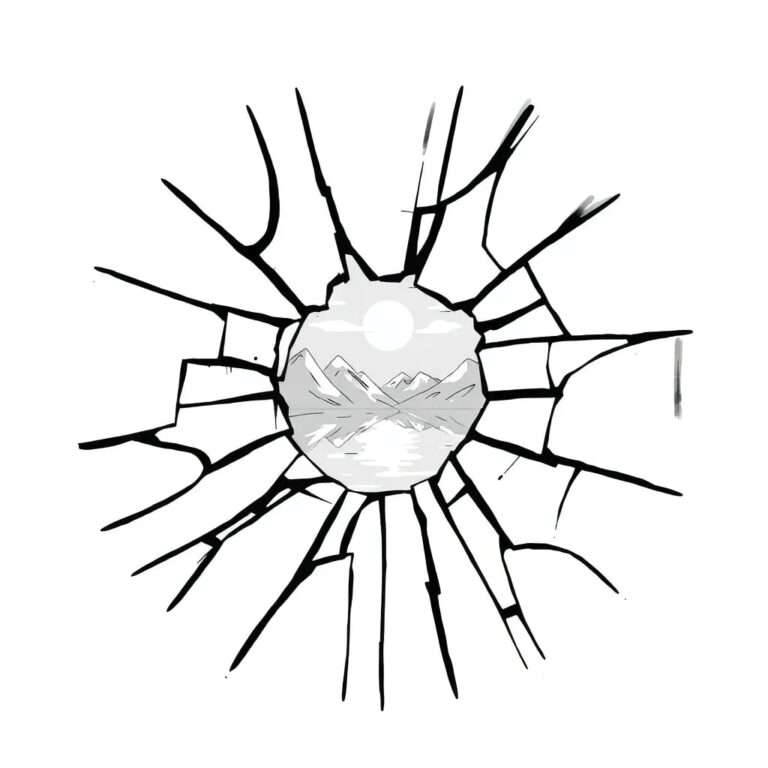

Se identifica este desajuste como un error categórico. Las herramientas de gobernanza diseñadas para la toma de decisiones individuales se aplican a sistemas donde el comportamiento emerge colectivamente. El resultado es lo que se denomina ilusiones de gobernanza. Las interfaces sugieren que los humanos están en control, mientras que la verdadera coordinación se desarrolla de manera invisible entre algoritmos.

Riesgos de coordinación en sistemas orientados a máquinas

El desafío de gobernanza se intensifica a medida que los sistemas digitales optimizan cada vez más para el consumo de máquinas en lugar de para el uso humano. El software ahora está diseñado para ser leído, analizado y actuado por otros softwares. Las API, marcos de agentes y flujos de trabajo automatizados forman redes de coordinación densas que operan continuamente y de manera autónoma.

En este entorno, los riesgos toman nuevas formas. En lugar de errores aislados, los sistemas exhiben comportamientos de descoordinación, conflictos o colusión. Los cambios pequeños en la interacción pueden desencadenar resultados a gran escala, desde inflación de precios hasta inestabilidad en el servicio o vulnerabilidades de seguridad.

Transparencia de coordinación como nuevo mecanismo de gobernanza

Para abordar estos desafíos, se introduce la transparencia de coordinación como un enfoque práctico de gobernanza diseñado para la agencia distribuida. En lugar de intentar restaurar el control humano centralizado, la transparencia de coordinación se centra en hacer que las interacciones entre agentes sean observables y dirigibles en tiempo real.

El marco consiste en cuatro componentes interconectados. Primero, el registro de interacciones y la trazabilidad capturan quién interactuó con quién, cuándo y cómo. Esto permite la reconstrucción de caminos de coordinación y apoya la responsabilidad a través de los sistemas en lugar de dentro de componentes aislados.

En segundo lugar, la monitorización de coordinación en vivo agrega datos de interacción en métricas que revelan patrones emergentes. El objetivo no es explicar decisiones individuales, sino detectar dinámicas colectivas a medida que se forman.

Tercero, los mecanismos de intervención proporcionan formas de pausar, detener o redirigir la coordinación cuando surgen riesgos. Estos controles operan a nivel de interacción, permitiendo a los operadores interrumpir patrones dañinos sin desmantelar sistemas completos o reentrenar modelos.

Cuarto, las condiciones de frontera restringen cómo se permite a los agentes interactuar. Las medidas de control como el sandboxing, límites de tasa y puertas de aprobación reducen la probabilidad de equilibrios desestabilizadores o colusivos.

Implicaciones para la regulación, la industria y la sociedad

Para los reguladores, es crucial tener acceso a registros, datos de interacción y controles de coordinación. Sin acceso de supervisión, la gobernanza permanece como algo simbólico. Construir la capacidad institucional para analizar señales de coordinación es tan crítico como redactar nuevas reglas.

Para la industria, la transparencia de coordinación redefine la seguridad y la ética como responsabilidades en tiempo real en lugar de listas de verificación previas al lanzamiento. Las prácticas de ingeniería ya apuntan en esta dirección, ya que los equipos introducen trazabilidad y controles de seguridad para estabilizar sistemas complejos.

En la sociedad, las implicaciones son altas. La coordinación de máquinas moldea resultados en mercados, atención médica, transporte y administración pública. Cuando la coordinación es opaca, la confianza se erosiona y los daños recaen desproporcionadamente en grupos ya marginados.

Conclusión

La gobernanza de IA debe evolucionar para reflejar la complejidad de la interacción entre agentes en sistemas distribuidos. La implementación de la transparencia de coordinación puede ser un paso crucial hacia una supervisión más efectiva y responsable, asegurando que los sistemas de IA beneficien a la sociedad en su conjunto.