La llegada de la Ley de IA de la UE

La Ley de IA de la UE ha entrado en vigor, y el reloj para cumplir con sus requisitos ya ha comenzado. A partir del 2 de agosto de 2025, se implementan penalizaciones, incluidas multas administrativas, para aquellos que no se adhieran a las directrices establecidas.

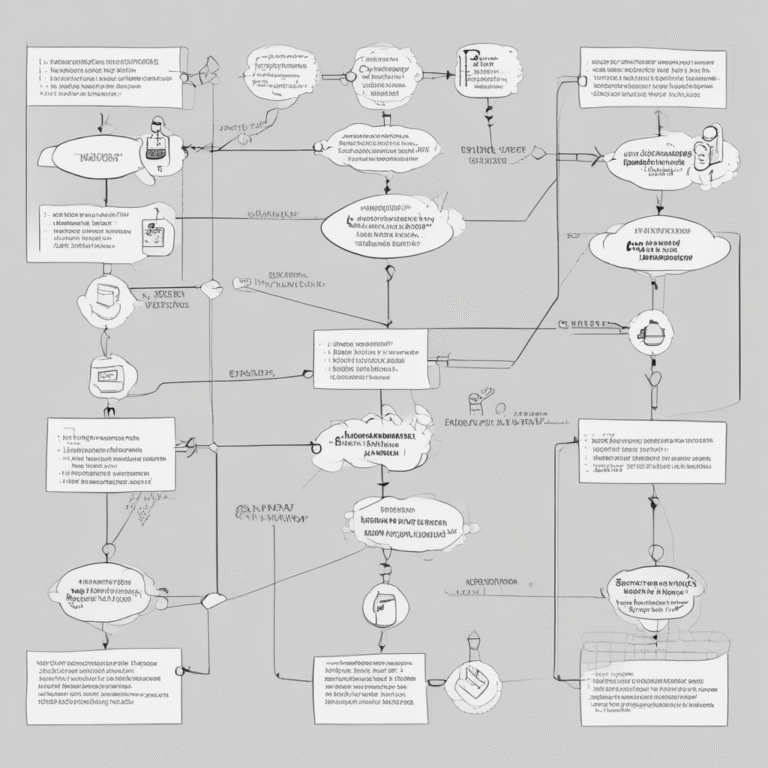

Fases de Implementación y Cumplimiento

La próxima fecha clave para los sistemas de alto riesgo, que incluyen muchos productos médicos que utilizan sistemas de inteligencia artificial (IA), es dentro de un año. Se requiere que estos sistemas cumplan con los requisitos para los productos colocados en el mercado antes del 2 de agosto de 2026.

La fecha final de implementación, el 2 de agosto de 2027, ampliará el alcance total a productos que sean un sistema de IA o donde se use un sistema de IA como componente de seguridad del producto. Esto está cubierto por ciertas legislaciones de armonización y requiere evaluaciones de conformidad de terceros, como las necesarias para obtener el CE-Mark a través de la UE MDR 2017/745 y la UE IVDR 2017/746.

¿Qué se Aplica Desde Agosto de 2025?

La ley se aplica retroactivamente a todos los modelos de IA de propósito general en uso dentro de la UE a partir del 2 de agosto de 2025. Este es el primer día de implementación que coloca muchos de los requisitos de la ley en efecto. Estos incluyen:

- Capítulo III Sección 4 para el establecimiento de autoridades notificadoras, organismos notificados y procedimientos de notificación;

- Capítulo V para los requisitos de modelos y sistemas de IA de propósito general;

- Capítulo VII para los niveles de gobernanza nacional y de la Unión;

- Capítulo XII – penalizaciones.

Los modelos de IA de propósito general en operación en la UE antes del 2 de agosto de 2025 deben completar la documentación, informes y pasos de divulgación de la ley antes del 2 de agosto de 2027. Las disposiciones de privacidad y confidencialidad del Artículo 78 también están en vigor, con penalizaciones futuras que podrían alcanzar hasta el 3% de los ingresos globales o 15 millones de euros, lo que sea mayor.

Implementación del 2 de agosto de 2026

A partir del 2 de agosto de 2026, la ley será completamente aplicable, con un período adicional de implementación para los sistemas de alto riesgo descritos en el Artículo 6.

Un sistema se clasifica como de alto riesgo si su uso previsto puede representar un alto riesgo de daño a la salud y seguridad o a los derechos fundamentales de las personas. El Artículo 2 de la ley amplía su alcance a todos los «proveedores y desplegadores» cuando los resultados de sus sistemas habilitados por IA ocurren en la UE.

Sistemas de IA de Alto Riesgo: Información Clave

Los dispositivos médicos, dispositivos de diagnóstico in vitro (IVD) y productos de atención médica con al menos un producto habilitado por IA en la UE están sujetos a esta regulación. La ley incluye todos los sistemas regulados bajo la UE MDR (2017/745) y UE IVDR (2017/746).

Es importante destacar que, aunque la ley aborda nuevos aspectos, complementará la legislación existente en lugar de duplicar todas las cargas regulatorias, permitiendo a los fabricantes de dispositivos médicos integrar diversas actividades bajo estas regulaciones para apoyar el cumplimiento de la ley.

Plazos y Siguientes Pasos

Las disposiciones restantes de la ley requerirán cumplimiento a partir del 2 de agosto de 2027. En esta fecha, la ley se aplicará a todos los sistemas de IA de alto riesgo que entren en uso en la UE. Los operadores de sistemas de alto riesgo, especialmente en aplicaciones de dispositivos médicos y diagnósticos in vitro sujetos a requisitos de marcado CE, deben cumplir en esta fecha final.

Una nueva terminología que se introduce es el «sandbox regulatorio», que se refiere a un entorno estructurado para probar tecnologías innovadoras bajo supervisión regulatoria. Este concepto se ha introducido en el léxico regulatorio de la UE y se espera que se establezcan al menos un sandbox regulatorio en cada Estado Miembro para el 2 de agosto de 2026.

Alcance y Jurisdicción de la Ley

La ley generalmente se aplica a las empresas que traen sistemas de IA al mercado o los ponen en servicio en la UE. Sin embargo, hay matices en la aplicabilidad de la ley según la naturaleza de la participación de una empresa en el desarrollo o implementación del sistema de IA. Las excepciones se aplican a modelos y sistemas utilizados exclusivamente para investigación y desarrollo.

Supervisión Experta: El Papel del Panel Científico

La UE ha lanzado un panel científico de expertos independientes para evaluar riesgos técnicos, clasificaciones de IA y amenazas sistémicas. Este panel puede emitir «alertas calificadas» cuando se identifiquen nuevos riesgos.

Conclusión: Preparación para el Futuro de la IA

La Unión Europea está estableciendo un marco regulatorio que permite a las partes interesadas participar activamente y influir en la aprobación y despliegue de sistemas habilitados por IA. Las entidades que se ven afectadas por la ley deben comenzar evaluando su exposición, actualizando la documentación y preparándose para la interacción con los reguladores.