AI en Cumplimiento: Por Qué Reemplazar No Es el Objetivo Correcto

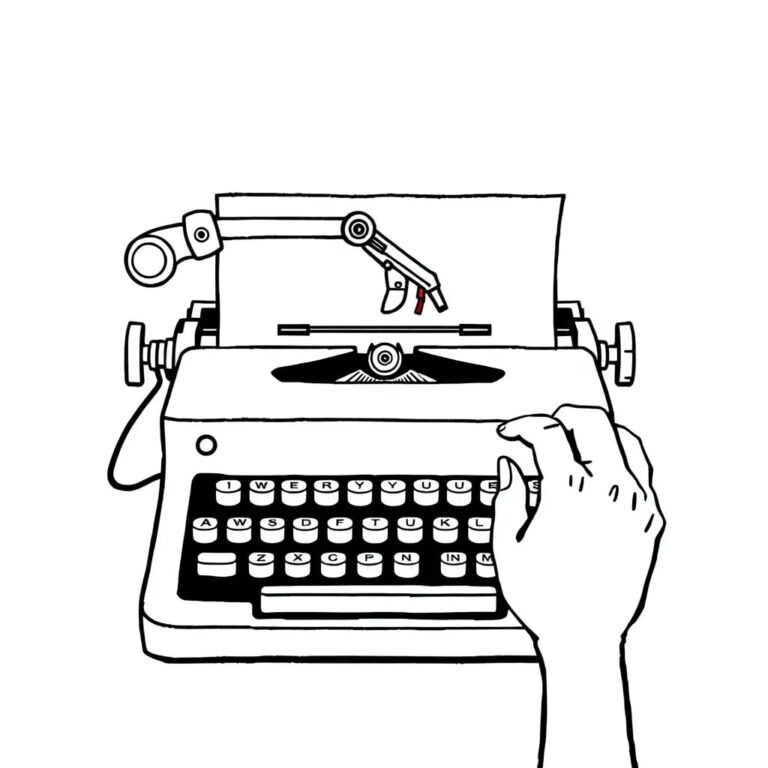

A través de paneles de fintech y discusiones en salas de juntas, una promesa sigue resurgiendo: la inteligencia artificial reemplazará a los equipos de cumplimiento.

Suena eficiente.

Suena inevitable.

También es peligrosamente incompleta.

No hay duda de que la IA está transformando la detección de fraudes, la prevención de lavado de dinero (AML) y el monitoreo de riesgos. Las pérdidas globales por fraude ascienden a cientos de miles de millones de dólares anualmente, y las instituciones están bajo presión para detectar crímenes financieros cada vez más sofisticados y en tiempo real. No es sorprendente que más de la mitad de las instituciones financieras estén invirtiendo activamente en capacidades de cumplimiento y fraude impulsadas por IA.

El Verdadero Problema Nunca Fue el Juicio Humano

Durante décadas, los equipos de cumplimiento han operado bajo una enorme presión operativa. Los sistemas tradicionales basados en reglas a menudo generan tasas de falsos positivos tan altas como el 30-40 por ciento en algunas instituciones. Los investigadores pasan mucho tiempo revisando alertas que en última instancia no representan un riesgo real.

El problema nunca fue que los profesionales de cumplimiento carecieran de capacidad.

El problema era que los sistemas generaban demasiado ruido.

La IA promete reducir ese ruido. Puede:

Identificar patrones complejos a través de millones de transacciones, detectar anomalías de comportamiento más allá de los umbrales estáticos, priorizar casos de alto riesgo de manera inteligente y aprender de decisiones investigativas pasadas.

En otras palabras, la IA puede mejorar drásticamente la eficiencia.

Pero la eficiencia no es lo mismo que la eliminación.

La Ilusión de la Automatización Total

La idea de que la IA puede «manejar el cumplimiento» de manera autónoma ignora una verdad fundamental: el cumplimiento no es simplemente detección de patrones. Se trata de juicio, responsabilidad, documentación e interpretación regulatoria.

Un algoritmo puede señalar un comportamiento inusual.

Un humano debe determinar la intención, la materialidad y la obligación de reporte.

Más importante aún, los reguladores no responsabilizan a los algoritmos. Responsabilizan a las instituciones. Y las instituciones, en última instancia, dependen de las personas.

También hay una dimensión de gobernanza que a menudo se pasa por alto en el entusiasmo por la IA. Los reguladores financieros esperan cada vez más explicabilidad, auditabilidad y trazabilidad en los sistemas de toma de decisiones automatizadas. Un modelo de caja negra que produce resultados sin claridad puede mejorar las tasas de detección, pero introduce un tipo diferente de riesgo de supervisión.

Reemplazar a los humanos con automatización opaca puede reducir el personal, pero puede aumentar la exposición.

La IA No Reemplaza la Experiencia — Depende de Ella

Quizás el aspecto más malinterpretado de la IA en el cumplimiento es su dependencia de los datos.

Los modelos de IA no operan en aislamiento. Requieren:

Conjuntos de datos históricos estructurados, arquitectura de datos limpia y consistente, resultados etiquetados de investigaciones pasadas y bucle de retroalimentación humana continua.

Una parte significativa del esfuerzo del programa de IA se dedica no a la construcción del modelo, sino a la preparación, estructuración y etiquetado de datos.

¿Quién etiqueta el comportamiento sospechoso como fraude confirmado?

¿Quién categoriza los falsos positivos?

¿Quién determina si una transacción activó el reporte regulatorio?

Los humanos lo hacen.

La IA en cumplimiento se entrena con el juicio humano. Refina las decisiones humanas. Escala el reconocimiento de patrones humanos. Pero no origina la responsabilidad institucional.

Sin datos estructurados y ricos en contexto, construidos y mantenidos por profesionales experimentados, los sistemas de IA se degradan. Derivan. Clasifican incorrectamente. Heredan sesgos. Se sobreajustan a los patrones de riesgo de ayer.

La narrativa de reemplazo pasa por alto esta dependencia por completo.

El Riesgo de la Sobreactuación

Hay otro riesgo que merece atención: la fatiga de cumplimiento puede ser reemplazada por la sobreconfianza.

Si las instituciones asumen que la IA puede «manejar» el riesgo de manera autónoma, pueden surgir dos consecuencias no intencionadas:

Reducción de la supervisión humana y dependencia excesiva de los resultados del modelo.

Ninguna de ellas es prudente en entornos regulados.

El crimen financiero evoluciona precisamente porque se adapta a los sistemas. Los adversarios prueban los umbrales de detección. Exploran los puntos ciegos del modelo. Explotan las brechas operativas.

Los sistemas de IA, si se dejan sin supervisión, pueden incrustar supuestos obsoletos o amplificar patrones defectuosos. Sin supervisión continúa, incluso los modelos sofisticados pueden volverse frágiles.

El cumplimiento, en su núcleo, no se trata solo de detección. Se trata de resiliencia: la capacidad de adaptarse de manera responsable cuando los patrones de riesgo cambian.

La resiliencia requiere supervisión.

Y la supervisión requiere humanos.

De la Automatización a la Aumentación

La verdadera transformación no radica en reemplazar a los profesionales, sino en rediseñar cómo se aplica la inteligencia dentro de los sistemas de cumplimiento.

La IA debería:

Reducir falsos positivos, priorizar casos de manera inteligente, superficializar conocimientos a nivel de red, detectar desviaciones de comportamiento en tiempo real y automatizar la documentación repetitiva.

Pero la autoridad de decisión, la interpretación regulatoria y la responsabilidad deben seguir siendo humanas. Esta no es una postura conservadora. Es una postura estratégica.

Cuando la IA maneja la escala y la complejidad del comportamiento, los profesionales son liberados para centrarse en la materialidad, las tipologías emergentes y los patrones de riesgo sistémico. El resultado no son funciones de cumplimiento más pequeñas, sino más inteligentes y adaptativas.

Las instituciones que miran hacia el futuro ya están avanzando hacia este modelo. Están integrando fraude, AML y monitoreo de transacciones en capas de inteligencia unificadas. Están incorporando estructuras de revisión con humanos en el bucle. Están diseñando marcos de IA explicables que los reguladores pueden auditar con claridad.

La Gobernanza es el Verdadero Diferenciador

A medida que la adopción de IA se acelera, la ventaja competitiva no provendrá de tener el modelo más complejo. Provendrá de tener la gobernanza más disciplinada a su alrededor.

Las instituciones que:

Invierten en conjuntos de datos estructurados y etiquetados, mantienen procesos de validación de modelos transparentes, incorporan retroalimentación continua de investigadores y priorizan la explicabilidad junto con la precisión no solo reducirán las pérdidas por fraude, sino que también fortalecerán la confianza institucional.

El cumplimiento no es un centro de costos que se deba automatizar.

Es una función de confianza que debe reforzarse inteligentemente.

Los proveedores de tecnología, los reguladores y las instituciones financieras deben alinearse en este principio. Los sistemas que diseñamos hoy darán forma a cómo opera la responsabilidad en la próxima década.

El Cambio Estratégico

La conversación sobre la IA en el cumplimiento debe madurar.

La elección no es entre humanos o máquinas.

Se trata de diseñar sistemas donde cada uno haga lo que mejor sabe hacer.

La IA sobresale en escala, velocidad y reconocimiento de patrones de comportamiento.

Los humanos sobresalen en contexto, interpretación y responsabilidad.

Confundir uno por el otro es arriesgado.

El futuro del cumplimiento no estará definido por la reducción de personal. Se definirá por el diseño inteligente: cómo las instituciones estructuran los datos, incorporan la gobernanza y construyen bucles de retroalimentación que permiten a los sistemas evolucionar sin comprometer la responsabilidad.

Las instituciones que tratan la IA como un sustituto pueden ganar velocidad.

Las instituciones que la tratan como un socio ganarán resiliencia.

El futuro del cumplimiento no pertenecerá a los sistemas más rápidos.

Pertenece a los sistemas que aprenden — de manera responsable.