AI Selló el Capó: Un Riesgo en la Codificación Moderna

Desde la llegada del motor de combustión interna, los talleres de reparación de automóviles podían arreglar casi cualquier cosa con herramientas básicas. Con la modernización, los motores de inyección de combustible tomaron el control. De manera similar, la codificación asistida por IA está reemplazando la capacidad de servicio del código, no su existencia. Ahora, nadie está mirando realmente las aplicaciones web.

Riesgos Asociados al Código Defectuoso

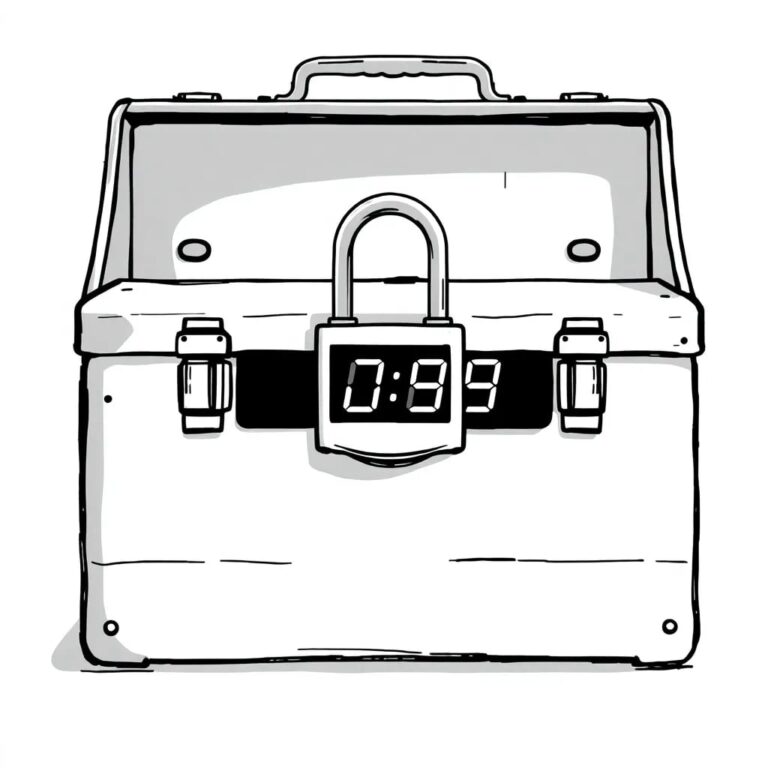

El riesgo de que el código defectuoso aparezca en todas partes es solo un aspecto del problema. El riesgo más profundo es la pérdida de habilidades fundamentales para mantener y reparar el código. No hay componentes reemplazables en el campo cuando todo es una máquina de Rube Goldberg de funciones y bibliotecas de software que pueden funcionar al ser implementadas, pero luego se vuelven incontrolables y difíciles de mantener.

Desconexión de la Calidad

Las aplicaciones funcionan, pero menos personas realmente saben por qué o cómo. Al perder nuestra relación con la maquinaria subyacente, también perdemos nuestra conexión con la calidad misma. Esta pérdida de capacidad de servicio no es solo inconveniente; es una nueva forma de riesgo.

Incidentes Reales

Un informe de 2026 muestra que una de cada cinco organizaciones ya ha sufrido un incidente grave debido a código generado por IA, y casi el 70% ha descubierto vulnerabilidades introducidas por asistentes de IA. Cuando la IA introduce un error, nadie sabe quién asume las consecuencias.

La Cultura de Seguridad en Riesgo

El código generado por IA amplifica los valores centrales y la cultura de seguridad de una organización. Si la organización tiene un buen ADN de seguridad, las herramientas de IA mejorarán esa cultura. Sin embargo, si una organización carece de disciplina y gestión de riesgos básica, el desarrollo autónomo de software reflejará esa cultura de seguridad inmadura.

Responsabilidad y Rendimiento

En el caso de una empresa que utiliza algoritmos para el comercio, cuando el algoritmo falla, la empresa pierde dinero. Pero cuando una empresa de salud utiliza modelos de IA que pueden influir en la atención al paciente, habrá una responsabilidad compartida cuando un paciente sufra un resultado inesperado.

Cambio en la Naturaleza del Trabajo

Los ingenieros en etapas tempranas trabajan casi completamente en la capa de abstracción, enviando código más rápido pero con menos exposición a sistemas, redes o modos de falla. Esto debilita el juicio humano necesario para desafiar la salida de la IA antes de que llegue a producción.

El Impacto en el Desarrollo de Software

Estamos experimentando una simplificación en el desarrollo de software. Algunos analistas de seguridad de nivel inicial se dedican a supervisar algoritmos que deciden si los eventos de registro son maliciosos. La producción de contenido visual se está reduciendo a una estética mundana y desprovista de respeto por el arte y el diseño.

La Expansión de Herramientas y la Falta de Gobernanza

Las investigaciones muestran que los equipos que sufrieron incidentes de seguridad utilizaron más herramientas de proveedores que aquellos que no lo hicieron. El exceso de herramientas ha sido parte del ADN de la industria de la seguridad, y la IA generada por código exacerba este problema.

La Brecha entre Política y Práctica

Un auditor busca la diferencia entre la política escrita y la técnica practicada. Si publicas una política que no se cumple, puedes enfrentarte a problemas. Las políticas de gobernanza de IA deben ser efectivas y aplicables, no solo decorativas.

Conclusión

La pérdida de nuestra capacidad para servir a nuestros propios sistemas significa que también estamos perdiendo calidad. Las juntas directivas deben preguntar: “¿Puedes mostrarme exactamente dónde está funcionando el código generado por IA en producción y quién es responsable de su comportamiento?” Si no se puede responder a esa pregunta, no hay gobernanza, solo ficción bien escrita.