Por qué la gobernanza de la inteligencia artificial se ha vuelto inevitable

La inteligencia artificial ha pasado de los márgenes de la innovación al núcleo de la sociedad moderna. Los sistemas impulsados por algoritmos ahora influyen en cómo las personas trabajan, aprenden, se comunican y toman decisiones.

Desde el servicio al cliente automatizado hasta el análisis predictivo en la atención médica y las finanzas, la inteligencia artificial se ha integrado en la vida cotidiana.

Esta rápida expansión ha obligado a gobiernos e instituciones a enfrentar una dura realidad: el progreso tecnológico ha superado los marcos regulatorios.

Durante años, los responsables de políticas se basaron en pautas voluntarias y autorregulación de la industria, suponiendo que la innovación necesitaba libertad para florecer. Sin embargo, a medida que los sistemas de inteligencia artificial se volvían más poderosos y autónomos, las preocupaciones se multiplicaron. Problemas como el uso indebido de datos, el sesgo algorítmico, la desinformación y la falta de responsabilidad ya no podían ser tratados como riesgos teóricos.

Fase decisiva de la regulación

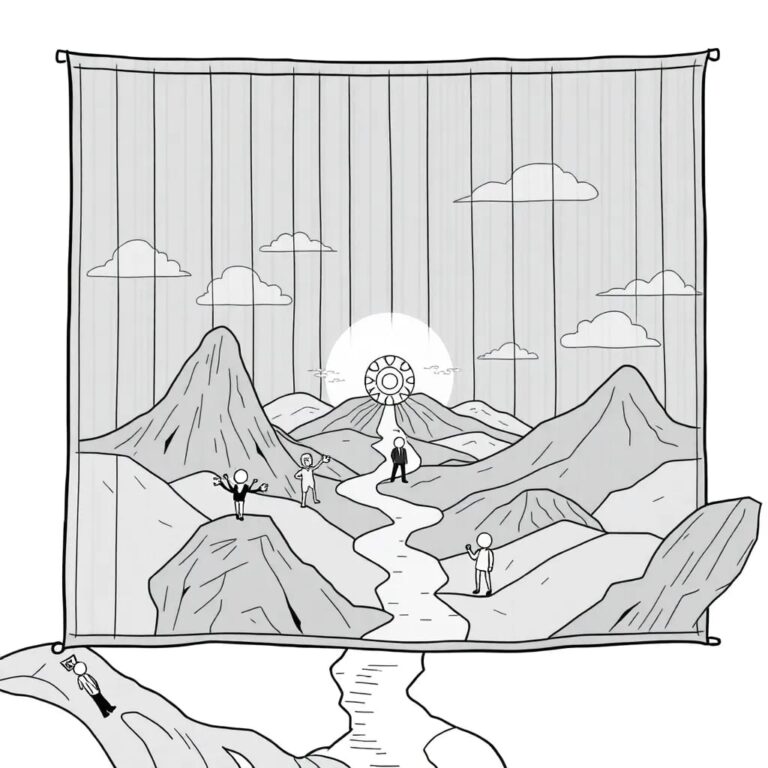

La fase decisiva de la regulación refleja un cambio de mentalidad. La inteligencia artificial ya no se ve únicamente como una herramienta de productividad; se reconoce cada vez más como una fuerza capaz de reconfigurar procesos democráticos, mercados laborales y normas sociales. Sin reglas claras, el potencial de daño se expande junto con la innovación.

La conciencia pública también ha aumentado. Casos de alto perfil involucrando deepfakes, vigilancia automatizada y sistemas de toma de decisiones opacos han desatado un amplio debate. Los ciudadanos se hacen preguntas fundamentales sobre control, equidad y transparencia. Estas presiones han empujado a los gobiernos a pasar de la discusión a la acción.

Por lo tanto, la regulación está surgiendo no como una barrera para la innovación, sino como un intento de definir sus límites. El desafío radica en crear reglas que protejan a la sociedad sin frenar el progreso tecnológico.

Riesgos centrales que impulsan la supervisión más estricta

Varios riesgos están en el centro del debate regulatorio. Uno de los más prominentes es la difusión de medios sintéticos. La inteligencia artificial puede generar imágenes, audio y video altamente realistas que son difíciles de distinguir de la realidad, lo que plantea preocupaciones sobre la interferencia electoral, el fraude y el daño a la reputación.

El sesgo y la discriminación representan otro problema crítico. Los sistemas de inteligencia artificial aprenden de los datos, y estos a menudo reflejan desigualdades existentes. Cuando estos sistemas se implementan en áreas como la contratación, el crédito o la aplicación de la ley, los resultados sesgados pueden reforzar desventajas estructurales. Los reguladores están cada vez más enfocados en garantizar la equidad y la responsabilidad en la toma de decisiones algorítmicas.

La privacidad también está bajo presión. La inteligencia artificial depende en gran medida de grandes conjuntos de datos, muchos de los cuales contienen información personal. La recopilación, almacenamiento y procesamiento de estos datos plantean preguntas sobre el consentimiento y la vigilancia. Sin salvaguardias claras, los individuos pueden perder el control sobre sus identidades digitales.

Los riesgos de seguridad van más allá del daño individual. La inteligencia artificial puede ser utilizada en ciberataques automatizados, campañas de desinformación o sistemas autónomos. Estas amenazas difuminan la línea entre tecnología civil y estratégica, elevando la inteligencia artificial a un asunto de seguridad nacional e internacional.

Finalmente, la transparencia sigue siendo un desafío persistente. Muchos sistemas avanzados operan como cajas negras, produciendo resultados sin explicaciones claras. Esta opacidad socava la confianza y complica la responsabilidad. Los reguladores argumentan cada vez más que los sistemas que afectan los derechos humanos o las oportunidades económicas deben ser explicables y auditables.

Equilibrando la innovación con la protección pública

Uno de los aspectos más complejos de la regulación de la inteligencia artificial es encontrar el equilibrio adecuado. Reglas demasiado restrictivas podrían ralentizar la innovación, desalentar la inversión y empujar el desarrollo hacia entornos menos regulados. Sin embargo, una supervisión insuficiente arriesga erosionar la confianza pública y amplificar el daño.

Los responsables de políticas están explorando enfoques basados en riesgos. En lugar de regular todos los sistemas de inteligencia artificial por igual, buscan enfocarse en aplicaciones con el mayor potencial de impacto. Los sistemas utilizados en infraestructuras críticas, servicios públicos o procesos democráticos enfrentan un escrutinio más estricto que aquellos desplegados en contextos de bajo riesgo.

Las voces de la industria juegan un papel importante en esta discusión. Las empresas tecnológicas argumentan que la flexibilidad es esencial en un campo que evoluciona rápidamente. Enfatizan la necesidad de marcos adaptativos que puedan evolucionar junto con la innovación. Al mismo tiempo, muchas empresas reconocen que reglas claras pueden proporcionar certeza y apoyar el crecimiento a largo plazo.

Las pequeñas y medianas empresas presentan otra consideración. El cumplimiento normativo puede ser intensivo en recursos. Si las reglas son demasiado complejas, pueden favorecer a las grandes corporaciones con capacidad legal y técnica, limitando la competencia y la diversidad dentro del sector.

La coordinación internacional añade aún más complejidad. El desarrollo de la inteligencia artificial es global, pero la regulación sigue siendo en gran medida nacional o regional. Las reglas divergentes pueden crear fragmentación, complicando el despliegue y la cooperación transfronteriza. Los esfuerzos por alinear estándares reflejan la comprensión de que la gobernanza de la inteligencia artificial no puede tener éxito en aislamiento.

El equilibrio entre innovación y protección definirá, en última instancia, el éxito de los esfuerzos regulatorios. Lograrlo requiere un diálogo continuo entre gobiernos, industria, academia y la sociedad civil.

Cómo la regulación de la inteligencia artificial podría remodelar economías y empleos

La regulación influirá no solo en cómo se construye la inteligencia artificial, sino también en cómo se adopta en las economías. Reglas claras pueden acelerar la adopción al reducir la incertidumbre y construir confianza. Las organizaciones son más propensas a invertir en sistemas que cumplan con estándares definidos.

Al mismo tiempo, los requisitos de cumplimiento pueden aumentar los costos. Esto podría ralentizar el despliegue en ciertos sectores o regiones, particularmente donde los márgenes son ajustados. Los responsables de políticas deben considerar cómo la regulación interactúa con la competitividad y la resiliencia económica.

Los mercados laborales están en el centro de esta transformación. La inteligencia artificial promete ganancias de eficiencia pero también amenaza con alterar patrones de empleo tradicionales. La regulación por sí sola no puede prevenir el desplazamiento laboral, pero puede influir en cómo se gestionan las transiciones. Los requisitos de transparencia y supervisión humana pueden preservar roles en procesos de toma de decisiones críticos.

Las políticas de educación y recualificación se cruzan cada vez más con la gobernanza de la inteligencia artificial. A medida que los sistemas automatizan tareas rutinarias, crece la demanda de habilidades relacionadas con la supervisión, la ética y el diseño de sistemas. La claridad regulatoria puede guiar la inversión en capacitación y adaptación de la fuerza laboral.

La desigualdad económica representa una preocupación a largo plazo. Si el acceso a herramientas avanzadas de inteligencia artificial se concentra entre unos pocos actores, las disparidades pueden ampliarse. La regulación puede fomentar un desarrollo más inclusivo apoyando estándares abiertos, la competencia y la innovación responsable.

El impacto económico de la regulación, por lo tanto, será desigual y evolutivo. El éxito dependerá de la integración de la gobernanza con estrategias económicas y sociales más amplias.

Lo que la fase decisiva significa para el futuro de la inteligencia artificial

La fase regulatoria actual marca un punto de inflexión. La inteligencia artificial está transitando de ser una tecnología experimental a una infraestructura fundamental de la vida moderna. Con esta transición viene un reconocimiento de la responsabilidad.

La regulación no resolverá todos los desafíos. Nuevos riesgos surgirán a medida que los sistemas se vuelvan más capaces y autónomos. Los marcos de gobernanza deben seguir siendo flexibles y receptivos, capaces de adaptarse a desarrollos imprevistos.

La confianza pública será un factor definitorio. Reglas transparentes, responsabilidad significativa y una aplicación visible pueden ayudar a tranquilizar a los ciudadanos de que la inteligencia artificial sirve a los intereses humanos. Sin confianza, la adopción puede enfrentar resistencia independientemente de la capacidad técnica.

La competencia global también moldeará los resultados. Los países que combinen innovación con una gobernanza creíble pueden obtener ventajas estratégicas. Aquellos que se rezaguen arriesgan tanto sofocar el progreso como perder el control sobre tecnologías poderosas.

En última instancia, la regulación de la inteligencia artificial se trata de definir límites. Busca asegurar que el progreso tecnológico se alinee con los valores sociales en lugar de socavarlos. La fase decisiva refleja un reconocimiento colectivo de que el futuro de la inteligencia artificial no puede dejarse al azar.

A medida que los gobiernos finalizan marcos y las instituciones se ajustan, el mundo entra en un nuevo capítulo. La inteligencia artificial continuará transformando sociedades, pero cada vez más dentro de reglas diseñadas para proteger la dignidad humana, la seguridad y la oportunidad.