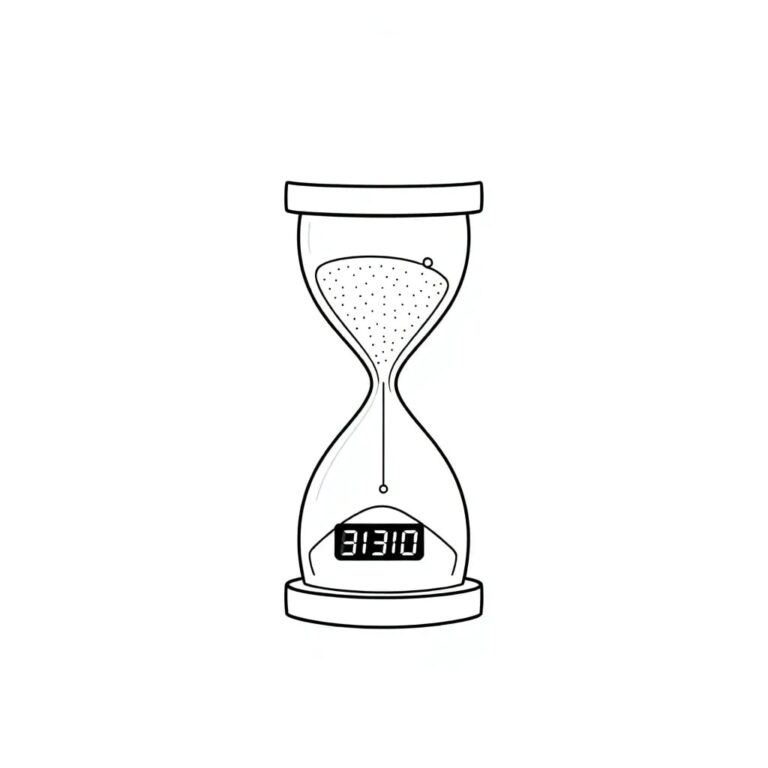

La ética es el tema definitorio para el futuro de la IA y el tiempo se está agotando

A medida que la inversión en inteligencia artificial (IA) continúa aumentando, un elemento crítico no está recibiendo la atención suficiente, lo que incrementa los riesgos para las personas, las empresas y la sociedad. Es fundamental enfocar más la atención en la ética en la IA, tanto en teoría como en práctica.

La urgencia del tema de la ética en la IA

La tecnología se está expandiendo más rápido que los mecanismos de gobernanza o salvaguardias pueden seguir el ritmo. La IA ya está moldeando las vidas de las personas, los daños son reales, la regulación se queda atrás y la adopción se acelera. Las decisiones que se tomen ahora influirán en cómo se integrará la IA en la sociedad durante décadas.

La ética no puede añadirse posteriormente. Esperar hasta que la IA esté completamente integrada en sistemas críticos para corregir sesgos, opacidad o fallas de gobernanza será tan problemático como intentar instalar cinturones de seguridad después de que los autos ya estén en la carretera. Los próximos cinco años representan una ventana de oportunidad para incorporar marcos éticos, antes de que los riesgos queden bloqueados e irreversibles.

Factores que contribuyen a la situación actual

Una cultura de «moverse rápido y arreglar después» puede funcionar en la tecnología de consumo, pero es peligrosa cuando se aplica a sistemas de IA que determinan la solvencia crediticia o el tratamiento médico. Una vez que estos sistemas están desplegados, añadir ética posteriormente es más lento, costoso y difícil de hacer cumplir.

Los marcos regulatorios son fragmentados y están rezagados. La Ley de IA de la UE, que entrará en vigor en 2026, representa el primer régimen regulatorio integral. En otros lugares, el panorama es irregular: algunos países solo tienen orientación parcial, mientras que otros aún están desarrollando políticas. La IA es global, pero las reglas son nacionales.

¿Cuál es la diferencia entre ética de la IA y IA ética?

Mientras que están relacionadas, describen dos perspectivas: una teórica y la otra práctica. La ética de la IA es el estudio académico y filosófico de los problemas morales, sociales y políticos que plantea la inteligencia artificial. Se preocupa por principios y marcos normativos.

La IA ética, en contraste, se refiere a la implementación práctica de esos principios en el diseño, desarrollo y despliegue de sistemas de IA. Se trata de asegurar que la IA actúe de maneras que sean útiles, honestas y no dañinas, no solo en los resultados, sino a lo largo de todo el ciclo de desarrollo.

Enfoque hacia la IA ética

La ética de la IA debe ser diseñada e implementada en cada etapa de la cadena de valor. Esto incluye la infraestructura, la medición y los datos, los modelos y el entrenamiento, las aplicaciones y su implementación, así como la gestión y el monitoreo de resultados. Cada etapa crea oportunidades para valor y riesgos éticos distintos que necesitan controles y responsabilidades desde el inicio.

¿Es la ética de la IA un pensamiento secundario para muchas empresas?

Demasiado a menudo, la ética de la IA se ha tratado como un pensamiento posterior en lugar de un principio de diseño central. Las organizaciones pueden adoptar principios éticos amplios, pero al momento de construir o desplegar IA, la ética se añade tarde en el proceso, si es que se incluye.

¿Causan las presiones competitivas que las empresas aceleren la implementación de la IA?

A menudo, las organizaciones sienten presión de inversores, juntas o competidores para lanzar productos de IA rápidamente. Cuando se apresura la IA, pequeños errores pueden escalar en daños sistémicos. La velocidad puede ofrecer una ventaja competitiva temporal, pero a menudo tiene consecuencias perjudiciales.

Ventajas competitivas de comprometerse con la IA ética

Las empresas que son transparentes y justas construyen una mayor confianza y lealtad de marca. La IA ética se está convirtiendo en un activo estratégico, y las compañías que entienden esto temprano estarán mejor posicionadas para la próxima década.

Liderazgo en estos temas

El liderazgo vendrá de aquellos que diseñan, compran, despliegan, aseguran y auditan la IA, especialmente en grandes empresas, organismos de estándares y la sociedad civil. En el corto plazo, estos actores pueden moverse más rápido que la legislación y moldear normas a través de la adopción de estándares y disciplina de mercado.

Impacto de la IA en los MBA

La IA está automatizando partes del análisis y la creación de contenido, pero el trabajo gerencial que los MBA están capacitados para hacer se vuelve más importante a medida que la IA se expande. La IA no está desplazando a los MBA, sino que está creando roles de gestión que requieren habilidades específicas en la intersección de tecnología, legalidad y funciones empresariales.

Enfoque diferente de la institución hacia la ética de la IA

Este enfoque destaca por su atención operativa y gerencial, insertando la ética de la IA como una disciplina impulsada por el liderazgo, integrada en la investigación, educación y compromiso práctico. Equipando a los líderes empresariales con herramientas del mundo real para gobernar la IA de manera ética y efectiva.