La lucha de Anthropic con el Pentágono en medio de la guerra con Irán pone en foco la ética de la guerra con IA

(OSV News) — Mientras el humo aún se elevaba de sus ruinas y los rescatistas extraían 175 cuerpos de los escombros de la escuela primaria Shajarah-Tayyebeh en Irán, surgieron preguntas sobre cómo pudo haber sucedido esto en las primeras horas de la guerra entre Estados Unidos e Israel con Irán.

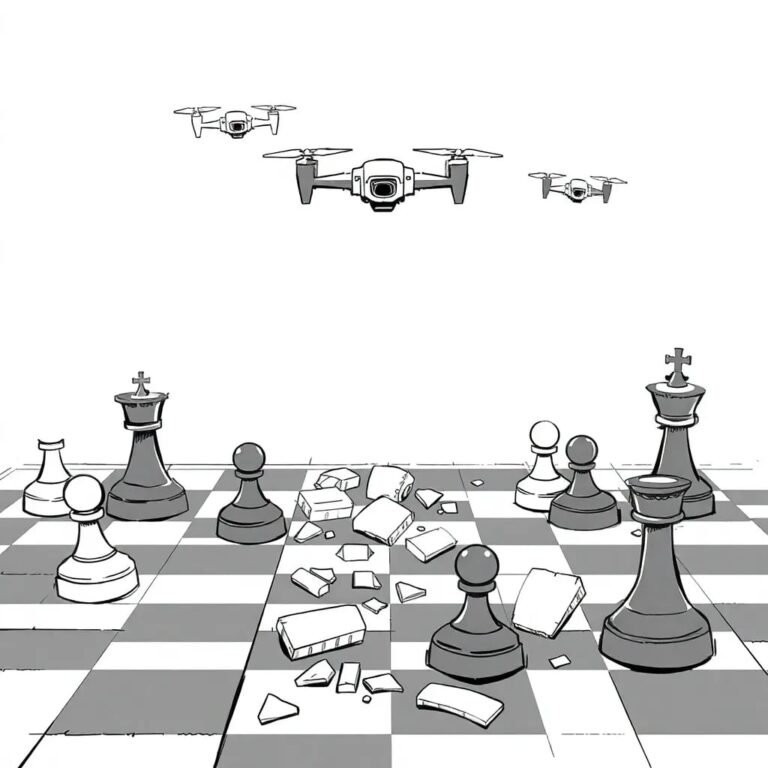

Los informes preliminares sugieren que la escuela fue mal identificada como un sitio militar debido a inteligencia humana desactualizada cuando fue alcanzada por un misil de crucero Tomahawk de EE.UU. Sin embargo, el incidente también ha llamado la atención sobre la compleja interacción entre el uso de inteligencia artificial generativa para procesar masivamente los datos que se le proporcionan en miles de potenciales objetivos militares, identificados y clasificados para la aprobación de revisores humanos.

La «primera guerra con IA»

En lo que algunos comentaristas llaman «la primera guerra con IA» — la actual guerra entre Estados Unidos, Israel e Irán — hay una serie de consideraciones éticas, tanto antiguas como nuevas. Sin embargo, muchas giran en torno a la misma preocupación: que la IA no debe ser dejada a su propia suerte.

Sin embargo, el 27 de febrero, víspera de la Operación Epic Fury, el presidente de EE.UU. dirigió a las agencias gubernamentales para que dejaran de trabajar con la gigante tecnológica Anthropic, en medio de una diferencia crítica de opiniones sobre los usos aceptables de su tecnología por parte del Departamento de Defensa. En respuesta, Anthropic, cuyos herramientas analizan imágenes y datos de inteligencia, presentó una demanda contra el Pentágono el 9 de marzo.

El CEO de Anthropic, citando la vigilancia masiva y las armas totalmente autónomas, declaró: «En un conjunto limitado de casos, creemos que la IA puede socavar, en lugar de defender, los valores democráticos. Algunos usos también están simplemente fuera de los límites de lo que la tecnología de hoy puede hacer de manera segura y confiable.»

Teólogos morales católicos

El 13 de marzo, un grupo de 14 teólogos morales católicos presentó un escrito de apoyo a Anthropic. Notaron que las objeciones de Anthropic al uso de la IA para la vigilancia masiva de estadounidenses están «alineadas» con la enseñanza católica sobre la privacidad y la subsidiariedad, y argumentaron desde la enseñanza de la Iglesia sobre la justicia en la guerra que «las armas autónomas letales oscurecen problemáticamente la agencia humana, desplazando peligrosamente la responsabilidad de los tomadores de decisiones humanos a las máquinas.»

Un representante de la Conferencia de Obispos Católicos de EE.UU. expresó que «el Papa ha descrito las implicaciones de la tecnología de IA para la humanidad como una ‘revolución digital’. Además, los obispos han subrayado lo que el Santo Padre ha dicho, recordando a los legisladores que la IA impacta una amplia gama de cuestiones que la Iglesia considera importantes para la vida y la dignidad humanas.»

Consideraciones éticas y decisiones de guerra

El almirante de la Armada de EE.UU. indicó que el país está utilizando una variedad de herramientas avanzadas de IA para llevar a cabo ataques. Estas herramientas ayudan a filtrar grandes cantidades de datos en segundos, permitiendo a los líderes tomar decisiones más inteligentes más rápido que el enemigo puede reaccionar. Sin embargo, humanos siempre tomarán las decisiones finales sobre qué atacar y cuándo.

Un grupo de 120 legisladores demócratas expresó su preocupación sobre los informes de que los ataques de EE.UU. e Israel a Irán han golpeado «escuelas, hospitales, gimnasios, espacios de reunión pública y un sitio de patrimonio de la UNESCO.» Preguntaron qué papel estaba jugando la IA en la selección de objetivos y en la determinación legal de los mismos.

El dilema de la ética en la guerra

Históricamente, la ética de la guerra ha estado protegida por amplias salvaguardias y reglas de compromiso, estrictamente supervisadas por el Departamento de Defensa. Sin embargo, se ha planteado preocupación sobre la postura de la administración respecto a cómo se conduce la guerra. Observadores han señalado que la falta de guardrails sobre la IA podría tener graves consecuencias, ya que la IA generativa es conocida por ser altamente sesgada.

Responsabilidades de las corporaciones

Las corporaciones, como Anthropic, tienen la responsabilidad de querer que sus productos se utilicen de manera apropiada y ética. Tienen todo el derecho a establecer limitaciones en el uso de su producto. Si un comprador, en este caso el gobierno, no desea cumplir con esas restricciones, no tiene que interactuar con la empresa.

La Iglesia ha sido consistente en que debe haber un ser humano involucrado en la toma de decisiones en la aplicación de los criterios de guerra justa. La dehumanización de la guerra complicará aún más el uso de la fuerza letal, lo que puede llevar a efectos desproporcionados que deben ser cuidadosamente vigilados.