Otro año, otra sesión de sobreregulación de la IA

Con el inicio de la sesión legislativa de 2026, una nueva y significativa fase en la conversación sobre la libertad de expresión y la inteligencia artificial ya está tomando forma en las asambleas estatales de todo el país. Se espera otra serie de proyectos de ley sobre IA que dictarán cómo las personas utilizan las máquinas para hablar y comunicarse, planteando preguntas constitucionales fundamentales sobre la libertad de expresión en este país.

La Primera Enmienda y la IA

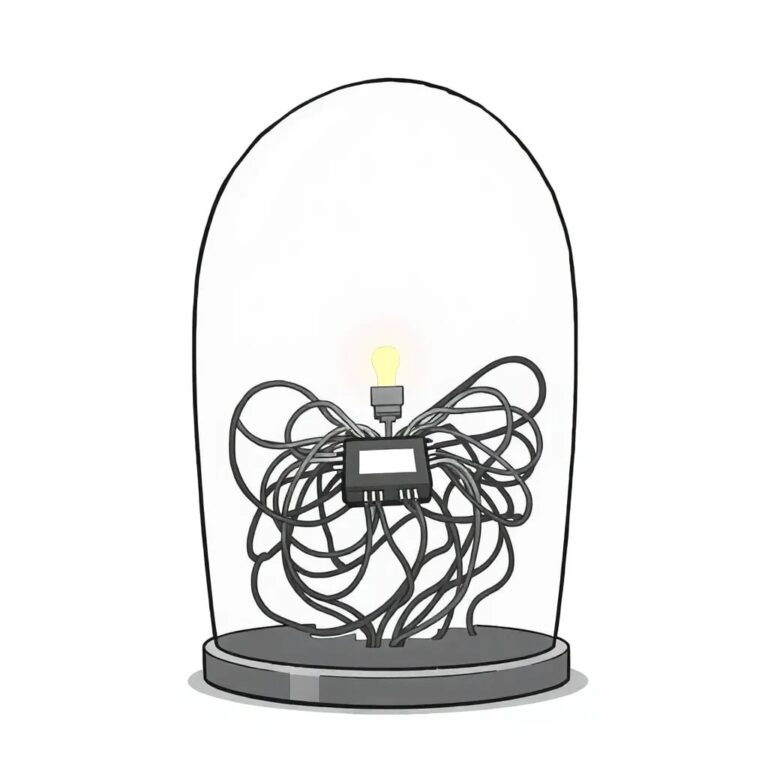

La Primera Enmienda se aplica a la inteligencia artificial de manera similar a como se aplica a tecnologías expresivas anteriores. Al igual que la imprenta, la cámara, Internet y las redes sociales, la IA es una herramienta que las personas utilizan para comunicar ideas, acceder a información y generar conocimiento. Independientemente del medio involucrado, nuestra Constitución protege estas formas de expresión.

Preocupaciones sobre la regulación

A medida que los legisladores revisitan la política de IA en 2026, es necesario recordar que la legislación existente ya aborda muchos de los daños que buscan tratar — fraude, falsificación, difamación, discriminación e interferencia electoral — ya sea que se utilice IA o no. El fraude sigue siendo fraude, independientemente de si se utiliza un bolígrafo o un teclado, ya que la responsabilidad corresponde a la persona que comete actos ilegales y no al instrumento que utilizó para hacerlo.

Muchos de los proyectos de ley de IA introducidos o esperados este año dependen de enfoques regulatorios que plantean serias preocupaciones sobre la Primera Enmienda. Algunos exigirían a los desarrolladores o usuarios que adjunten advertencias, etiquetas u otras declaraciones a expresiones generadas por IA, obligándolos a actuar como portavoces del gobierno para opiniones que pueden no sostener.

Legislación sobre deepfakes y chatbots

La legislación relacionada con los deepfakes electorales sigue siendo un enfoque central en 2026. Durante el año pasado, múltiples estados han introducido proyectos de ley destinados a controlar el contenido político generado por IA. Sin embargo, estas leyes a menudo restringen el núcleo del discurso político, y los tribunales han aplicado la jurisprudencia establecida de la Primera Enmienda para considerarlas inconstitucionales.

Otra categoría creciente de legislación busca restringir los chatbots o IA conversacional, utilizando marcos tomados de las leyes de redes sociales. Estas incluyen requisitos generalizados de advertencia que indican a los usuarios que están interactuando con IA, abarcando muchas interacciones ordinarias de bajo riesgo donde no se necesita tal advertencia.

Implicaciones y riesgos

Estas restricciones colocan al gobierno entre las personas y la información a la que tienen derecho constitucionalmente a acceder. Censuran expresiones legítimas y dificultan el derecho a hablar y escuchar de manera anónima. Por esta razón, los tribunales han bloqueado repetidamente restricciones similares cuando se aplican a usuarios y plataformas de redes sociales.

Los amplios proyectos de ley regulatorios sobre IA también han regresado este año, con al menos un estado que ha introducido tal propuesta hasta ahora en este ciclo. Estos proyectos de ley buscan imponer marcos regulatorios extensos sobre desarrolladores, implementadores y usuarios de IA mediante una supervisión gubernamental amplia y responsabilidad para el uso de herramientas de IA por terceros.

Conclusión

Abordar daños reales, incluidos el fraude, la discriminación y la interferencia electoral, puede ser un objetivo legislativo legítimo. Sin embargo, la experiencia ha demostrado que la regulación expansiva, vaga y preventiva de herramientas expresivas a menudo enfría el discurso legítimo sin dirigirse efectivamente a la mala conducta. En lugar de atacar el discurso político o imponer restricciones a herramientas expresivas, los funcionarios gubernamentales deberían comenzar con las herramientas legales que ya tienen a su disposición.