Prohibir la regulación de la IA sería un desastre

El lunes, se anunció que se firmará una orden ejecutiva que prohibiría a los estados regular la inteligencia artificial (IA). Los defensores de esta preempción argumentan que la competitividad está ligada a la desregulación, afirmando que las limitaciones a nivel estatal obstaculizan la innovación y debilitan la posición de Estados Unidos en la competencia tecnológica con otros países. Sin embargo, la realidad es que las vulnerabilidades más serias en materia de seguridad nacional relacionadas con la IA no provienen de una supervisión excesiva, sino de su ausencia.

Vulnerabilidades nacionales

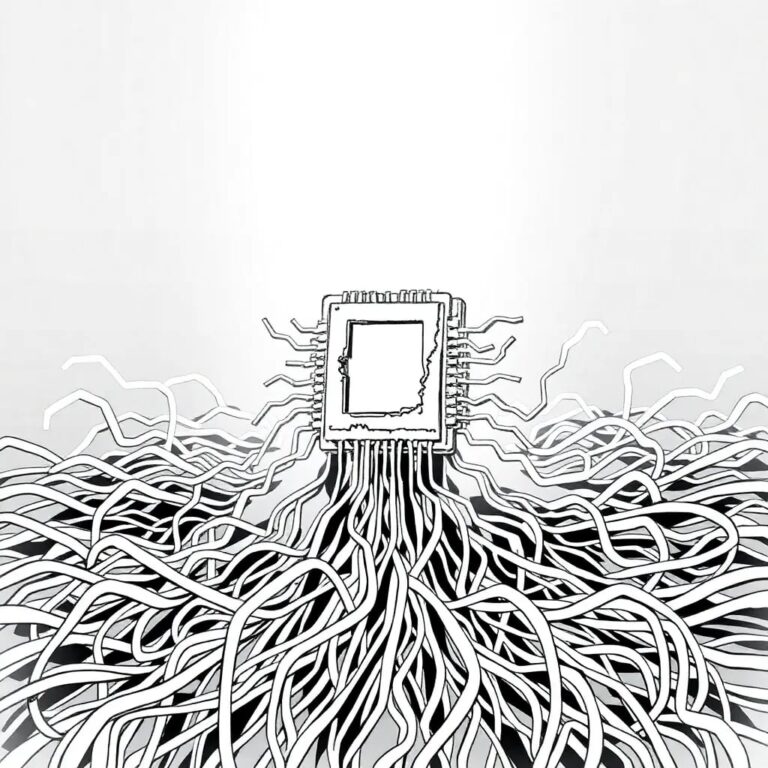

Los sistemas de IA son esenciales en funciones críticas de la economía y la seguridad nacional, incluyendo la gestión de aeropuertos, la predicción del suministro energético y la detección de fraudes. Estos sistemas ofrecen ventajas operativas extraordinarias, pero también presentan puntos de falla concentrados y de alto impacto. Cada uno de estos puntos es un objetivo atractivo para adversarios que buscan manipular algoritmos no regulados, lo que podría resultar en el colapso de infraestructuras críticas.

Campañas de desinformación

Los mismos actores que están invirtiendo en el robo de modelos de IA y en operaciones de espionaje también están llevando a cabo campañas de desinformación habilitadas por IA. En 2024, se reportaron más de 160 narrativas falsas diseñadas para distorsionar elecciones y erosionar la confianza cívica. Estas campañas prosperan en vacíos creados por la falta de estándares de seguridad aplicables.

Desafíos actuales

Recientemente, se informó que hackers han utilizado malware impulsado por IA en ataques cibernéticos activos. Los desafíos a los que se enfrenta el país no provienen de una regulación excesiva, sino del despliegue de sistemas de IA potentes sin requisitos mínimos de seguridad y transparencia.

La respuesta de las empresas tecnológicas

A pesar de los riesgos, las grandes empresas tecnológicas están invirtiendo en campañas de cabildeo para evitar las salvaguardias necesarias. Su estrategia consiste en asegurar una preempción federal que inmovilice a los estados y retrase la regulación significativa a nivel federal.

Un enfoque trágico

Esta estrategia es miope. La regulación no tiene por qué frenar la innovación; reglas claras pueden fomentar el crecimiento al proteger los sistemas de ataques y asegurar que los modelos sean robustos antes de su implementación a gran escala.

Importancia de la regulación estatal

Los estados son laboratorios efectivos para desarrollar y refinar políticas sobre tecnologías complejas. Mientras que el Congreso ha fracasado en crear un marco comprensivo, los estados están llenando el vacío, probando enfoques y produciendo evidencia del mundo real más rápidamente que el gobierno federal.

Conclusión

La solución a los riesgos de la IA no es desmantelar la supervisión, sino diseñar la regulación adecuada. El liderazgo de Estados Unidos en inteligencia artificial no se asegurará debilitando las pocas salvaguardias existentes, sino estableciendo reglas serias que resistan a los adversarios en el mundo real.