La IA Inspirada en el Cerebro Necesita Nuevas Reglas

Los investigadores están cada vez más enfocados en los desafíos de gobernar sistemas NeuroAI y neuromórficos, un campo en el que los enfoques regulatorios actuales son insuficientes. Este artículo destaca la necesidad crítica de reevaluar los métodos de aseguramiento y auditoría, abogando por una co-evolución de la regulación junto a la computación inspirada en el cerebro para garantizar una supervisión técnicamente sólida y efectiva.

Limitaciones de los Marcos de Gobernanza Existentes

Los sistemas neuromórficos y la inadecuación de los marcos de gobernanza actuales de la IA requieren enfoques regulatorios proactivos y adaptativos. Estos sistemas, construidos sobre hardware neuromórfico y utilizando redes neuronales de picos, desafían las suposiciones subyacentes en los estándares regulatorios actuales respecto a precisión, latencia y eficiencia energética.

Características de NeuroAI

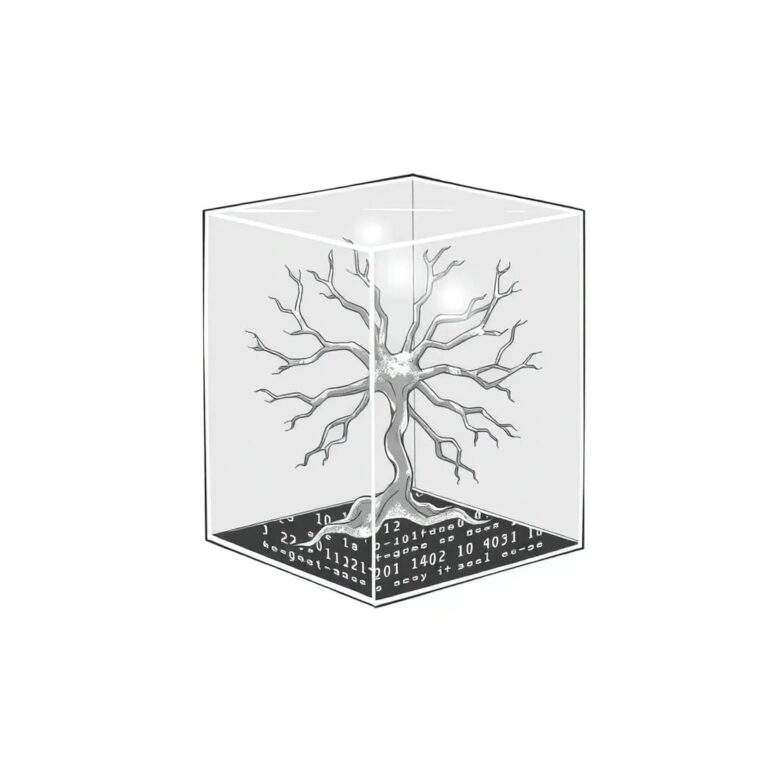

NeuroAI representa una convergencia de la neurociencia y la inteligencia artificial, buscando crear sistemas más inteligentes y eficientes aprovechando los conocimientos del cerebro. La computación neuromórfica rompe con la arquitectura convencional de von Neumann, integrando memoria y computación, y operando de manera asincrónica y basada en eventos.

Este cambio se expresa a nivel algorítmico en redes neuronales de picos, que comunican información a través de pulsos discretos que codifican datos en tasa y tiempo, empleando frecuentemente reglas de aprendizaje local.

Necesidad de Nuevos Enfoques de Gobernanza

Los marcos de gobernanza actuales, incluidos los puntos de referencia regulatorios para precisión, latencia y eficiencia energética, están diseñados para redes neuronales artificiales estáticas. Este trabajo destaca que estos marcos no capturan el comportamiento adaptativo y basado en eventos de los sistemas neuromórficos y NeuroAI.

Se propone un nuevo enfoque, ejemplificado por marcos como NeuroBench, que vincula el rendimiento algorítmico con la eficiencia del hardware, reformulando la evaluación desde un esquema de resultados centralizados hacia una auditoría a nivel de sistemas.

Implicaciones Éticas y de Seguridad

Los sistemas neuromórficos presentan desafíos únicos en términos éticos y de seguridad. Las metodologías tradicionales de auditoría resultan inapropiadas, ya que estos sistemas aprenden continuamente y utilizan memoria distribuida integrada en el hardware. Las implicaciones son significativas en aplicaciones de alto riesgo, como dispositivos de salud y vehículos autónomos, donde la seguridad y la rendición de cuentas son fundamentales.

Conclusión

A medida que la computación neuromórfica avanza desde los laboratorios de investigación hacia aplicaciones del mundo real, se hace urgente abordar las brechas de gobernanza. Es esencial desarrollar métodos de aseguramiento y auditoría que evolucionen junto con las arquitecturas de NeuroAI, alineando las métricas regulatorias con la física y la dinámica de aprendizaje subyacentes en la computación inspirada en el cerebro.