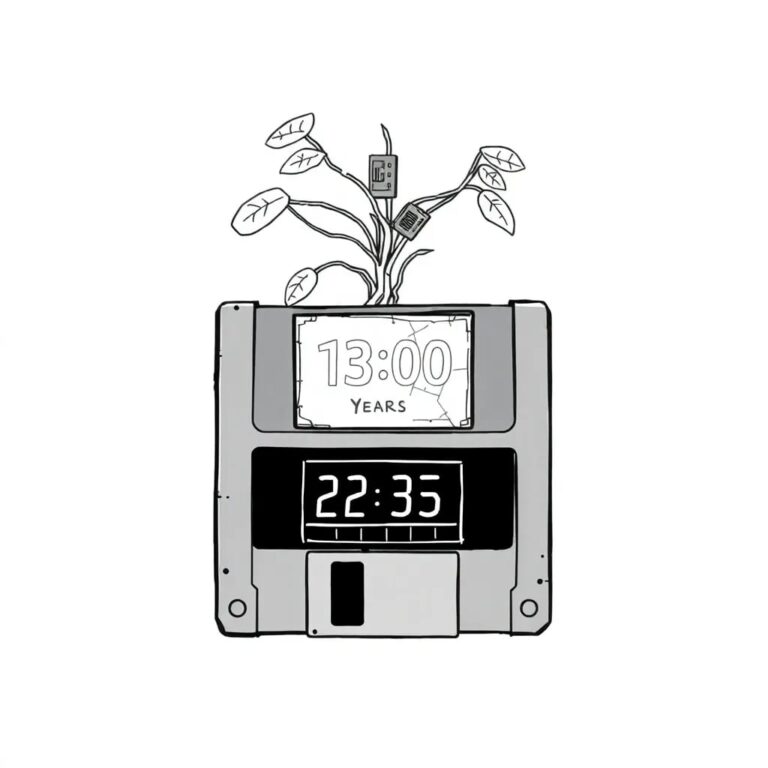

Trent’anni di Peccato Originale nella Governance Digitale e dell’IA

Il 8 febbraio 1996 due eventi hanno creato il peccato originale della governance digitale e, progressivamente, dell’intelligenza artificiale, plasmando gli sviluppi tecnologici fino a oggi. A Davos, la Dichiarazione di Indipendenza del Cibernetico di John Perry Barlow ha descritto Internet come un regno sovrano al di fuori dell’autorità degli stati. Nello stesso giorno, a Washington D.C., è entrato in vigore il Communications Decency Act degli Stati Uniti, che ha conferito alle piattaforme internet una protezione legale senza precedenti dalla responsabilità per i contenuti ospitati. Questi due avvenimenti hanno consolidato un assioma secondo cui lo sviluppo tecnologico dovrebbe superare e spesso trovarsi al di fuori delle leggi e degli strumenti di governance tradizionali.

La Dichiarazione di Indipendenza che Non Fu Mai

A Davos, la dichiarazione di Barlow proclamava: “Governi del Mondo Industriale, voi giganti stanchi di carne e acciaio, vengo dal Cyberspazio, la nuova casa della Mente. A nome del futuro, vi chiedo di lasciarci in pace. Non siete i benvenuti tra noi. Non avete sovranità dove ci riuniamo.” Questa affermazione è stata un mito fondativo, una fantasia politica che ha generato l’idea che Internet rappresentasse la “fine della geografia”. Numerosi articoli, libri, tesi e discorsi hanno sostenuto la necessità di una nuova governance per il “nuovo mondo coraggioso” digitale.

Questa costruzione intellettuale si basava sull’assunzione errata che il cyberspazio esista al di fuori del mondo fisico. In realtà, ogni email, post o query generata dall’IA è un evento fisico: impulsi elettrici che viaggiano attraverso cavi sottomarini, Wi-Fi, server e infrastrutture internet. Ogni attività online avviene nel mondo fisico e sotto la giurisdizione di uno dei 193 paesi esistenti. La dichiarazione di Barlow era un invito all’illegalità mascherata da libertà, persuadendo una generazione che il regno digitale fosse al di là delle tradizioni legali ed etiche consolidate.

Il Riparo Legale Senza Precedenti

Nello stesso giorno, il presidente degli Stati Uniti firmò il Communications Decency Act (CDA), adottato dal Congresso. Tra le sue disposizioni, spiccava la Sezione 230, che garantiva alle piattaforme internet un’immunità senza precedenti: non potevano essere considerate né editori né autori dei contenuti ospitati.

Per la prima volta nella storia, entità commerciali ricevettero un’ampia protezione dalle responsabilità generate dal proprio business. Questa era una deviazione da principi legali consolidati, come la responsabilità di un giornale per i testi pubblicati o quella dei broadcaster per le trasmissioni. Questa abdicazione giuridica delle piattaforme internet fu giustificata per proteggere un’industria nascente da grandi cause legali sui contenuti, favorendo la crescita di Internet. Oggi, l’industria tecnologica si è evoluta in colossi con capitalizzazioni di mercato nell’ordine di trilioni di dollari, ma l’immunità legale rimane la stessa concessa a start-up, creando una delle principali tensioni nell’economia moderna e nel diritto: una struttura industriale da trilioni di dollari non responsabile per le conseguenze legali delle proprie azioni.

La Convergenza dei Due Peccati

Questi due eventi — il mito di uno stato assente e l’immunità dalla responsabilità legale — si sono reciprocamente rafforzati. L’idea di un cyberspazio separato ha giustificato l’eccezionalità legale. Perché imporre a questi pionieri le leggi di un vecchio mondo mentre costruivano un nuovo mondo?

Il peccato originale della governance digitale fu subito contestato nel 1996 da un giudice, che affermò che non servono leggi specifiche per Internet, proprio come non sono mai servite “leggi sul cavallo” quando i cavalli divennero il mezzo di trasporto dominante. Internet dovrebbe essere regolato dai principi legali esistenti.

Quarant’anni dopo, il tempo ha confermato questa visione: la legge non riguarda i mezzi tecnologici, siano essi segnali di fumo, trasporti a cavallo o Internet. La legge regola i rapporti fra esseri umani e le entità da loro create (imprese, stati), compreso il modo in cui usano la tecnologia.

L’Eredità Tossica e l’IA Senza Responsabilità

Protette dalla Sezione 230 della CDA, le piattaforme IA possono rilasciare modelli linguistici e di diffusione nel mondo con minima supervisione, basandosi sulla medesima logica: “noi non siamo gli autori, siamo solo i condotti”.

Il risultato è una evidente e pericolosa asimmetria rispetto ad altre industrie. Un produttore di automobili deve ritirare prodotti difettosi e una casa farmaceutica è responsabile per i propri farmaci. Invece, un’azienda di IA può diffondere sistemi che amplificano l’odio, la disinformazione letale o che contribuiscono ad un aumento dei suicidi senza affrontare responsabilità legali comparabili. L’onere della prova e il peso della tragedia ricadono solo sugli utenti e le vittime, non sugli architetti dei sistemi.

Tornare a Millenni di Saggezza Legale

Con l’aumento delle implicazioni politiche, sociali ed economiche dell’IA, è necessario rivedere questo peccato originale della governance per riaffermare un principio legale fondamentale maturato in millenni di storia umana: chi crea, gestisce o trae profitto da una tecnologia deve essere responsabile per i suoi impatti prevedibili.

Non si tratta di soffocare l’innovazione, ma di allineare l’innovazione alla responsabilità, come è stato fatto con ogni tecnologia trasformativa nella storia. L’era dell’eccezionalismo legale deve terminare; deve iniziare quella della responsabilità, soprattutto per l’impatto profondo dell’IA sulla società.