Tendenze AI per il 2026 – Navigare nel mosaico di leggi e rischi nell’uso degli strumenti AI per l’occupazione

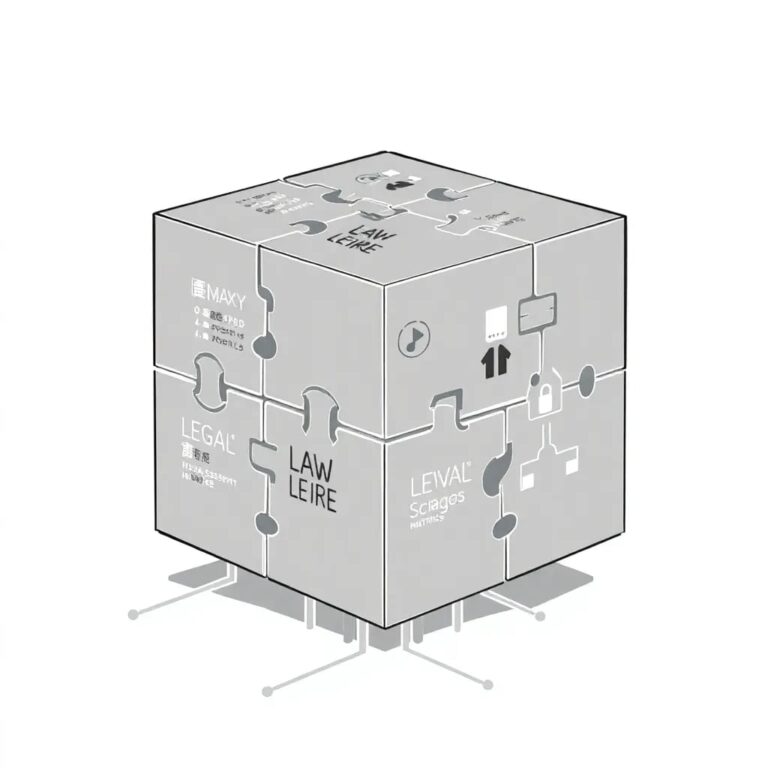

I datori di lavoro stanno sempre più implementando strumenti AI per semplificare le funzioni chiave delle risorse umane, dalla selezione dei curriculum alla gestione delle prestazioni. Nel 2026, questi strumenti non sono più sperimentali; alcune aziende li stanno integrando nelle funzioni HR fondamentali. Allo stesso tempo, legislatori e regolatori stanno aumentando rapidamente il controllo sull’uso dell’AI da parte dei datori di lavoro, cercando modi per regolare e perseguire azioni legali correlate a questi strumenti. Con il crescente mosaico di leggi e rischi legati all’AI, i datori di lavoro devono comprendere come navigare al meglio le sfide di conformità emergenti e i rischi legali nell’uso degli strumenti AI nella loro forza lavoro.

Conformità alle leggi AI in espansione e conflittuale

La navigazione nel rapido e in evoluzione mosaico di leggi sull’AI negli Stati Uniti e all’estero rappresenta una sfida significativa per le aziende domestiche e globali. Negli Stati Uniti, molti stati e città hanno approvato o stanno considerando l’emissione delle proprie leggi sull’AI. Molte di queste leggi entreranno in vigore nel 2026, inclusa la modifica all’Illinois Human Rights Act e la Colorado Artificial Intelligence Act. Queste leggi presentano spesso numerosi e talvolta divergenti requisiti, tra cui audit di bias, valutazioni dei rischi e politiche, requisiti di divulgazione, diritti di opt-out, conservazione dei dati e reporting governativo.

Complicando ulteriormente la situazione, è stato emesso un ordine esecutivo che tenta di limitare significativamente la possibilità degli stati di regolamentare l’AI in modo conflittuale con le priorità federali. In assenza di un chiaro preemption federale, i datori di lavoro devono determinare come creare strategie e politiche coese per la conformità nell’uso degli strumenti AI.

Aumento del rischio di azioni legali per discriminazione

Il trend di regolatori e avvocati nella ricerca di azioni legali per discriminazione contro i datori di lavoro per l’uso di strumenti AI probabilmente continuerà nel 2026. I datori di lavoro devono garantire che i loro strumenti AI non discriminino dipendenti o candidati, ad esempio utilizzando AI per filtrare i curriculum. Non è una difesa dire “l’algoritmo lo ha fatto”; i datori di lavoro rimangono pienamente responsabili degli esiti degli strumenti AI che impiegano.

Assicurare la conformità alle leggi esistenti sul lavoro

I datori di lavoro dovrebbero anche assicurarsi che qualsiasi strumento AI utilizzato sia conforme alle leggi esistenti sul lavoro. Devono, ad esempio, garantire che vengano considerate le necessarie sistemazioni per le disabilità relative agli strumenti e alle valutazioni di assunzione. Inoltre, gli strumenti AI possono presentare vari rischi se non gestiti con attenzione, come un sistema AI che sostituisce compiti di lavoratori esenti dalla Fair Labor Standards Act, rischiando di annullare lo stato esente di un dipendente.

I datori di lavoro possono affrontare queste questioni implementando buone politiche e controlli nell’uso dell’AI per le funzioni HR. Alcuni aspetti da considerare includono:

-

Sviluppo di politiche di governance dell’AI

I datori di lavoro dovrebbero attuare politiche e linee guida chiare riguardanti quando e come può essere utilizzata l’AI nelle funzioni di assunzione, monitoraggio del tempo dei lavoratori e produttività. Queste politiche dovrebbero includere discussioni su adeguata supervisione umana e requisiti legali da considerare.

-

Valutazione dei fornitori

I fornitori dovrebbero essere trasparenti su come funzionano i loro sistemi AI, inclusi i test di bias effettuati secondo i requisiti legali. I datori di lavoro dovrebbero garantire che i fornitori si impegnino contrattualmente a test di bias continui e, ove possibile, assumano responsabilità contrattuali per esiti discriminatori.

-

Audit degli strumenti AI per il bias

Gli audit di bias sono essenziali e dovrebbero essere effettuati secondo i requisiti legali per mitigare i rischi di discriminazione. Gli audit dovrebbero esaminare non solo gli esiti per i gruppi protetti, ma anche i dati di addestramento e come i manager si affidano effettivamente agli strumenti in pratica.

-

Formazione e supervisione adeguata

Una formazione adeguata per chi utilizza o si affida agli strumenti AI per le funzioni HR è fondamentale. I professionisti HR e i manager devono comprendere i limiti degli strumenti e sapere quando è necessario l’intervento umano.