Russia Pianifica Ampi Poteri per Vietare o Limitare Strumenti AI Stranieri

Regolamenti AI Proposti e Loro Implicazioni

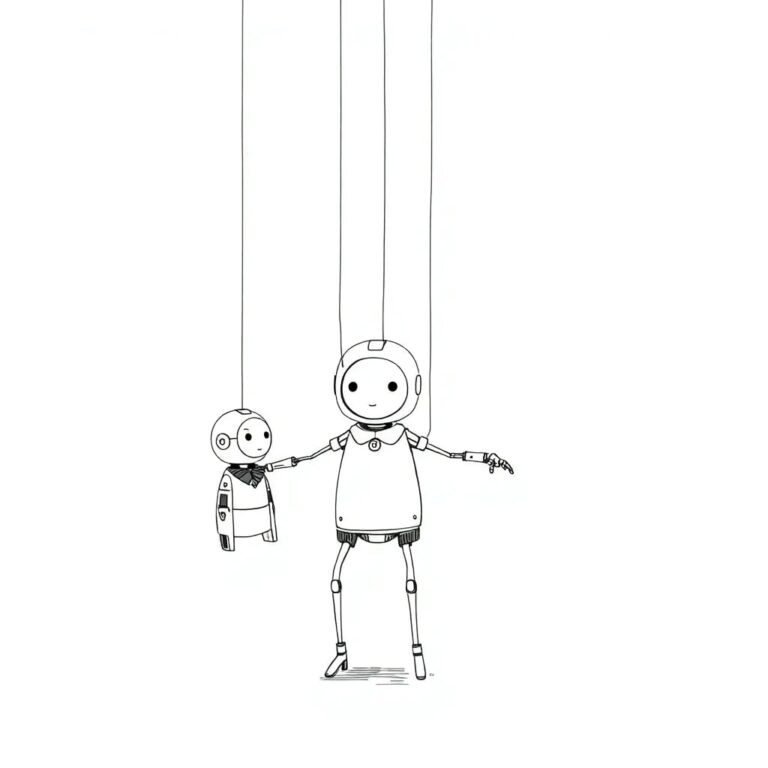

Strumenti AI stranieri come Claude, ChatGPT e Gemini potrebbero essere vietati o limitati all’interno della Russia se non rispondono a nuove regole che darebbero a Mosca ampi poteri per regolare il settore, secondo le proposte governative pubblicate online.

Proposte Governative e Obiettivi

Le proposte, pubblicate dal Ministero per lo Sviluppo Digitale della Russia, estenderanno al fiorente settore dell’AI la spinta della Russia a stabilire un internet sovrano, protetto da influenze straniere e rispettoso di quelli che definisce “valori spirituali e morali tradizionali russi”.

Il Ministero ha dichiarato che le nuove regole sono progettate per “proteggere i cittadini da manipolazioni occulte e algoritmi discriminatori”.

Limitazione della Tecnologia AI Transfrontaliera

L’iniziativa, che probabilmente avvantaggerà gli strumenti AI nazionali sviluppati da istituti statali, è stata resa pubblica in un momento in cui lo stato russo sta rafforzando il controllo su internet.

Le normative dovrebbero entrare in vigore il prossimo anno dopo ulteriori revisioni e approvazioni governative.

Portata delle Restrizioni Proposte

Le norme stabiliscono che “il funzionamento delle tecnologie di intelligenza artificiale transfrontaliere può essere vietato o limitato nei casi specificati dalla legislazione della Federazione Russa”.

Secondo un’agenzia di stampa statale, gli strumenti AI stranieri rientrerebbero nelle nuove regole poiché inevitabilmente trasferirebbero i dati dei cittadini russi all’estero.

Potenziali Eccezioni e Requisiti di Conformità

Tuttavia, altri strumenti AI stranieri ma aperti, come quelli provenienti da altre nazioni, potrebbero essere adattati e implementati in un ambiente chiuso sulle infrastrutture proprietarie delle organizzazioni e delle aziende governative russe, poiché tutti i dati trattati rimarrebbero all’interno di tale infrastruttura.

Le normative prevedono che i modelli AI utilizzati da più di 500.000 persone al giorno debbano memorizzare le informazioni degli utenti russi nel territorio russo per tre anni per essere conformi al nuovo regime normativo.

Le aziende tecnologiche occidentali, in passato, hanno rifiutato di rispettare tali richieste.

Conclusioni

Le nuove proposte di regolamentazione dell’AI in Russia rappresentano un passo significativo verso un maggiore controllo governativo sulla tecnologia e sui dati, evidenziando le tensioni tra il paese e le aziende tecnologiche occidentali.