Vietare la Regolamentazione dell’IA Sarebbe un Disastro

Recentemente è stata annunciata l’intenzione di firmare un’ordinanza esecutiva per vietare la regolamentazione dell’IA a livello statale. I sostenitori di questa proposta sostengono che la competitività dipenda dalla deregulation, affermando che le normative a livello statale ostacolano l’innovazione e indeboliscono la posizione degli Stati Uniti nella competizione tecnologica globale.

Vulnerabilità Nazionale e Sicurezza

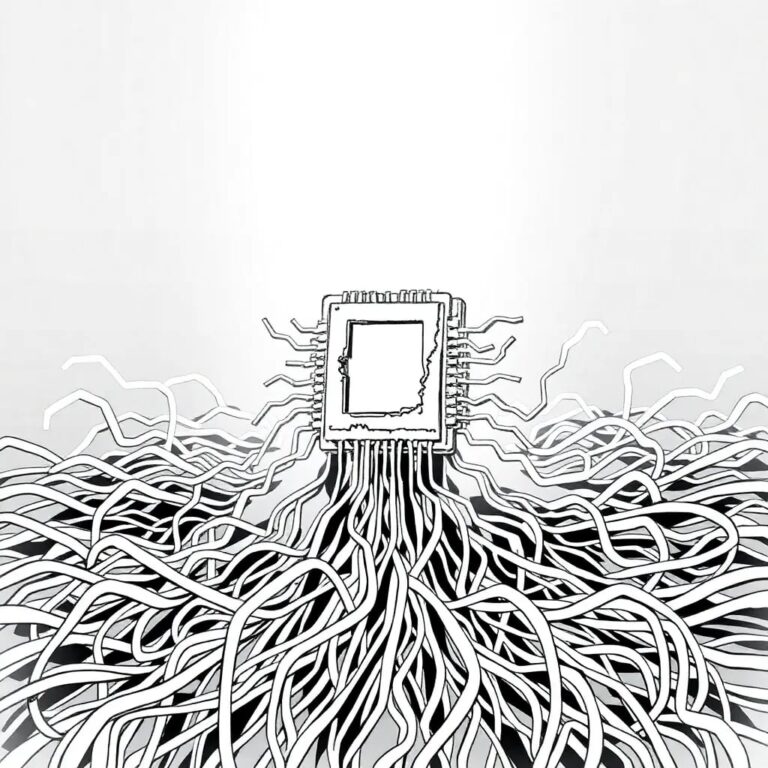

Le vulnerabilità più serie riguardanti la sicurezza nazionale nell’ambito dell’IA non derivano da una supervisione eccessiva, ma dalla sua assenza. I sistemi IA sono già fondamentali per il funzionamento di settori essenziali come la gestione degli aeroporti e la rilevazione delle frodi. Tuttavia, questi sistemi presentano anche punti di guasto concentrati che possono essere facilmente attaccati.

Ogni punto critico diventa un obiettivo attraente per gli avversari, che sanno che le infrastrutture cruciali dipendono da algoritmi opachi e non regolamentati. Un singolo output manipolato può avere conseguenze devastanti, come spegnere l’energia in un’intera regione o destabilizzare i mercati finanziari.

Minacce Emergenti e Conflitti Cibernetici

Negli ultimi tempi, le minacce si sono evolute da operazioni di influenza a veri e propri conflitti cibernetici. Recentemente, sono stati segnalati attacchi informatici che utilizzano malware potenziato dall’IA. Le aziende tecnologiche, invece di affrontare questi rischi, stanno investendo somme ingenti in campagne di lobbying per evitare regolamentazioni che potrebbero prevenire danni prevedibili.

Regolamentazione Necessaria per la Sicurezza

Contrariamente a quanto sostenuto da alcune aziende, la regolamentazione non deve necessariamente rallentare l’innovazione. Regole chiare possono favorire la crescita, rendendo i sistemi più sicuri e robusti prima di essere implementati su larga scala. I legislatori a livello statale stanno cercando di affrontare problemi come le frodi e gli attacchi informatici, che sono parte integrante della sicurezza nazionale.

Il Ruolo degli Stati nella Politica dell’IA

Gli stati rappresentano i laboratori più efficaci per lo sviluppo di politiche relative a tecnologie complesse. Mentre il Congresso ha tentato senza successo di introdurre una serie di leggi, gli stati stanno rapidamente testando e affinando approcci che possono fornire prove concrete per una regolamentazione efficace.

Conclusione

La soluzione ai rischi associati all’IA non è quella di smantellare la supervisione, ma di progettare una regolamentazione adeguata. La leadership degli Stati Uniti nell’IA non sarà garantita indebolendo le poche salvaguardie esistenti, ma piuttosto attraverso regole solide in grado di resistere agli attacchi di avversari reali.