Rischi senza confini: l’uso malevolo dell’IA e l’estensione globale della legge europea sull’IA

Messaggi chiave

La legge europea sull’intelligenza artificiale (IA) è una delle prime normative vincolanti sull’IA a livello mondiale. I responsabili politici dell’UE intendono che serva come modello per la governance globale dell’IA, facendo affidamento sul cosiddetto Effetto Bruxelles.

In un dominio in rapida evoluzione e trasformativo come l’IA, la qualità normativa è un prerequisito per influenzare come modello. In questo caso, la qualità include la copertura adeguata dei rischi più critici associati all’uso, al dispiegamento e all’adozione dell’IA.

Tra questi rischi vi è l’uso malevolo, che deriva dall’uso intenzionale delle capacità dell’IA per causare danno. Questa analisi verifica le disposizioni della legge sull’IA rispetto ai rischi di uso malevolo.

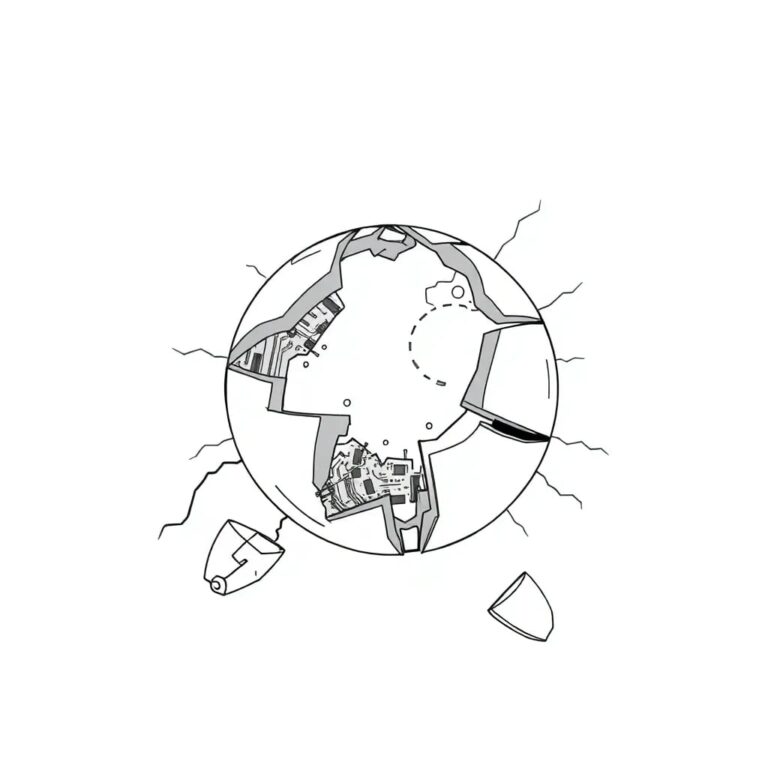

I risultati rivelano che la copertura dei rischi di uso malevolo da parte della legge sull’IA è disomogenea: mentre alcuni rischi sono affrontati direttamente, altri sono trattati solo indirettamente attraverso altre normative europee o nazionali, o attraverso iniziative internazionali.

Lasciando gap significativi, la legge sull’IA mina il proprio valore come modello globale.

Analisi

Gli sforzi per la sicurezza dell’IA di fronte alle pressioni competitive sono diventati cruciali. In questo contesto geopolitico, la corsa per la leadership nell’IA tra stati e corporazioni si concentra sulle capacità tecnologiche, non sulla sicurezza e sulla gestione dei rischi.

Negli Stati Uniti, è stato rilasciato il Piano d’Azione sull’IA, mirante a posizionare l’IA americana come standard globale. Questo è perseguito attraverso un approccio normativo prevalentemente laissez-faire, che ha incluso la revoca di ordini esecutivi sulla sicurezza dell’IA.

La Cina, parallelamente, sta perseguendo una leadership globale nell’IA entro il 2030, attraverso politiche industriali coordinate lungo l’intera catena del valore dell’IA.

L’UE ha riconosciuto questo panorama competitivo e ha lanciato un Piano d’Azione sull’IA, mirante a mobilitare infrastrutture informatiche, dati, talenti, algoritmi e regolamenti.

Discrepanze nei quadri di rischio dell’IA

La legge sull’IA impone obblighi sui fornitori e sui dispiegatori di sistemi di IA, basandosi sull’intensità dei rischi delle loro potenziali applicazioni. Tuttavia, la sua concettualizzazione del rischio è solo uno dei molti sviluppati da industrie, governi e organizzazioni internazionali.

I rischi di uso malevolo possono essere ulteriormente suddivisi in sub-rischi. Questa analisi esamina la copertura della legge sull’IA rispetto a nove sub-rischi identificati, che includono armi biologiche, IA intenzionali ribelli, disinformazione e contenuti abusivi, tra gli altri.

La legge sull’IA offre una copertura squilibrata dei rischi di uso malevolo. Alcuni sub-rischi ricevono una copertura diretta, mentre altri sono solo parzialmente affrontati.

Conclusioni

La legge sull’IA dell’UE è un passo importante per la governance dell’IA, ma la sua portata e influenza globale saranno limitate non solo da ostacoli all’implementazione, ma anche dalla sua progettazione. I responsabili politici devono riconoscere le sue significative limitazioni nella copertura dei rischi.

La copertura dei rischi di uso malevolo è solo una dimensione di un insieme più ampio di rischi catastrofici posti dall’IA. Non bisogna trascurare che la semplice replicazione della legge sull’IA all’estero non sarà sufficiente per prevenire danni.