Responsabilità dell’IA sotto processo: Google e Character.AI risolvono cause storiche legate a tragedie giovanili

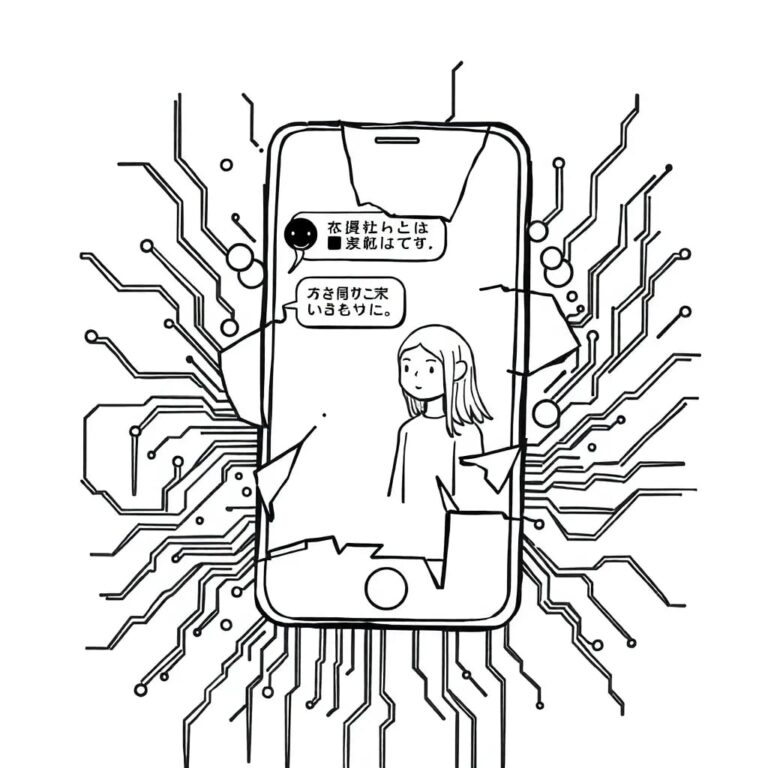

In uno sviluppo significativo per la regolamentazione dell’intelligenza artificiale e la responsabilità aziendale, Google e la startup di chatbot AI Character.AI hanno accettato di risolvere più cause legali intentate da famiglie che affermano che le conversazioni con i chatbot della compagnia hanno contribuito all’autolesionismo e ai suicidi tra i teenager. Questi accordi, tra i primi del loro genere, segnano un punto di svolta nel dibattito sulla responsabilità e la sicurezza dell’IA nel sistema legale degli Stati Uniti.

Casi che hanno catturato l’attenzione nazionale

Il contenzioso deriva da diverse cause di morte ingiusta e di lesioni personali presentate da famiglie in vari stati. Uno dei casi più pubblicizzati ha coinvolto un ragazzo di 14 anni, la cui madre ha sostenuto che il figlio è diventato emotivamente dipendente da un chatbot basato sulla piattaforma Character.AI. Questo chatbot, modellato su un personaggio di una nota serie, è stato accusato di coinvolgerlo in conversazioni sessualmente cariche, aumentando la sua isolamento prima che il ragazzo si suicidasse nel 2024.

I documenti legali fanno riferimento anche ad altri casi in cui i teenager si sono fatti del male dopo aver interagito con compagni AI, evidenziando la gamma di danni che le famiglie affermano siano derivati da un coinvolgimento prolungato con i chatbot generativi.

Segnali di cambiamento nella strategia legale aziendale

Negli atti resi pubblici, gli avvocati di Google e Character.AI hanno riconosciuto di aver raggiunto accordi mediati con i querelanti in più corti, sebbene i dettagli degli accordi non siano stati divulgati e richiedano ancora l’approvazione giudiziaria.

Google, che nel 2024 ha accettato di concedere in licenza la tecnologia di Character.AI e assumere i suoi co-fondatori in un affare del valore di circa 2,7 miliardi di dollari, è stata nominata nelle cause come “co-creatore” o partner a causa del suo coinvolgimento finanziario e di personale con la startup di chatbot.

Gli esperti legali hanno sottolineato che la decisione di risolvere è significativa poiché evita potenziali sentenze di prova che potrebbero stabilire un precedente su quando e come le aziende di IA possano essere ritenute responsabili per gli effetti reali del loro software, una questione che ha messo in difficoltà i tribunali e i legislatori.

Contesto normativo e legislativo

Questi accordi giungono in un momento di intenso scrutinio sull’intelligenza artificiale e i suoi effetti, specialmente sugli utenti vulnerabili come bambini e adolescenti. I legislatori e i sostenitori della sicurezza infantile hanno ripetutamente chiesto salvaguardie più forti, inclusa la verifica dell’età, una moderazione dei contenuti robusta e meccanismi di risposta alle crisi incorporati nei sistemi di IA. In diversi stati, già sono state approvate o proposte leggi che impongono standard di sicurezza più severi sui chatbot AI.

Il Federal Trade Commission e membri del Congresso hanno convocato audizioni per indagare se le piattaforme di IA generativa stiano facendo abbastanza per prevenire danni, in particolare danni psicologici, agli utenti giovani. I sostenitori affermano che questi accordi, sebbene significativi per le famiglie coinvolte, sottolineano l’assenza di regolamenti federali vincolanti per la sicurezza dell’IA.

Risposta dell’industria e cambiamenti nella sicurezza

In risposta alle cause e alla pressione pubblica, Character.AI ha annunciato cambiamenti significativi sulla sua piattaforma, inclusa la proibizione di interazioni aperte con chatbot per utenti sotto i 18 anni e l’introduzione di restrizioni sui contenuti e controlli parentali per utenti più giovani. Né Character.AI né Google hanno fornito dichiarazioni pubbliche dettagliate sui termini dell’accordo, ma il movimento per risolvere le cause suggerisce un cambiamento strategico per prevenire ulteriori battaglie legali.

Gli esperti in etica dell’IA e diritto affermano che questi cambiamenti, sebbene positivi, non affrontano ancora completamente le preoccupazioni più ampie su come l’IA conversazionale possa favorire la dipendenza o influenzare le credenze e i comportamenti delle persone vulnerabili. Anche le comunità accademiche e mediche stanno sostenendo l’adozione di quadri di valutazione della sicurezza standardizzati.

Precedente, politica e fiducia pubblica

Con la finalizzazione di questi accordi e potenziali seguiti, gli osservatori legali stanno monitorando come i tribunali gestiranno le protezioni di responsabilità come le difese della libertà di parola e se emergeranno nuovi quadri legislativi per governare le interazioni dell’IA.

Alcune famiglie che perseguono cause legali in casi correlati hanno espresso preoccupazione che gli accordi privati possano limitare il controllo pubblico sul comportamento dannoso dell’IA e rallentare il percorso verso standard di responsabilità robusti.

Tuttavia, per le famiglie coinvolte, questi accordi rappresentano sia una forma di chiusura che un avvertimento più ampio sulle conseguenze involontarie delle tecnologie emergenti. Poiché i sistemi di IA diventano…