Introduzione

Il progresso rapido dell’intelligenza artificiale (IA) crea una pressione competitiva che ostacola gli investimenti nella sicurezza. Quando le aziende investono di più nella sicurezza, rischiano di perdere clienti e finanziamenti, mentre quelle che riducono i controlli di sicurezza ottengono vantaggi competitivi.

Analisi del modello autoregolamentato

Problemi fondamentali

Quattro sfide principali ostacolano la regolamentazione efficace dell’IA: competizione che induce una corsa al ribasso della sicurezza, asimmetria informativa tra autorità e laboratori, problema di ritmo dovuto alla velocità dell’innovazione e la necessità di intervenire ex ante per evitare danni irreversibili.

Modello degli organismi autoregolamentati (SRO)

Un modello consolidato nei mercati finanziari prevede organizzazioni autoregolamentate supervisionate dal governo. Queste entità scrivono regole vincolanti per i membri, soggette all’approvazione governativa, e possiedono poteri di applicazione, inclusi sanzioni e sospensioni.

Implicazioni e rischi

Applicazione al settore IA

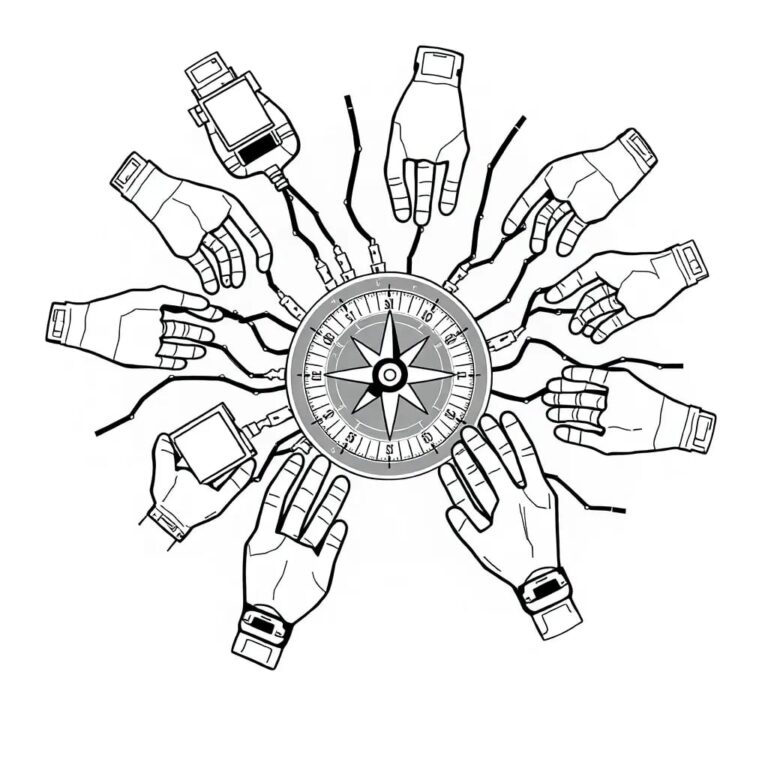

Trasferire il modello SRO all’IA consentirebbe una coordinazione tra laboratori senza violare le leggi antitrust. La supervisione governativa garantirebbe che le regole rimangano aggiornate con l’evoluzione tecnologica, riducendo l’asimmetria informativa.

Un ente supervisore potrebbe imporre requisiti di test pre‑distribuzione, monitoraggio continuo e meccanismi di interruzione per modelli potenzialmente pericolosi, riducendo il rischio di danni catastrofici.

Conclusione

Un organismo autoregolamentato, supportato da un’agenzia governativa, offre una soluzione praticabile per affrontare le sfide di competizione, informazione, ritmo e rischio nell’IA. Questo approccio combina l’expertise del settore con la responsabilità pubblica, creando un quadro normativo più flessibile e reattivo rispetto alle tradizionali forme di regolamentazione.