La patchwork normativa dell’IA negli Stati Uniti: un ostacolo per le startup e un vantaggio per la Cina

Quando la startup di guida autonoma ha cercato di orientarsi tra le normative americane sull’intelligenza artificiale, aveva previsto un budget di 10.000 dollari per la conformità. Tuttavia, il costo reale ha superato i 344.000 dollari per ogni progetto di implementazione, più del doppio dei costi di ricerca e sviluppo dell’azienda. Due mesi fa, la startup ha chiuso i battenti.

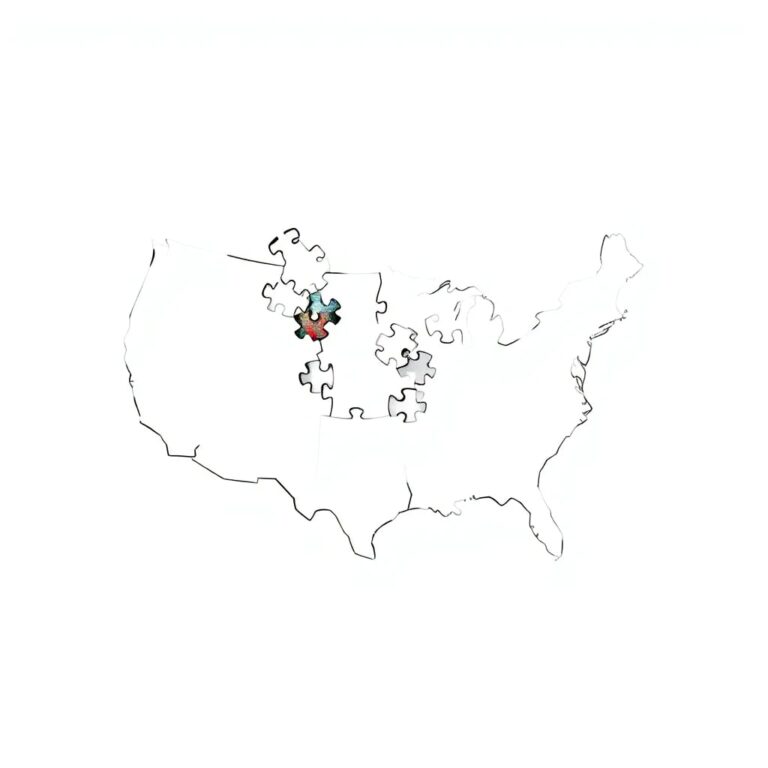

Lo scorso anno, gli stati hanno introdotto oltre 1.200 progetti di legge relativi all’IA, di cui almeno 145 sono diventati legge, creando requisiti contraddittori che moltiplicano i carichi di conformità. Ogni giurisdizione definisce “intelligenza artificiale”, “sistemi ad alto rischio” e “decisioni consequenziali” in modo diverso, costringendo le aziende ad analizzare tecnologie identiche secondo più quadri normativi incompatibili.

Uno strumento di assunzione che soddisfa i requisiti di registrazione e test anti-bias della California deve anche rispettare i mandati di valutazione dell’impatto del Colorado e il regime di audit bias indipendente di New York City, con requisiti di notifica distinti. Ogni giurisdizione definisce i termini chiave in modo diverso, costringendo le aziende ad analizzare sistemi identici secondo più quadri normativi incompatibili.

Le stime del settore suggeriscono che i costi di conformità aggiungono circa il 17% di sovraccarico alle spese dei sistemi di IA. Per le piccole imprese, i requisiti di privacy e cybersecurity della California impongono quasi 16.000 dollari di costi annui di conformità. Tuttavia, queste cifre sottovalutano il vero onere, poiché considerano la conformità come un costo variabile che cresce con la dimensione dell’azienda. La realtà è ben peggiore.

I ricercatori della Harvard Kennedy School hanno identificato quello che hanno definito una “trappola di conformità”, in cui i costi normativi consumano risorse più velocemente di quanto le startup possano generare entrate. La loro analisi ha scoperto che un aumento del 200% nei costi di conformità fissi trasforma il margine operativo di una startup da positivo 13% a negativo 7%. Questa non è una semplice approssimazione; è la differenza tra la sopravvivenza e la bancarotta.

Un team di tre persone che costruisce uno strumento di screening per l’occupazione affronta gli stessi obblighi di conformità di un’azienda con mille persone in molte giurisdizioni, ma senza la base di entrate o l’infrastruttura legale per assorbire quei costi.

Implicazioni strategiche

Questa dinamica offre un enorme vantaggio competitivo alle aziende consolidate che le normative statali intendono limitare. Le grandi aziende tecnologiche mantengono dipartimenti di conformità che superano in numero intere startup. Possono permettersi team legali multi-giurisdizionali, framework di audit bias personalizzati e relazioni politiche necessarie per plasmare i requisiti emergenti. Per loro, la frammentazione dell’IA statale rappresenta un costo gestibile. Per le startup, invece, rappresenta una barriera insormontabile all’ingresso.

Le implicazioni strategiche sono enormi. Mentre gli imprenditori americani disperdono talenti ingegneristici su regimi di conformità contraddittori, le aziende cinesi di IA operano sotto un quadro nazionale unificato. L’approccio di Pechino non è certo un modello di regolamentazione leggera, ma offre ciò che il patchwork americano non può: regole coerenti che non cambiano da uno stato all’altro.

Conclusione

Quando i costi di conformità superano i budget di sviluppo, l’innovazione non rallenta; si ferma del tutto o si sposta in giurisdizioni straniere dove le regole sono chiare. La Casa Bianca ha riconosciuto questo pericolo competitivo in un ordine esecutivo di dicembre 2025, criticando il “patchwork di 50 diverse normative” e ordinando al Dipartimento di Giustizia degli Stati Uniti di stabilire un Task Force per le controversie sull’IA per sfidare le leggi statali che ostacolano la politica nazionale sull’IA. Tuttavia, l’azione esecutiva da sola non può risolvere un problema radicato nella frammentazione legislativa. Il Congresso deve agire.

Leggi di prevaricazione federale stabilirebbero standard nazionali uniformi per i sistemi di IA, preservando al contempo la capacità degli stati di far rispettare le leggi generali di protezione dei consumatori. Questo non è un concetto radicale. I quadri federali già governano la sicurezza aerea, le approvazioni farmaceutiche e le telecomunicazioni, settori in cui la variazione da stato a stato creerebbe caos identico.

Le attuali traiettorie sono insostenibili. Ogni mese che passa con questo caos normativo intatto rappresenta un altro mese di innovazione americana ceduta a concorrenti meglio organizzati. I legislatori statali hanno progettato i loro quadri di IA per limitare il potere delle grandi aziende tecnologiche. Invece, hanno costruito un fossato attorno agli incumbents, schiacciando le startup che potrebbero sfidarli. La trappola della conformità non protegge i consumatori. Protegge i monopoli e conferisce un vantaggio competitivo a avversari stranieri. Questa non è regolamentazione; è autolesionismo.