Un altro anno, un’altra sessione di sovraregolamentazione dell’IA

Con l’inizio della sessione legislativa del 2026, una nuova e significativa fase nella discussione su libertà di espressione e intelligenza artificiale si sta delineando. Un’altra serie di proposte di legge sull’IA è pronta a stabilire come le persone possano utilizzare le macchine per comunicare, sollevando questioni fondamentali sulla libertà di espressione.

Il Primo Emendamento e l’Intelligenza Artificiale

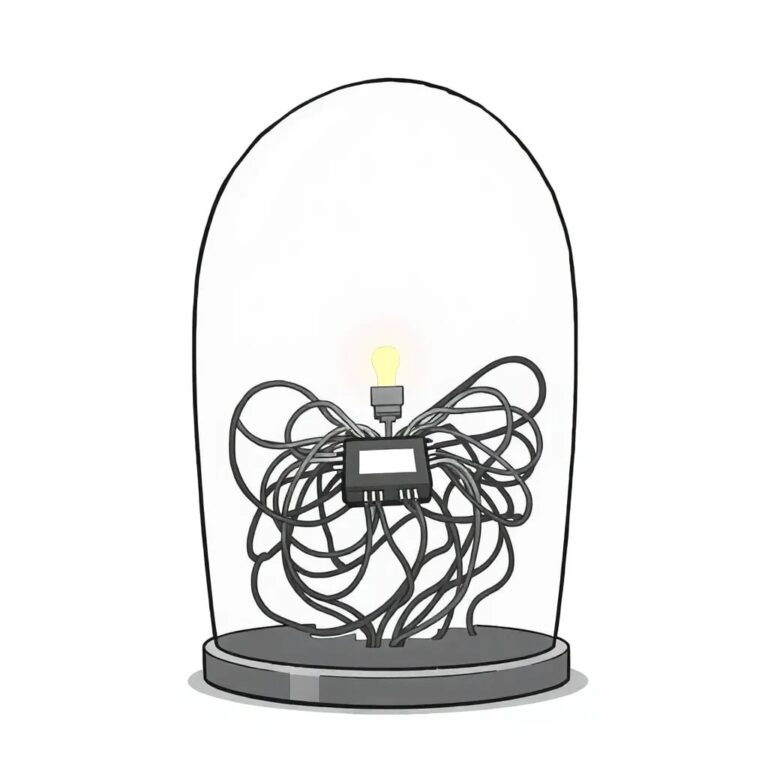

Il Primo Emendamento si applica all’intelligenza artificiale nello stesso modo in cui si applica a tecnologie espressive precedenti. Come la stampa, la fotografia, Internet e i social media, l’IA è uno strumento che le persone usano per comunicare idee, accedere a informazioni e generare conoscenza. Indipendentemente dal mezzo utilizzato, la nostra Costituzione protegge queste forme di espressione.

Con la revisione della politica sull’IA nel 2026, è importante notare che le leggi esistenti già affrontano molti dei problemi che si cerca di risolvere, come frode, falsificazione, diffamazione, discriminazione e interferenze elettorali, indipendentemente dall’uso dell’IA. La frode rimane frode, sia che si utilizzi una penna o una tastiera.

Preoccupazioni per il Primo Emendamento

Molti dei progetti di legge sull’IA introdotti quest’anno si basano su approcci normativi che sollevano serie preoccupazioni per il Primo Emendamento. Alcuni richiederebbero che gli sviluppatori o gli utenti allegassero avvertenze o dichiarazioni alle espressioni generate legalmente dall’IA, costringendoli a fungere da portavoce governativi per opinioni che potrebbero non condividere. Queste preoccupazioni si applicano anche ai sistemi di IA.

La legislazione relativa ai deepfake legati alle elezioni rimane un focus centrale nel 2026. Negli ultimi mesi, diversi stati hanno introdotto proposte di legge per controllare i contenuti politici generati dall’IA, ma queste leggi spesso limitano il discorso politico fondamentale, e i tribunali hanno applicato la giurisprudenza consolidata del Primo Emendamento per dichiararle incostituzionali.

Restrizioni sui Chatbot

Un’altra crescente categoria di legislazione cerca di restringere i chatbot, utilizzando quadri normativi presi dalle leggi sui social media. Queste includono requisiti di avviso che dicono agli utenti che stanno interagendo con un’IA, coinvolgendo molte interazioni ordinarie a basso rischio dove non è necessaria alcuna avvertenza. Altre proposte proibirebbero categoricamente ai chatbot di essere addestrati per fornire “supporto emotivo” agli utenti, imponendo una regolamentazione diretta e confusa sul tono e sul contenuto delle risposte generate dall’IA.

Rischi delle Normative Ampie

Le leggi di vasta portata sull’IA sono tornate quest’anno, con almeno uno stato che ha introdotto una proposta simile. Queste leggi cercano di imporre quadri normativi complessi sugli sviluppatori e gli utenti dell’IA, attraverso un controllo governativo espansivo e una responsabilità per l’uso di strumenti di IA. Quando applicate a sistemi di IA espressivi, queste normative sollevano preoccupazioni significative per il Primo Emendamento.

Affrontare danni reali, come frode e discriminazione, è un obiettivo legislativo legittimo. Tuttavia, l’esperienza accumulata nel difendere la libertà di espressione mostra che la regolamentazione vaga e preventiva degli strumenti espressivi spesso frena il discorso legittimo senza affrontare efficacemente le condotte illecite.

Conclusioni

Piuttosto che mirare al discorso politico o imporre restrizioni sull’accesso agli strumenti espressivi, i funzionari governativi dovrebbero utilizzare gli strumenti legali già disponibili per affrontare le condotte illecite senza compromettere l’espressione protetta e l’innovazione. Qualora esistano lacune, qualsiasi risposta legislativa dovrebbe essere ristretta, precisa e focalizzata su condotte attuabili.