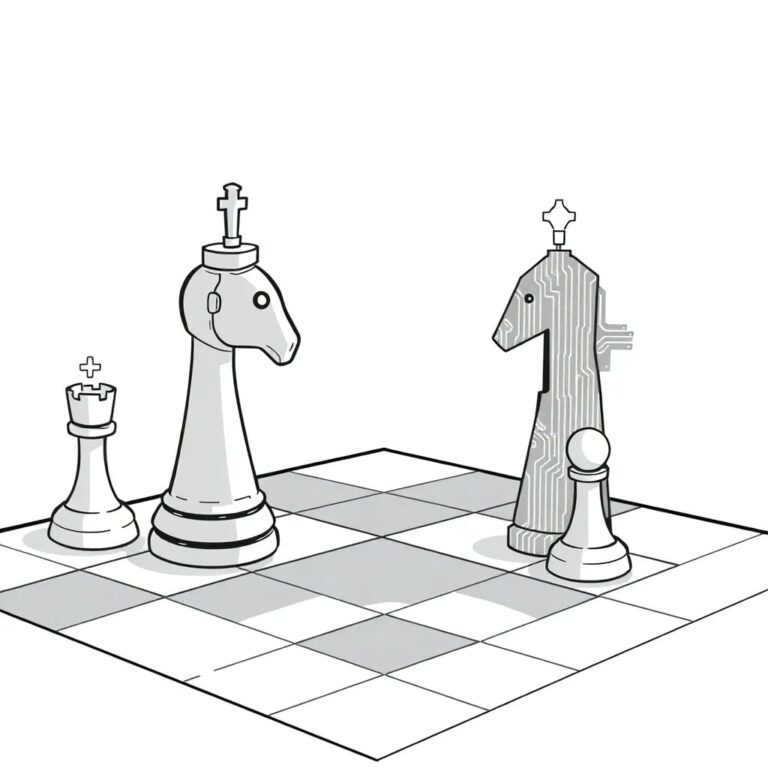

Quando l’IA decide come votano gli azionisti, i consigli devono ripensare la governance

Quando una delle più grandi istituzioni finanziarie del paese ha annunciato all’inizio di gennaio che avrebbe smesso di utilizzare società di consulenza esterne per le votazioni e si sarebbe invece affidata a un sistema interno di intelligenza artificiale per guidare le decisioni di voto su questioni azionarie, il cambiamento è stato ampiamente inquadrato come una storia per gli investitori. Ma le sue implicazioni vanno ben oltre i gestori patrimoniali.

Per i consigli aziendali, questo cambiamento segnala qualcosa di più fondamentale: la governance è sempre più interpretata non solo da persone, ma anche da macchine. E la maggior parte dei consigli non ha ancora pienamente compreso cosa significhi.

Perché le società di consulenza proxy sono diventate così potenti

Le società di consulenza proxy non sono nate per diventare broker di potere. Sono emerse per risolvere problemi pratici di scala e coordinamento.

Con l’aumento della proprietà azionaria da parte di investitori istituzionali in migliaia di aziende, il voto per delega è aumentato notevolmente, coprendo tutto, dalle elezioni dei direttori e compensi esecutivi a fusioni e una serie di proposte azionarie. Votare responsabilmente in questo contesto richiedeva tempo, competenza e infrastrutture che molte aziende non avevano.

Le società di consulenza proxy hanno colmato questa lacuna aggregando dati, analizzando le comunicazioni e offrendo raccomandazioni di voto. Nel tempo, un piccolo numero di aziende ha dominato il mercato. La loro influenza è cresciuta non perché gli investitori fossero obbligati a seguirle, ma perché l’allineamento era efficiente, difendibile e verificabile.

Perché il modello sta cambiando

Le forze che hanno consentito la scalabilità delle società di consulenza proxy hanno anche esposto la tensione tra efficienza e giudizio. Le politiche standardizzate hanno portato coerenza, ma spesso a scapito del contesto. Decisioni di governance complesse sono state sempre più ridotte a risultati binari.

Lo scrutinio politico e normativo si è intensificato, e i gestori patrimoniali hanno cominciato a porsi una domanda fondamentale: se il voto per delega è una responsabilità fiduciaria centrale, perché così tanto giudizio è esternalizzato?

Il risultato è stata una graduale ristrutturazione. Le società di consulenza proxy si stanno allontanando dalle raccomandazioni universali. I grandi investitori stanno costruendo capacità interne di stewardship. E ora, l’intelligenza artificiale è entrata in gioco.

Cosa cambia l’IA e cosa non cambia

L’IA promette ciò che una volta facevano le società di consulenza proxy: scala, coerenza e velocità. I sistemi sono progettati per elaborare migliaia di riunioni, documenti e comunicazioni in modo efficiente.

Tuttavia, l’IA non elimina il giudizio. Lo sposta. Il giudizio ora risiede a monte, nella progettazione del modello, nei dati di addestramento, nel peso delle variabili e nei protocolli di override. Queste scelte sono altrettanto significative quanto la politica di voto di una società di consulenza proxy.

Per i consigli, questo cambia il pubblico per le divulgazioni di governance. Non sono più solo analisti umani a leggere tra le righe. Sempre più, sono algoritmi che leggono letteralmente, storicamente e senza contesto, a meno che i consigli non forniscano quel contesto.

Le domande di governance che i consigli non hanno ancora posto

Questo cambiamento solleva una serie di domande con cui molti consigli non hanno ancora interagito completamente.

- Come siamo valutati? I sistemi di IA possono attingere a documenti, chiamate sugli utili, siti web, copertura mediatica e altre fonti pubbliche. I segnali di governance ora si accumulano continuamente, non solo durante la stagione delle votazioni.

- Dove potremmo essere fraintesi? Il linguaggio che funziona per i lettori umani: sfumature, discrezione, impegni in evoluzione, può confondere le macchine. L’ambiguità può essere interpretata come incoerenza.

- Quando qualcosa va storto, chi è responsabile? Non esiste un processo di appello universale per i voti proxy informati dall’IA. La responsabilità potrebbe alla fine ricadere sul gestore patrimoniale, ma i percorsi di escalation potrebbero essere opachi, informali o lenti, in particolare per i voti di routine.

I consigli dovrebbero assumere che se un algoritmo fraintende la loro governance, potrebbe non esserci un analista da contattare e nessun modo chiaro per correggere il record prima che venga espresso il voto.

Scenario da considerare

Il presidente del consiglio di un’azienda condivide un nome con un ex dirigente di un’altra azienda coinvolta in una controversia di governance alcuni anni fa. Un sistema di IA che analizza informazioni pubbliche associa la controversia con la persona sbagliata, elevando silenziosamente il rischio percepito di governance prima delle elezioni dei direttori.

Nel frattempo, il consiglio ritarda la successione del CEO di un anno per preservare la stabilità durante una grande acquisizione. La decisione è ponderata e intenzionale, ma la razionalità è dispersa tra documenti, chiamate sugli utili e conversazioni con gli investitori. Il sistema di IA segnala il ritardo come una debolezza di governance.

Pochi giorni prima dell’assemblea annuale, un blog di terze parti pubblica critiche speculative sull’indipendenza del consiglio. Le affermazioni sono infondate ma pubbliche. Il sistema di IA assorbe il contenuto prima che avvenga qualsiasi revisione umana.

Il consiglio non vede mai gli errori. Non c’è un analista con cui interagire, solo un risultato di voto da cui reagire dopo il fatto. Questo non richiede attori cattivi o intenzioni malevoli. È semplicemente ciò che accade quando scala, automazione e ambiguità si intersecano.

Cosa possono e non possono fare i consigli

I consigli non possono controllare come i gestori patrimoniali progettano i loro sistemi di IA. Né dovrebbero cercare di ottimizzare le divulgazioni per gli algoritmi.

Ma i consigli possono governare in modo diverso.

Alcuni consigli stanno già sperimentando divulgazioni narrative più chiare, comprese spiegazioni più esplicite della filosofia di governance, di come vengono effettuati i trade-off e di come viene esercitato il giudizio. Non perché gli algoritmi “se ne importino”, ma perché gli esseri umani progettano, supervisionano e talvolta sovrascrivono questi sistemi.

La chiarezza riduce il rischio di interpretazioni errate. La coerenza abbassa i costi della revisione umana. Il contesto rende più facile per il giudizio sopravvivere all’automazione.

Questo non significa che i consigli debbano spiegare ogni decisione pubblicamente o eliminare la discrezione. La sovra-divulgazione comporta i propri rischi. Ma significa essere deliberati riguardo a quali giudizi richiedono contesto per essere compresi e quali non possono essere lasciati all’inferenza.

I consigli dovrebbero anche ripensare il coinvolgimento. Le conversazioni con gli investitori non possono più concentrarsi solo su politiche e risultati. Dovrebbero includere domande sul processo: dove entra il giudizio umano, quali eventi attivano una revisione, come vengono gestite le dispute fattuali e quanto rapidamente possono essere corretti gli errori.

Non si tratta di padroneggiare l’IA. Si tratta di capire dove risiede la responsabilità quando le decisioni di governance sono mediate dalle macchine.

Governance in un’era algoritmica

In un ambiente di voto assistito dall’IA, alcune assunzioni familiari non tengono più. Il silenzio è raramente neutro. L’ambiguità è raramente benigna. E la coerenza, nel tempo, su piattaforme e divulgazioni, diventerà un asset di governance.

Il cambiamento è importante ora perché i risultati delle votazioni proxy sono sempre più influenzati prima che i consigli si rendano conto che è necessario un confronto.

I consigli che navigheranno meglio questa transizione non saranno quelli che ottimizzano per punteggi o checklist. Saranno i consigli che documentano il giudizio, spiegano i trade-off e raccontano una storia di governance coerente che resiste sia alla lettura di un analista umano, di una società di consulenza proxy o di una macchina.

Questa non è una sfida tecnologica. È una sfida di governance.