Intelligenza Artificiale Ispirata al Cervello: Necessità di Nuove Regole

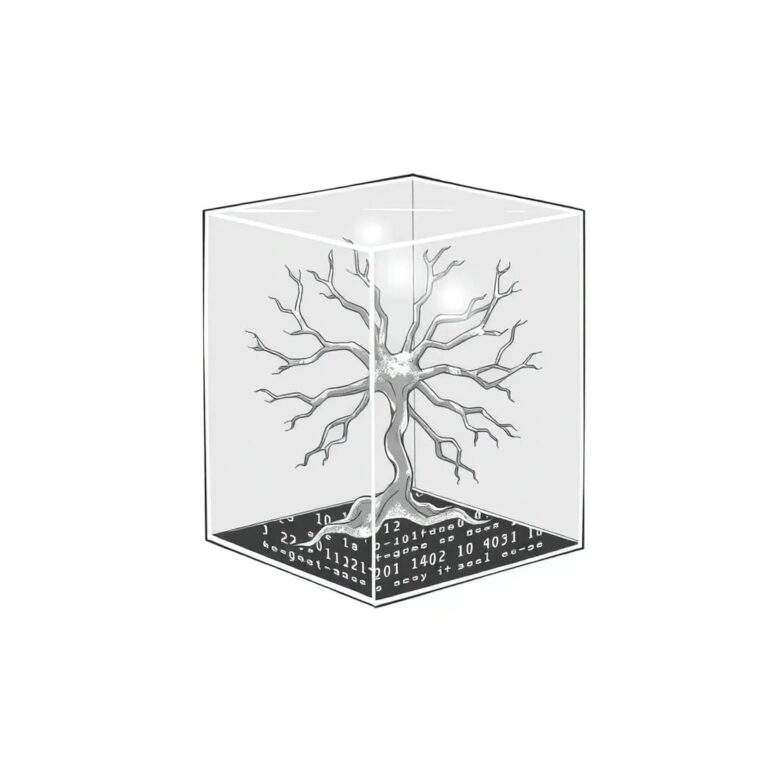

La ricerca sull’intelligenza artificiale ispirata al cervello e sui sistemi neuromorfici sta guadagnando sempre più attenzione, evidenziando le sfide nella loro regolamentazione. Le architetture attuali di governance non sono adeguate per questi sistemi innovativi, progettati per funzionare in modo diverso rispetto alle reti neurali artificiali tradizionali.

Limitazioni delle Attuali Strutture di Governance

Le strutture di governance esistenti, destinate a reti neurali statiche su hardware convenzionale, non si adattano ai sistemi neuromorfici. Questo lavoro sottolinea la necessità di rivedere i metodi di garanzia e audit, proponendo che la regolamentazione evolva insieme ai calcoli ispirati al cervello. Questa co-evoluzione è fondamentale per garantire un controllo efficace delle dinamiche di apprendimento e dell’efficienza uniche dell’IA ispirata al cervello.

Caratteristiche dei Sistemi Neuromorfici

I sistemi neuromorfici si discostano dall’architettura von Neumann, integrando memoria e calcolo e operando in modo asincrono. Utilizzano reti neurali a impulsi, che comunicano tramite impulsi discreti, rendendo necessaria una revisione dei parametri di valutazione tradizionali per accuratezza, latenza ed efficienza energetica. Questi sistemi richiedono approcci proattivi e adattivi per la regolamentazione.

Implicazioni e Rischi

La continua evoluzione dell’IA ispirata al cervello porta con sé sfide etiche e di sicurezza. I cicli di apprendimento continui e le interazioni con dati reali rendono impraticabili i metodi tradizionali di audit e compartimentazione dei dataset. Le implicazioni sono particolarmente significative in applicazioni ad alta criticità come i dispositivi sanitari e i veicoli autonomi, dove la sicurezza e la responsabilità sono fondamentali.

Conclusione

Con la transizione dei sistemi neuromorfici dall’ambito della ricerca a quello delle applicazioni pratiche, è urgente sviluppare metodi di garanzia e audit che si adattino alle architetture dell’IA ispirata al cervello. Solo così si potrà garantire che la sicurezza e l’impatto sociale siano integrati fin dall’inizio nella progettazione di algoritmi e hardware.