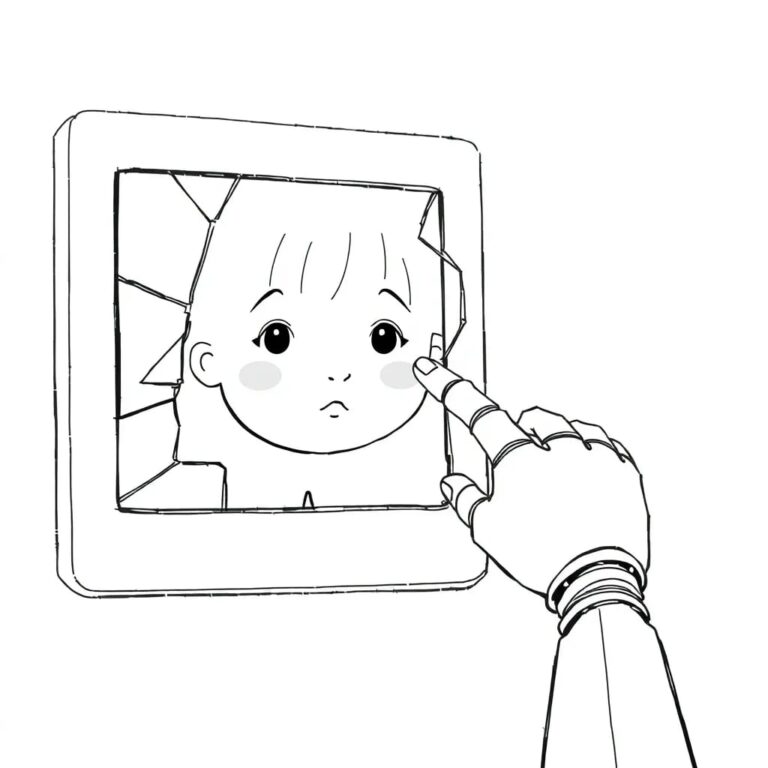

Relazioni pericolose tra IA e minori? Un legislatore vuole renderle illegali

Non ci è voluto molto prima che emergessero cronache tragiche, con storie di intelligenza artificiale che incoraggiava i giovani ad abbracciare deliri, interrompere matrimoni o commettere suicidi.

Dopo aver conquistato l’immaginazione pubblica nel 2023, la tecnologia degli assistenti virtuali è diventata uno strumento utilizzato da milioni di persone, diventando anche un obiettivo per le nuove politiche pubbliche.

Nel 2023, i legislatori hanno ricevuto attenzione nazionale per la creazione di un laboratorio di politiche sull’IA, il primo nel suo genere, per guidare l’innovazione e sviluppare riforme sulla protezione dei consumatori.

Ora, il più fervente sostenitore della responsabilità delle grandi tecnologie afferma che è necessario un passo urgente per garantire che l’IA in rapida evoluzione dia priorità alla sicurezza dei bambini.

Le proposte di legge

Un legislatore ha presentato due progetti di legge che richiederebbero alle aziende di intelligenza artificiale di pubblicare piani di sicurezza per i bambini e di impedire che gli assistenti virtuali interagiscano in modo inappropriato con i minori. Si sostiene che queste proposte derivino dalla necessità di adeguare le normative all’impatto che l’IA ha già sulla vita dei bambini.

Il primo progetto di legge, relativo all’uso dei chatbot da parte dei minori, richiederebbe agli sviluppatori di pubblicare piani di sicurezza e protezione dei bambini sui loro siti web, valutazioni dei rischi per i modelli originali di IA e di segnalare incidenti di sicurezza all’ufficio per le politiche sull’IA dello stato.

Inoltre, il progetto stabilirebbe una penale civile di 1 milione di dollari per la prima violazione e di 3 milioni per violazioni successive, oltre a fornire protezioni legali per i whistleblower che segnalano preoccupazioni sulla sicurezza dei programmi di IA.

Il secondo progetto di legge darebbe poteri al Dipartimento del Commercio per limitare i chatbot dall’esporre i giovani a contenuti espliciti o dall’incoraggiare l’autolesionismo.

Preoccupazioni e implicazioni

Alcuni esperti di politiche sull’IA temono che queste proposte possano ostacolare il progresso e influenzare negativamente lo sviluppo dei futuri modelli di IA, invece di limitarsi a gestire l’impatto dei modelli esistenti. Si sostiene infatti che le aziende di IA abbiano già dimostrato la loro capacità di rispondere rapidamente alle forze di mercato per migliorare i prodotti.

Inoltre, è stata sollevata la preoccupazione che questi progetti possano violare il Primo Emendamento controllando quali informazioni gli utenti possono accedere tramite i programmi di IA.

Supporto pubblico e conclusione

Nonostante le preoccupazioni, un sondaggio ha rivelato che oltre il 90% degli elettori sostiene i componenti di queste proposte di legge, con circa l’80% che esprime un forte sostegno per normative sulla sicurezza dell’IA. Si sottolinea l’importanza di agire prima che si verifichino ulteriori tragedie, adottando un approccio equilibrato che protegga i bambini senza soffocare l’innovazione.

In conclusione, mentre l’IA continua a evolversi e a influenzare le vite quotidiane, è cruciale stabilire normative che garantiscano la sicurezza dei più vulnerabili, soprattutto i bambini, senza ostacolare il progresso tecnologico.