Leggi sulla Sicurezza dell’IA negli Stati: California e New York

KPMG Regulatory Insights

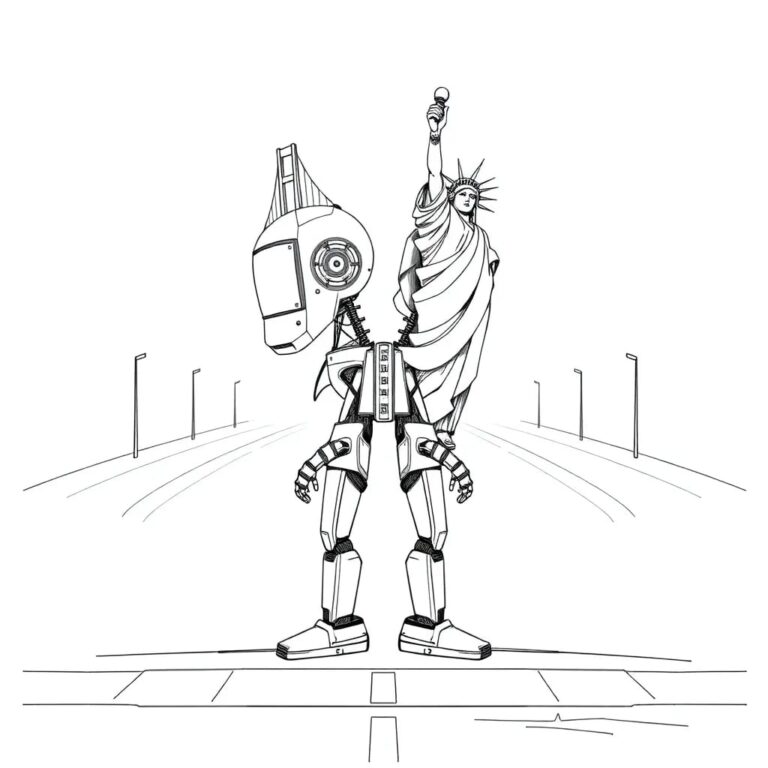

Convergenza Storica

La legge TFAIA della California è stata la prima legge statale a trattare i rischi potenzialmente catastrofici derivanti dall’IA. È notevole che il governatore di New York abbia scelto di adottare gran parte delle disposizioni californiane per creare un “benchmark unificato” tra gli stati.

Sviluppatori e Modelli di Grandi Dimensioni

Attualmente solo poche aziende e modelli possono soddisfare le soglie di fatturato e calcolo; queste soglie saranno soggette a valutazione annuale e potrebbero essere riviste in base agli sviluppi tecnologici e/o agli standard.

Future Incertezze

Alcune leggi statali sull’IA potrebbero essere contestate o precluse sotto l’EO 14365; non è chiaro se l’opzione di deferire a leggi o indicazioni federali possa alleviare alcuni o tutti questi rischi.

Leggi Recenti

Alla fine del 2025, California e New York hanno promulgato leggi per imporre protezioni per il dispiegamento sicuro di grandi modelli di IA di frontiera. Le leggi mirano a mitigare i rischi catastrofici richiedendo agli sviluppatori di pubblicare informazioni sui loro protocolli di sicurezza, comprese le valutazioni dei rischi, e di segnalare incidenti di sicurezza critici allo stato.

La legge della California, il Transparency in Frontier Artificial Intelligence Act (TFAIA), è stata firmata il 29 settembre 2025 ed è entrata in vigore il 1 gennaio 2026. La legge di New York, il Responsible AI Safety and Education Act (RAISE Act), è stata firmata il 16 dicembre 2025 e entrerà in vigore il 1 gennaio 2027. Questo avviso normativo si concentra sulle somiglianze e le differenze chiave tra le due leggi.

Punti Chiave

Un punto particolarmente notevole è l’Ordine Esecutivo 14365, “Assicurare un Quadro Normativo Nazionale per l’Intelligenza Artificiale”, emesso dalla Casa Bianca l’11 dicembre 2025. L’EO stabilisce direttive per creare un quadro normativo federale per le leggi e i regolamenti sull’IA, limitando la frammentazione normativa e le leggi e regolamenti “onerosi ed eccessivi” sull’IA negli stati che potrebbero ostacolare l’innovazione.

La versione finale del RAISE Act concordata dal governatore di New York differisce sostanzialmente dalla versione approvata dalla legislatura di New York. Prima della firma, il governatore ha l’opzione di negoziare con i leader legislativi per apportare modifiche, definite “emendamenti di capitolo”. In questo caso, le modifiche negoziate mirano ad allinearsi a molte delle disposizioni del TFAIA della California.

Principali Disposizioni e Confronto tra Leggi CA e NY

- Requisito Principale: ● (CA), ● (NY)

- Modelli: ● (CA), ● (NY)

- Sviluppatori: ● (CA), ● (NY)

- Rischio: ● (CA), ● (NY)

- Agenti Statali Principali: ● (CA), × (NY)

- Definizione di Incidente: ● (CA), ● (NY)

- Reporting degli Incidenti: ● (CA), × (NY)

- Divulgazione Pubblica: ● (CA), ● (NY)

- Penalità Principali: ● (CA), × (NY)

- Protezione dei Whistleblower: ● (CA), × (NY)

- Ambito di Applicazione: ● (CA), ● (NY)

- Clausola di Separabilità: ● (CA), ● (NY)

- Divieto di Dichiarazioni False: ● (CA), ● (NY)

Le leggi sulla sicurezza dell’IA in California e New York rappresentano un importante passo verso la regolamentazione dell’IA, affrontando i rischi significativi associati a questi avanzati modelli tecnologici.