Perché la governance dell’intelligenza artificiale è diventata inevitabile

L’intelligenza artificiale è passata dai margini dell’innovazione al centro della società moderna. I sistemi alimentati da algoritmi ora influenzano come le persone lavorano, apprendono, comunicano e prendono decisioni.

Questa rapida espansione ha costretto i governi e le istituzioni a confrontarsi con una realtà difficile: il progresso tecnologico ha superato le normative esistenti.

Per anni, i responsabili politici si sono affidati a linee guida volontarie e all’auto-regolamentazione del settore. Tuttavia, man mano che i sistemi di intelligenza artificiale diventavano più potenti e autonomi, sono aumentate le preoccupazioni. Questioni come l’uso improprio dei dati, il bias algoritmico, la disinformazione e la mancanza di responsabilità non possono più essere trattate come rischi teorici.

Il cambiamento di mentalità nella regolamentazione

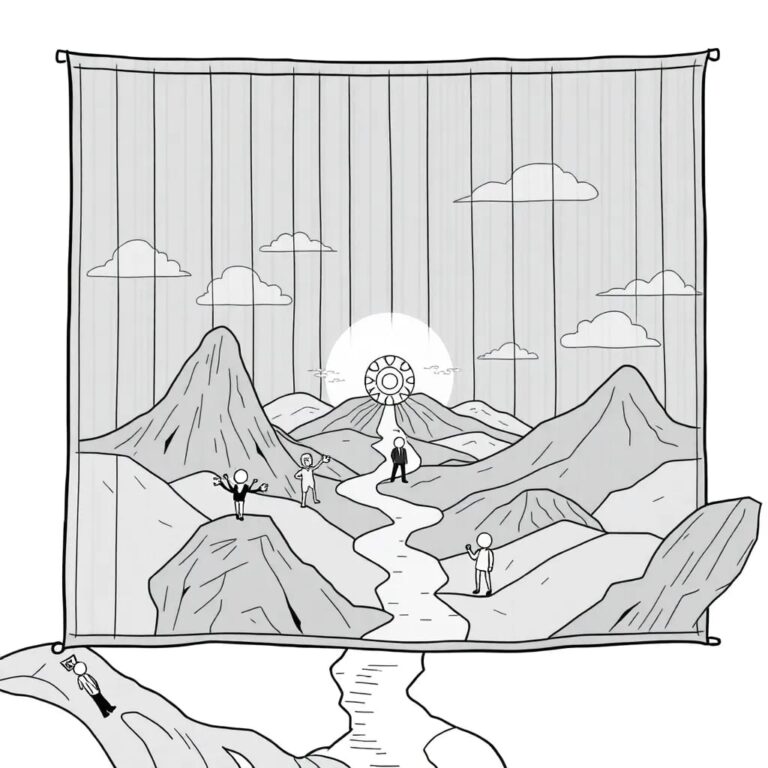

La fase decisiva della regolamentazione riflette un cambio di mentalità. L’intelligenza artificiale non è più vista solo come uno strumento di produttività, ma come una forza in grado di rimodellare i processi democratici, i mercati del lavoro e le norme sociali. Senza regole chiare, il potenziale di danno si espande insieme all’innovazione.

La consapevolezza pubblica è aumentata. Casi di alto profilo che coinvolgono deepfake, sorveglianza automatizzata e sistemi decisionali opachi hanno suscitato un ampio dibattito. I cittadini pongono domande fondamentali su controllo, equità e trasparenza. Queste pressioni hanno spinto i governi a passare dalla discussione all’azione.

La regolamentazione emerge quindi non come un ostacolo all’innovazione, ma come un tentativo di definirne i confini.

I rischi principali che guidano la spinta per una supervisione più forte

Alcuni rischi si trovano al centro del dibattito normativo. Uno dei più prominenti è la diffusione dei media sintetici. L’intelligenza artificiale può generare immagini, audio e video altamente realistici, difficili da distinguere dalla realtà, sollevando preoccupazioni riguardo all’interferenza nelle elezioni, frodi e danni reputazionali.

Il bias e la discriminazione rappresentano un’altra questione critica. I sistemi di intelligenza artificiale apprendono dai dati, che spesso riflettono disuguaglianze esistenti. Quando questi sistemi vengono impiegati in aree come le assunzioni, il credito o l’applicazione della legge, i risultati distorti possono rafforzare svantaggi strutturali.

I rischi per la privacy sono anch’essi sotto pressione. L’intelligenza artificiale dipende pesantemente da grandi quantità di dati, molti dei quali contengono informazioni personali. La raccolta, la memorizzazione e l’elaborazione di questi dati sollevano interrogativi riguardo al consenso e alla sorveglianza.

I rischi di sicurezza vanno oltre il danno individuale. L’intelligenza artificiale può essere utilizzata per attacchi informatici automatizzati, campagne di disinformazione o sistemi autonomi, elevando l’intelligenza artificiale a una questione di sicurezza nazionale e internazionale.

Infine, la trasparenza rimane una sfida persistente. Molti sistemi avanzati operano come scatole nere, producendo risultati senza spiegazioni chiare. Questa opacità mina la fiducia e complica la responsabilità.

Bilanciare innovazione e protezione pubblica

Uno degli aspetti più complessi della regolamentazione dell’intelligenza artificiale è trovare il giusto equilibrio. Regole eccessivamente restrittive potrebbero rallentare l’innovazione, scoraggiare gli investimenti e spingere lo sviluppo in ambienti meno regolamentati. Tuttavia, una supervisione insufficiente rischia di erodere la fiducia pubblica e amplificare i danni.

I responsabili politici stanno esplorando approcci basati sul rischio. Invece di regolare tutti i sistemi di intelligenza artificiale allo stesso modo, mirano a concentrarsi sulle applicazioni con il maggiore impatto. I sistemi utilizzati nelle infrastrutture critiche e nei servizi pubblici affrontano un controllo più rigoroso rispetto a quelli impiegati in contesti a basso rischio.

Le voci del settore giocano un ruolo importante in questa discussione. Le aziende tecnologiche sostengono che la flessibilità è essenziale in un campo in rapida evoluzione. Allo stesso tempo, molte aziende riconoscono che regole chiare possono fornire certezza e supportare una crescita a lungo termine.

Le piccole e medie imprese presentano un’altra considerazione. La conformità normativa può essere dispendiosa in termini di risorse. Se le regole sono troppo complesse, potrebbero favorire le grandi corporazioni, limitando la concorrenza e la diversità nel settore.

La coordinazione internazionale aggiunge ulteriore complessità. Lo sviluppo dell’intelligenza artificiale è globale, ma la regolamentazione rimane principalmente nazionale o regionale. Regole divergenti possono creare frammentazione, complicando l’implementazione e la cooperazione transfrontaliera.

Implicazioni per l’economia e il lavoro

La regolamentazione influenzerà non solo come viene costruita l’intelligenza artificiale, ma anche come viene adottata nelle economie. Regole chiare possono accelerare l’adozione riducendo l’incertezza e costruendo fiducia. Le organizzazioni sono più propense a investire in sistemi che rispettano standard definiti.

Allo stesso tempo, i requisiti di conformità potrebbero aumentare i costi, rallentando l’implementazione in determinati settori o regioni, in particolare dove i margini sono ristretti. I responsabili politici devono considerare come la regolamentazione interagisce con la competitività e la resilienza economica.

I mercati del lavoro sono al centro di questa trasformazione. L’intelligenza artificiale promette guadagni in efficienza, ma minaccia anche di sconvolgere i modelli occupazionali tradizionali. La regolamentazione da sola non può prevenire il dislocamento lavorativo, ma può plasmare come vengono gestite le transizioni. Requisiti di trasparenza e supervisione umana possono preservare ruoli nei processi decisionali critici.

Le politiche di istruzione e riqualificazione si intrecciano sempre più con la governance dell’intelligenza artificiale. Man mano che i sistemi automatizzano compiti di routine, cresce la domanda di competenze relative alla supervisione, all’etica e alla progettazione dei sistemi. La chiarezza normativa può guidare gli investimenti nella formazione e nell’adattamento della forza lavoro.

La disuguaglianza economica rappresenta una preoccupazione a lungo termine. Se l’accesso agli strumenti avanzati di intelligenza artificiale è concentrato tra pochi attori, le disparità potrebbero ampliarsi. La regolamentazione può incoraggiare uno sviluppo più inclusivo supportando standard aperti, concorrenza e innovazione responsabile.

Conclusione

La fase attuale di regolamentazione segna un punto di svolta. L’intelligenza artificiale sta passando da una tecnologia sperimentale a un’infrastruttura fondamentale della vita moderna. Con questa transizione arriva un riconoscimento della responsabilità.

La regolamentazione non risolverà tutte le sfide. Nuovi rischi emergeranno man mano che i sistemi diventeranno più capaci e autonomi. I quadri di governance devono rimanere flessibili e reattivi, capaci di adattarsi a sviluppi imprevisti.

La fiducia pubblica sarà un fattore decisivo. Regole trasparenti, responsabilità significativa e enforcement visibile possono rassicurare i cittadini sul fatto che l’intelligenza artificiale serve gli interessi umani. Senza fiducia, l’adozione potrebbe incontrare resistenza, indipendentemente dalla capacità tecnica.

La competizione globale plasmerà anche i risultati. I paesi che combinano innovazione con governance credibile potrebbero guadagnare un vantaggio strategico. Quelli che rimangono indietro rischiano di soffocare il progresso o di perdere il controllo su tecnologie potenti.

In ultima analisi, la regolamentazione dell’intelligenza artificiale riguarda la definizione dei confini. Mira a garantire che il progresso tecnologico sia allineato con i valori sociali piuttosto che minacciarli. La fase decisiva riflette un riconoscimento collettivo che il futuro dell’intelligenza artificiale non può essere lasciato al caso.