IBM Sottolinea la Differenza tra Linguaggio Etico e Competenza Morale nell’IA

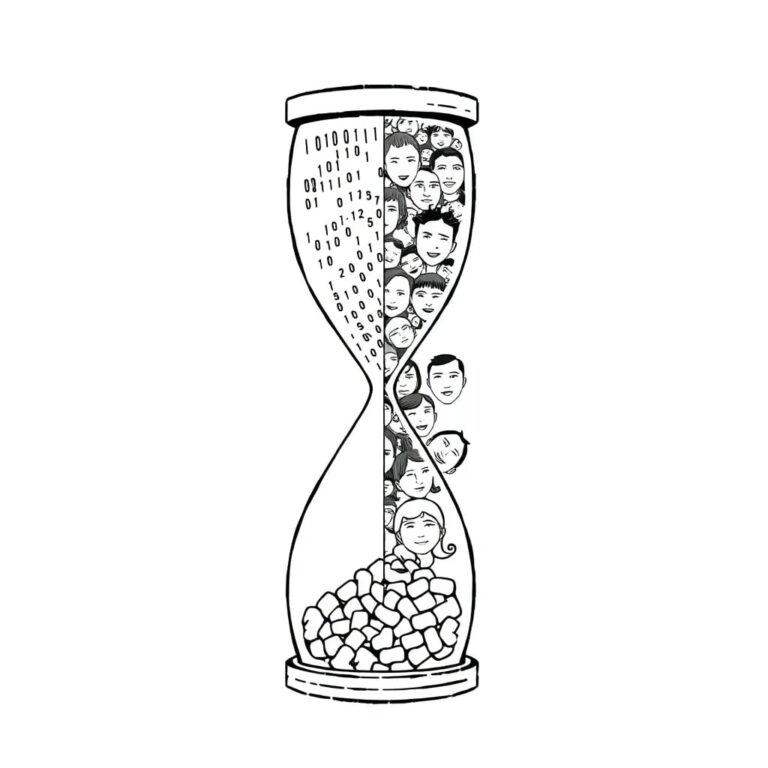

IBM mette in evidenza una distinzione fondamentale tra l’intelligenza artificiale che sembra etica e quella che dimostra un vero ragionamento morale, una differenza con implicazioni significative per le applicazioni sempre più complesse della tecnologia. Recenti studi suggeriscono che i modelli di linguaggio di grandi dimensioni possono imitare in modo convincente il linguaggio etico senza possedere effettivamente competenze morali; questi sistemi eccellono nell’identificare schemi statistici nel testo, piuttosto che impegnarsi in un giudizio etico ragionato.

Analisi dei Modelli di Linguaggio

Un’analisi di oltre 300.000 conversazioni con un chatbot ha identificato valori distintivi espressi e ha mostrato che il modello rispecchiava in gran parte i valori degli utenti, sollevando preoccupazioni sull’uso di una funzione di completamento costosa in decisioni ad alto rischio. Questi modelli generano regolarmente testi che sembrano affrontare dilemmi etici complessi, ma la ricerca emergente indica che questa capacità deriva dalla previsione statistica piuttosto che da un vero ragionamento morale.

Verso una Nuova Misurazione della Competenza Morale

Due studi recenti evidenziano la distinzione tra sembrare etici e essere realmente etici, spingendo a richiedere nuovi metriche di valutazione focalizzate sulla “competenza morale”. La questione centrale di questo fenomeno risiede nel modo in cui questi modelli sono costruiti; prevedono la parola successiva più probabile in base a schemi appresi da enormi dataset di testo e codice. Questo processo, sebbene efficace nel mimare il discorso etico umano, non comporta la comprensione dei principi sottostanti.

Implicazioni per la Decisione Morale

Il comportamento di questi modelli riflette la diversità dei punti di vista presenti nei dati di addestramento, sollevando domande critiche sulla delega delle decisioni morali a sistemi basati su sottoinsiemi di dati determinati statisticamente. La crescente sofisticazione dei modelli di linguaggio di grandi dimensioni presenta una sfida critica; mentre sono in grado di generare testi allineati eticamente, questi sistemi potrebbero mancare di vere capacità di ragionamento morale, sollevando preoccupazioni sul loro impiego nei processi decisionali cruciali.

Conclusione

Le indagini recenti rivelano una distinzione tra sembrare etici e essere etici, una sfumatura con profonde implicazioni per lo sviluppo responsabile dell’IA. Tuttavia, questo allineamento non indica necessariamente una deliberazione morale interna; piuttosto riflette schemi statistici appresi dai vasti dataset utilizzati per l’addestramento. Affrontare questa limitazione richiede un cambio verso sistemi costruiti su quadri etici formali, non solo su modelli di linguaggio predittivi.