AI nella Compliance: Perché la Sostituzione Non è l’Obiettivo Giusto

Tra i pannelli fintech e le discussioni in consiglio, una promessa continua a ripetersi: l’intelligenza artificiale sostituirà i team di compliance. Suona efficiente e inevitabile, ma è anche pericolosamente incompleta.

Non c’è dubbio che l’AI stia trasformando la rilevazione delle frodi, il contrasto al riciclaggio di denaro e il monitoraggio dei rischi. Le perdite globali per frodi ammontano a centinaia di miliardi di dollari annualmente e le istituzioni sono sotto pressione per rilevare crimini finanziari sempre più sofisticati e in tempo reale. Non sorprende che più della metà delle istituzioni finanziarie stia investendo attivamente in capacità di compliance e frode guidate dall’AI.

Il Vero Problema Non Era Mai il Giudizio Umano

Per decenni, i team di compliance hanno operato sotto una notevole pressione operativa. I sistemi tradizionali basati su regole generano spesso tassi di falsi positivi che raggiungono il 30-40% in alcune istituzioni. Gli investigatori trascorrono molto tempo a rivedere avvisi che, alla fine, non pongono alcun reale rischio.

Il problema non era mai la mancanza di capacità da parte dei professionisti della compliance, ma il fatto che i sistemi generavano troppo rumore. L’AI promette di ridurre quel rumore. Può:

- Identificare schemi complessi attraverso milioni di transazioni

- Rilevare anomalie comportamentali oltre le soglie statiche

- Prioritizzare i casi ad alto rischio in modo intelligente

- Apprendere dalle decisioni investigative passate

In altre parole, l’AI può migliorare notevolmente l’efficienza. Ma l’efficienza non è la stessa cosa della eliminazione.

L’Illusione dell’Automazione Completa

L’idea che l’AI possa gestire autonomamente la compliance ignora una verità fondamentale: la compliance non è solo rilevamento di modelli. È giudizio, responsabilità, documentazione e interpretazione normativa.

Un algoritmo può segnalare un comportamento insolito, ma un umano deve determinare l’intento, la materialità e l’obbligo di reporting. Inoltre, i regolatori non ritengono responsabili gli algoritmi. Ritengono responsabili le istituzioni, che alla fine si affidano alle persone.

C’è anche una dimensione di governance che viene spesso trascurata nell’entusiasmo per l’AI. I regolatori finanziari si aspettano sempre più spiegabilità, auditabilità e tracciabilità nei sistemi di decisione automatizzati.

L’AI Non Sostituisce l’Expertise — Ne Dipende

Forse l’aspetto più frainteso dell’AI nella compliance è la sua dipendenza dai dati. I modelli di AI non operano in isolamento. Richiedono:

- Set di dati storici strutturati

- Architettura dati pulita e coerente

- Esiti etichettati da indagini passate

- Feedback umano continuo

Una parte significativa dello sforzo del programma di AI viene spesa non nella costruzione del modello, ma nella preparazione, strutturazione e etichettatura dei dati.

Chi etichetta il comportamento sospetto come frode confermata? Chi classifica i falsi positivi? Chi determina se una transazione ha attivato l’obbligo di reporting normativo? Gli umani lo fanno.

L’AI nella compliance è addestrata sul giudizio umano, affina le decisioni umane e scala il riconoscimento dei modelli umani. Ma non origina la responsabilità istituzionale.

Il Rischio dell’Oversaturazione

C’è un altro rischio che merita attenzione: la fatica della compliance può essere sostituita da un’eccessiva fiducia. Se le istituzioni assumono che l’AI possa gestire il rischio autonomamente, possono emergere due conseguenze indesiderate:

- Riduzione della supervisione umana

- Affidamento eccessivo sui risultati dei modelli

Né una cosa né l’altra sono prudenti in ambienti regolamentati. La criminalità finanziaria evolve precisamente perché si adatta ai sistemi. I trasgressori testano le soglie di rilevamento e sfruttano le lacune operative.

Se lasciati senza supervisione, anche modelli sofisticati possono diventare fragili.

Da Automazione ad Aumento

La vera trasformazione non risiede nella sostituzione dei professionisti, ma nella riprogettazione di come viene applicata l’intelligenza nei sistemi di compliance.

L’AI dovrebbe:

- Ridurre i falsi positivi

- Prioritizzare i casi in modo intelligente

- Rivelare approfondimenti a livello di rete

- Rilevare il drift comportamentale in tempo reale

- Automatizzare la documentazione ripetitiva

Tuttavia, l’autorità decisionale, l’interpretazione normativa e la responsabilità devono rimanere umane. Questa non è una posizione conservativa. È una posizione strategica.

La Governance è il Vero Differenziatore

Con l’adozione dell’AI che accelera, il vantaggio competitivo non deriverà solo dal possedere il modello più complesso. Deriverà dall’avere la governance più disciplinata attorno ad esso.

Le istituzioni che investono in set di dati strutturati ed etichettati, mantengono processi di validazione dei modelli trasparenti, integrano feedback degli investigatori e danno priorità alla spiegabilità accanto all’accuratezza non solo ridurranno le perdite per frodi, ma rafforzeranno la fiducia istituzionale.

La compliance non è un centro di costo da automatizzare. È una funzione di fiducia da rafforzare intelligentemente.

La Trasformazione Strategica

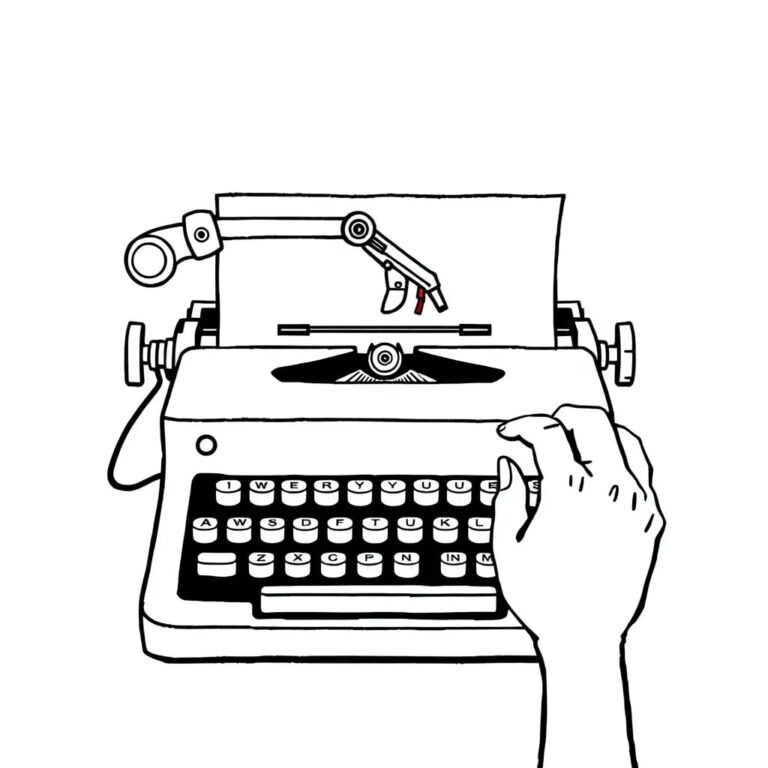

La conversazione sull’AI nella compliance deve maturare. La scelta non è tra umani o macchine, ma su come progettare sistemi in cui ciascuno faccia ciò che fa meglio.

L’AI eccelle nella scala, nella velocità e nel riconoscimento dei modelli comportamentali. Gli umani eccellono nel contesto, nell’interpretazione e nella responsabilità.

Confondere l’uno con l’altro è rischioso. Il futuro della compliance non sarà definito dalla riduzione del personale, ma dalla progettazione intelligente dei sistemi — come le istituzioni strutturano i dati, integrano la governance e costruiscono loop di feedback che consentono ai sistemi di evolversi senza compromettere la responsabilità.

Le istituzioni che trattano l’AI come un sostituto possono guadagnare velocità. Le istituzioni che la trattano come un partner guadagneranno resilienza. Il futuro della compliance non appartiene ai sistemi più veloci, ma a quelli che apprendono — responsabilmente.