La Legge Quadro sull’IA della Corea Entra in Vigore: Impatto sull’Industria dei Giochi

Il 26 gennaio 2026 è entrata in vigore la Legge Quadro sullo Sviluppo dell’Intelligenza Artificiale e sull’Istituzione della Fiducia (d’ora in poi, la Legge Quadro sull’IA). Questa legge promuove sia l’industria dell’IA sia la sicurezza, e si prevede che porterà cambiamenti concreti e diretti nel settore dei giochi, dove l’adozione dell’IA è tra le più attive di qualsiasi settore.

Obbligo di Etichettatura per l’IA Generativa

Il cambiamento principale che le aziende di giochi devono affrontare riguarda l’Articolo 36, che stabilisce l’obbligo di etichettare chiaramente i contenuti generati dall’IA. In base a questa disposizione, testi, immagini, video, audio e altri contenuti prodotti utilizzando l’IA devono essere contrassegnati in modo tale da permettere agli utenti di identificarli facilmente.

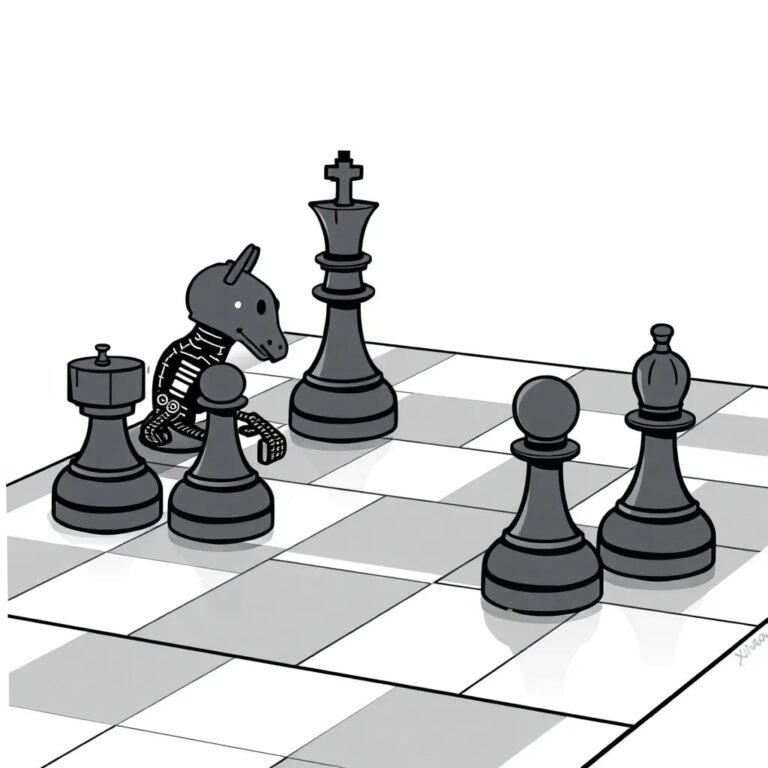

Nel contesto dello sviluppo dei giochi, è probabile che l’IA venga utilizzata per generare dialoghi di NPC in tempo reale o per creare illustrazioni di personaggi e musiche di sottofondo. Ora, con la legge in vigore, ogni contenuto generato dall’IA all’interno di un gioco deve essere accompagnato da un marchio o un’altra notifica che indichi che si tratta di un’opera “generata dall’IA”.

Applicazione della Legge a Piattaforme Globali

La legge si applica non solo alle aziende di giochi coreane, ma anche a quelle estere. L’Articolo 4 chiarisce che le attività svolte al di fuori della Repubblica di Corea possono rientrare sotto la legge se influenzano il mercato o gli utenti coreani.

Inoltre, l’Articolo 39 richiede a determinati operatori esteri di designare un rappresentante locale in Corea. Di conseguenza, piattaforme globali e aziende di giochi straniere dovranno mantenere un rappresentante nel paese e conformarsi ai requisiti coreani, come l’obbligo di etichettare il contenuto generato dall’IA, per continuare a fornire servizi in Corea.

Autonomia nello Sviluppo: il Principio “Permesso Prima, Regolamentazione Dopo”

La legge non è puramente restrittiva. L’Articolo 6 enuncia il principio “permesso prima, regolamentazione dopo”, stabilendo che, salvo restrizioni previste da altre leggi, chiunque può ricercare, sviluppare e rilasciare tecnologie IA senza limitazioni.

In precedenza, la mancanza di criteri chiari per la classificazione dei giochi con IA aveva portato gli sviluppatori a un approccio più cauto. Con questa base legale ora in vigore, si prevede un’accelerazione nell’adozione sperimentale dell’IA.

Preoccupazioni delle Piccole e Medie Imprese

Le piccole e medie aziende di giochi e startup con risorse limitate sono preoccupate per i costi di conformità normativa. Se la tecnologia IA è classificata come “ad alto rischio”, le aziende potrebbero dover implementare misure di affidabilità e adempiere a obblighi di reporting.

In risposta, il governo ha dichiarato che inizialmente l’applicazione della legge si concentrerà più sulla guida che sulla punizione, incoraggiando un’implementazione pratica. Il ministero competente fornirà supporto e consulenza affinché le aziende si conformino adeguatamente a normative nuove e complesse.

Con l’entrata in vigore della Legge Quadro sull’IA, l’industria dei giochi si trova di fronte a un’opportunità di progresso tecnologico e a una maggiore responsabilità nel soddisfare aspettative sociali elevate. L’efficacia delle linee guida dettagliate che verranno pubblicate determinerà probabilmente il successo della normativa.