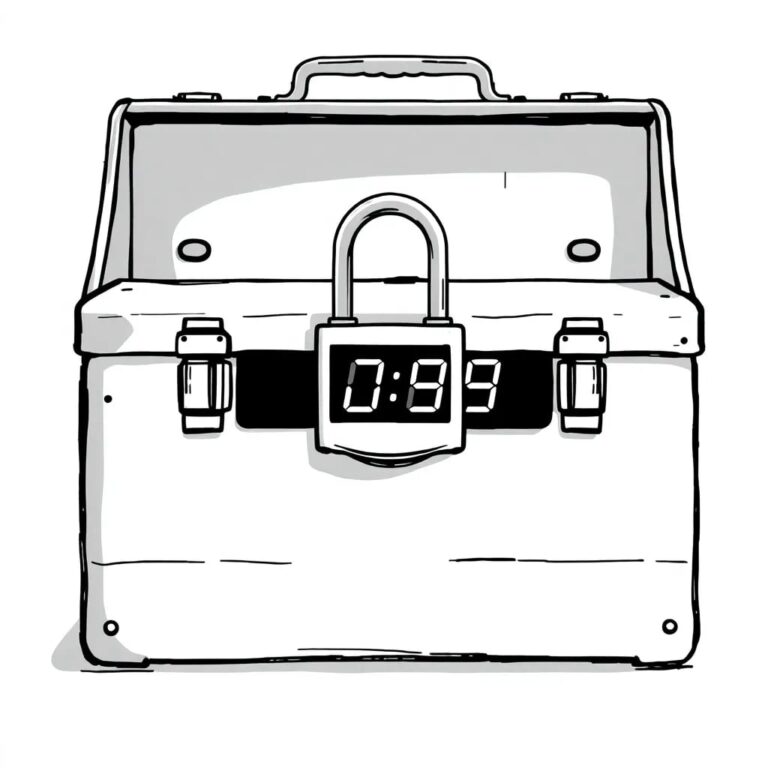

AI ha sigillato il cofano: presto nessuno sarà in grado di riparare il codice quando si rompe

Dall’arrivo del motore a combustione interna, le officine di riparazione auto potevano sistemare praticamente qualsiasi cosa per qualsiasi marca e modello con strumenti di base. Poi è arrivata la modernizzazione; i motori a iniezione di carburante hanno preso piede.

Allo stesso modo in cui i motori a iniezione di carburante hanno sostituito pistoni, candele e carburatori, assicurando che nessuno guardi più sotto il cofano della propria auto, il coding AI sta sostituendo la manutenibilità del codice, non la sua esistenza. Ora, nessuno sta esaminando le proprie applicazioni web.

Il rischio di codice errato che appare ovunque è un aspetto del problema. Ma il rischio più profondo è la perdita delle competenze fondamentali nella manutenzione e assistenza del codice. Non ci sono componenti sostituibili sul campo quando tutto è una macchina di Rube Goldberg di funzioni e librerie software che potrebbero funzionare quando vengono implementate, ma poi diventano ingestibili e non manutenibili.

Le app funzionano, ma sempre meno persone sanno davvero perché o come. Come esplorato da un autore, quando perdiamo la nostra relazione con la meccanica sottostante, perdiamo anche la nostra connessione con la qualità stessa. Questa perdita di manutenibilità non è solo scomoda; è una nuova forma di rischio.

Le evidenze non sono teoriche

Un rapporto del 2026 sulla sicurezza e lo sviluppo mostra che una persona su cinque ha già subito un incidente grave a causa di codice generato da AI. Quasi il 70% ha scoperto vulnerabilità introdotte da assistenti AI.

Quando l’AI introduce un difetto, nessuno sa chi possiede le conseguenze. Quando si chiede chi sarebbe responsabile per una violazione introdotta dall’AI, le risposte erano divise tra ingegneria, sicurezza e il fornitore, un chiaro segno che la governance non è riuscita a tenere il passo con l’automazione.

Gli ingegneri alle prime armi ora lavorano quasi esclusivamente a livello di astrazione. Spediscono codice più velocemente, ma con molta meno esposizione a sistemi, reti o modalità di errore. Ciò indebolisce il giudizio umano necessario per mettere in discussione l’output dell’AI prima che arrivi in produzione. È tutto successivo e sembra un po’ come se gli esseri umani fossero coinvolti solo per essere messi alla gogna.

Il codice generato dall’AI come amplificatore dei valori e della cultura della sicurezza

Il codice generato dall’AI è un amplificatore dei valori fondamentali di un’organizzazione e della sua cultura della sicurezza. Se l’organizzazione ha un buon DNA di sicurezza, gli strumenti AI miglioreranno quella cultura. Ma se un’organizzazione manca di disciplina e gestione dei rischi di base, lo sviluppo software autonomo rifletterà quella cultura della sicurezza immatura.

Quando l’algoritmo fallisce, chi viene incolpato?

Immagina una società che avvia un esperimento di trading agentico. Quando l’algoritmo fallisce, l’azienda perde denaro. Non ci sono molte colpe da addossare poiché si trattava di un esperimento utilizzando il proprio capitale. Ora alziamo le puntate.

Una compagnia sanitaria fornisce consigli tramite i clinici. Più di un’organizzazione sta cercando di sfruttare i modelli di linguaggio come NPC (personaggi non giocanti) che sussurrano ai professionisti medici durante le discussioni con i pazienti. Puoi essere certo che ci sarà un puntare il dito quando un paziente subisce un esito inaspettato in parte a causa di un algoritmo non deterministico. Chi è responsabile per lesioni o perdita di vita? L’azienda che ha scritto l’algoritmo? Il team di QA? Il professionista medico?

Il settore assicurativo non è pronto

Ho sentito solo risate nervose quando si parla di assicurazione per perdite causate da AI agentici.

Ma ha senso per le assicurazioni creare coperture per negligenza, violazione della proprietà intellettuale e responsabilità normative. L’assicurazione per la responsabilità dell’AI dovrà crescere man mano che si verificheranno incidenti. Il contrario sta anche accadendo, con grandi assicuratori che cercano esclusioni per l’AI dalle coperture esistenti date le imprevedibilità dei sistemi non deterministici.

La semplificazione del coding

Ma torniamo alla radice di questo problema. Gli sviluppatori junior non stanno venendo sostituiti tanto quanto il loro lavoro sta cambiando. Gli analisti SOC entry-level vigilano sugli algoritmi decidendo se gli eventi di log sono malevoli. Gli stagisti di marketing producono presentazioni senza grafici.

Il termine “slop” viene applicato agli output dell’AI con un intento decisamente spregiativo. Per il mondo dell’arte, questo deve sembrare un affronto. L’arte e il design esistono in un dialogo costante con il passato, reagendo a movimenti precedenti con gusto coltivato. Ora le visualizzazioni sono ridotte a estetiche banali prodotte senza sforzo e prive di rispetto.

Stiamo vivendo l’equivalente nello sviluppo software della stessa semplificazione. Qualcuno ha scritto che possiamo essere aumentati dall’AI o abdicarvi. Ma abdicar suggerisce di scendere da un trono di responsabilità. Molti utenti di coding AI non hanno mai raggiunto quella posizione in primo luogo.

La sprawl degli strumenti aggrava tutto

La ricerca mostra che i team che hanno subito incidenti di sicurezza gestivano più strumenti di fornitori rispetto a quelli che non lo facevano. Eppure il ciclo continua a ripetersi; nuovi problemi di sicurezza vengono inventati per essere risolti. Alcuni strumenti sono il problema del tuo problema. Alcuni rimedi sono peggiori della malattia. La sprawl degli strumenti è stata parte del DNA dell’industria della sicurezza storicamente dall’avvento del firewall.

Ci sono due tipi di professionisti della sicurezza: certificati e qualificati, con una sottile sezione di sovrapposizione nel diagramma di Venn. Preferisco il talento qualificato. Molti certificati non comprendono come funziona Internet.

Il divario tra politica e pratica

Un revisore SOC2 cerca il delta tra la politica scritta e la tecnica praticata. Se pubblichi una politica che memorizza i dati dei clienti su un bucket S3 leggibile da tutti e questo è ciò che fai, allora non ci sono problemi da parte dell’auditor. Perché? SOC2 non è una certificazione. È l’opinione di un contabile su se segui le tue politiche.

Ci si può trovare in acque pericolose riguardo alle proprie politiche e procedure in due modi: politiche perfette che non possono essere applicate o nessuna politica scritta. Molte aziende passeranno dalla seconda alla prima e non capiranno perché hanno tanti rilievi. Quindi fai attenzione a chiedere a un modello di linguaggio di scrivere le tue politiche, poiché potrebbero spesso essere “troppo buone” o avanzate rispetto alle tue tecniche e capacità di enforcement reali.

La carestia digitale

Ho previsto uno scenario in cui un attore malevolo non si preoccupa di fare un adeguato QA del proprio malware, bloccando tutti i dispositivi iOS sull’ultima versione del sistema operativo. Questo è l’elemento della monocultura poiché una percentuale significativa di utenti iOS è sempre sull’ultima versione del software. L’AI potrebbe scrivere malware che nemmeno il genius bar di Apple può ripristinare.

All’altro estremità dello spettro, Android ha così tante varianti e versioni OEM (oltre 15 versioni principali con varianti OEM) che ha una naturale immunità a un evento di carestia digitale. Tuttavia, Apple sarà felice di vendere dispositivi di ricambio a tutti nel mondo.

La governance dell’AI deve essere al centro della scena, ma questi controlli non funzioneranno se le competenze software e di sicurezza continuano a ridursi. L’AI amplifica buoni e cattivi schemi, diffondendo rapidamente logiche difettose. Il rischio di monocultura aumenta poiché i team si affidano alle stesse strutture generate dall’AI. Quando perdiamo la capacità di mantenere i nostri sistemi, perdiamo la qualità stessa.

Cosa dovrebbero chiedere i consigli di amministrazione

I consigli di amministrazione dovrebbero chiedere: “Puoi mostrarmi esattamente dove il codice generato dall’AI sta operando in produzione adesso e chi è responsabile per il suo comportamento?”

I CISO devono rispondere: “Possiamo identificare ogni istanza di codice generato dall’AI, tracciare chi lo ha approvato, dimostrare come è stato revisionato e spiegare quali guardrail hanno impedito che toccasse sistemi ad alto rischio.”

Se non puoi rispondere a quella domanda, non hai governance. Hai una fiction ben scritta.