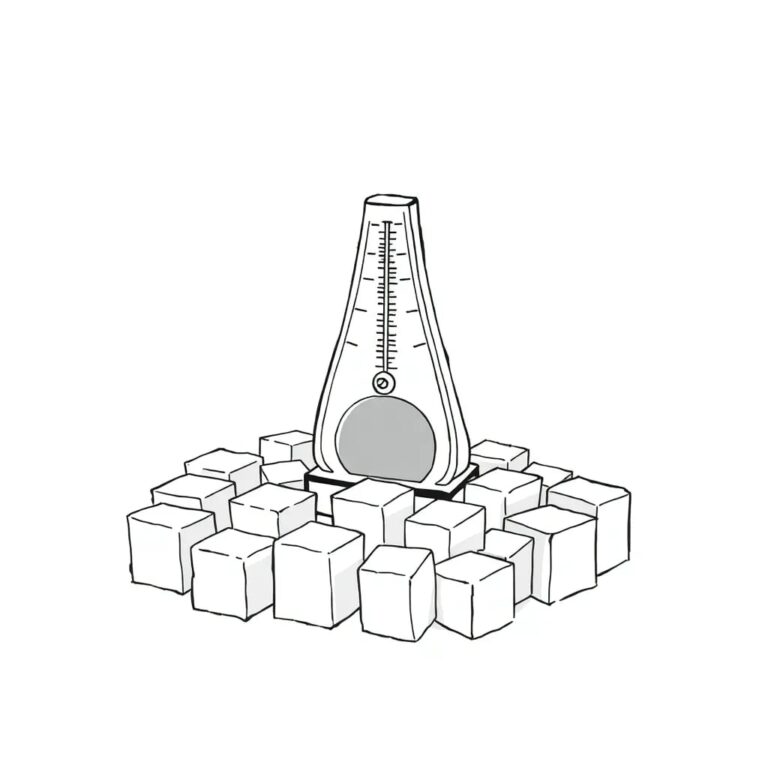

Il paradosso della precisione: perché l’IA nella finanza regolamentata è un cammino in equilibrio ad alto rischio

Quando vedo l’entusiasmo attorno all’ultima ondata di strumenti di IA, provo simultaneamente ammirazione genuina per ciò che la tecnologia può fare e un freddo e silenzioso timore riguardo a dove viene impiegata.

Strumenti come Clawbot e i loro contemporanei sono arrivati con un’enorme fanfara. Per un fondatore affamato di crescita, sembrano il shortcut definitivo: implementa rapidamente, scala più velocemente, preoccupati dei dettagli dopo.

Tuttavia, qui c’è la verità scomoda che nessuno nella sala dimostrativa vuole dire ad alta voce: in un settore regolamentato, il “cool” è una responsabilità.

La letalità dell’ “quasi giusto”

In un settore creativo, un’allucinazione dell’IA è un’inconveniente. Un piccolo imbarazzo per una citazione attribuita erroneamente. Nei servizi di mutuo e finanziari, un’allucinazione è una catastrofe in attesa di una data sul calendario.

Pensa attentamente a cosa significa un errore dell’1% in un calcolo di sostenibilità. Significa una famiglia approvata per un mutuo che non può mantenere sostenibilmente. Significa un broker la cui raccomandazione costituisce una vendita errata secondo le normative. A livello umano, significa un futuro finanziario compromesso perché una macchina ha detto “sì” quando avrebbe dovuto dire “aspetta”.

La definizione di “danno prevedibile” secondo il dovere di protezione del consumatore non è ambigua. Se la tua tecnologia è nota per produrre risultati probabilistici e la distribuisci dove la precisione è obbligatoria, non sei stato sfortunato. Sei stato negligente.

Guardrail contro gadget

Il mercato ha risposto alla domanda di servizi finanziari “abilitati all’IA” con una serie di prodotti che sono, in sostanza, involucri generici di modelli di linguaggio ampio (LLM) vestiti da branding fintech. Sono impressionanti in condizioni controllate e pericolosi in produzione.

Ecco la distinzione che ogni leader fintech deve comprendere: per settori non regolamentati, i guardrail sono filtri aggiunti dopo la costruzione del prodotto principale. Per i servizi finanziari regolamentati, i guardrail non sono una caratteristica. Sono l’intera architettura.

L’IA di livello istituzionale deve essere costruita su un principio non negoziabile: il sistema non deve mai produrre un output che non può difendere, auditare e spiegare a un regolatore.

Il imperativo della trasparenza

Il settore dell’IA ha sviluppato un’abitudine sfortunata di trattare la spiegabilità come una funzione di lusso, qualcosa da aggiungere alla roadmap dopo aver raggiunto l’adattamento al mercato.

La distinzione tra un modello “a scatola nera” e un modello “a scatola di vetro” non è una questione di sofisticazione; è una questione di responsabilità. Un modello a scatola nera produce un output e dice essenzialmente: “fidati di me”. Un modello a scatola di vetro produce un output e dice: “Ecco precisamente perché, ecco ogni pezzo di prova che ho considerato, ecco il tracciato di audit che lo dimostra.”

I regolatori non vogliono sapere che la tua IA funziona la maggior parte delle volte. Vogliono sapere che quando fallisce, puoi identificare esattamente cosa è andato storto. L’IA a scatola di vetro significa che ogni decisione di conformità porta con sé un tracciato di audit completo e leggibile dall’uomo.

Il nuovo ruolo del CEO

Esiste una narrativa persistente nel settore tecnologico secondo cui la regolamentazione è il nemico dell’innovazione. Le aziende che vincono sono quelle che si muovono più velocemente e chiedono perdono dopo. Nei servizi finanziari, quella narrativa fa male.

Il ruolo del CEO fintech sta cambiando. Non sei più solo l’amministratore delegato; sei il chief risk officer della tua IA.

Ciò significa porre domande fondamentalmente diverse prima di implementare. Non “Quanto velocemente possiamo spedire questo?”, ma “Quanto a fondo abbiamo testato questo prima che tocchi un cliente reale?”. Non “Questo impressiona un investitore?”, ma “Questo resiste a una revisione regolamentare?”.

L’innovazione responsabile non è nemica della velocità. È l’unica base sulla quale è possibile una velocità duratura. Le scommesse non sono astratte, sono misurate in famiglie colpite, in consulenti i cui mezzi di sussistenza sono a rischio, e in aziende la cui reputazione non può essere ricostruita.

Il cammino in equilibrio è reale. L’unica domanda è se intendi attraversarlo con gli occhi aperti.