EU AI Act: Guida pratica per il settore delle scienze della vita

Grazie ai progressi tecnologici, l’intelligenza artificiale (AI) ha il potenziale di trasformare vari segmenti dell’industria delle scienze della vita. In futuro sarà possibile analizzare grandi volumi di dati biomedici, riconoscere schemi complessi e fare previsioni precise. Questo rappresenta una leva importante di valore che apre nuove opportunità di crescita.

Il Regolamento sull’AI dell’Unione Europea (EU AI Act) rappresenta un quadro giuridico innovativo per l’uso sicuro ed etico dell’AI e sarà vincolante per le aziende. Ma cosa significa esattamente per il settore delle scienze della vita? Un documento tecnico fornisce un’analisi dettagliata delle esigenze e delle implicazioni che le aziende devono monitorare per prepararsi alla conformità e illustra come può essere progettato un approccio proattivo alla minimizzazione del rischio.

Panoramica del Regolamento sull’AI dell’UE

Il Regolamento sull’AI dell’UE categorizza i sistemi AI in base al livello di rischio e impone obblighi a sviluppatori e utenti. Per i sistemi AI ad alto rischio, come quelli utilizzati nella diagnosi medica e nelle raccomandazioni di trattamento, i sviluppatori devono effettuare una valutazione di conformità prima della loro implementazione. Sebbene sia prevista l’autovalutazione, questa sarà praticabile in futuro solo in assenza di standard armonizzati.

Il Regolamento si applica anche ai sistemi AI sviluppati al di fuori dell’UE ma commercializzati o utilizzati nell’UE, il che significa che gli sviluppatori devono rispettare il Regolamento indipendentemente dalla loro posizione. Inoltre, si interpreta che si applichi alle aziende delle scienze della vita di paesi terzi che utilizzano l’AI per sviluppare prodotti destinati al mercato europeo.

Il Regolamento è previsto in vigore a partire da giugno 2024, con periodi di transizione graduati da sei a trentasei mesi per diverse categorie di sistemi AI. I manager responsabili della conformità, della governance dei dati e dello sviluppo e utilizzo delle tecnologie AI devono prepararsi a nuove responsabilità.

Effetti e requisiti del Regolamento sull’AI nel settore delle scienze della vita

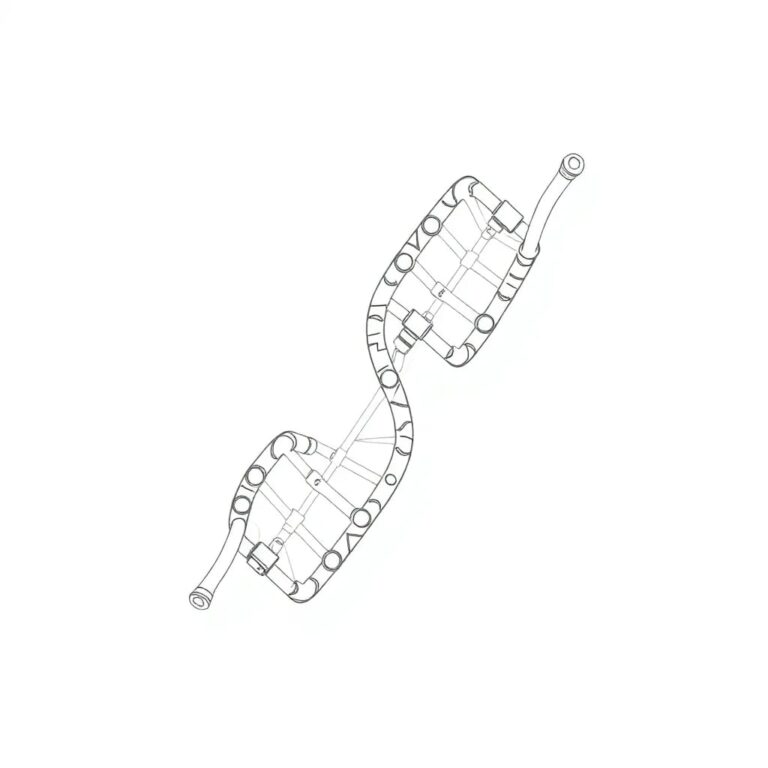

Il Regolamento ha conseguenze significative per vari ambiti del settore delle scienze della vita, inclusi i diagnostici di accompagnamento e le prove cliniche. Avrà un impatto rilevante anche sull’industria dei dispositivi medici, in particolare sulla fabbricazione di prodotti classificati come “ad alto rischio”. I requisiti si concentrano sulla gestione del rischio, sulla governance dei dati e sul monitoraggio della conformità.

Per le aziende che producono prodotti supportati dall’AI, è consigliabile cercare consulenze esterne per gestire in modo olistico i compiti in vista della complessità della situazione.

Valutazione del livello di maturità delle aziende

Il documento tecnico analizza nove categorie che le aziende devono valutare in relazione ai requisiti futuri. Questi aspetti devono essere categorizzati su una scala da 1 (non preparato) a 5 (leader). Le categorie includono:

- Classificazione del rischio

- Valutazione di conformità

- Trasparenza

- Supervisione umana

- Equità, non discriminazione e pregiudizi

- Spiegabilità

- Governance dei dati

- Cyber sicurezza

- Conformità e enforcement

Il documento spiega anche come le aziende possono essere supportate in questo settore, dallo sviluppo della strategia al monitoraggio dei processi nella pratica.