I governi implementeranno agenti AI e rafforzeranno il controllo entro il 2029

La maggior parte dei governi utilizzerà agenti AI per decisioni di routine nei prossimi anni, poiché i leader del settore pubblico cercano una gestione più rapida delle transazioni e risultati più coerenti. Si prevede che almeno l’80% dei governi implementerà agenti AI per decisioni di routine entro il 2028, riflettendo un passaggio più ampio dall’esecuzione di progetti pilota all’uso operativo nei servizi pubblici.

Requisiti di supervisione

Si prevede che entro il 2029, il 70% delle agenzie governative richiederà AI spiegabile e meccanismi di intervento umano per decisioni automatizzate che influenzano la fornitura di servizi ai cittadini. L’obiettivo è una maggiore trasparenza, auditabilità e percorsi chiari per contestare decisioni che hanno conseguenze nel mondo reale.

Funzioni degli agenti AI

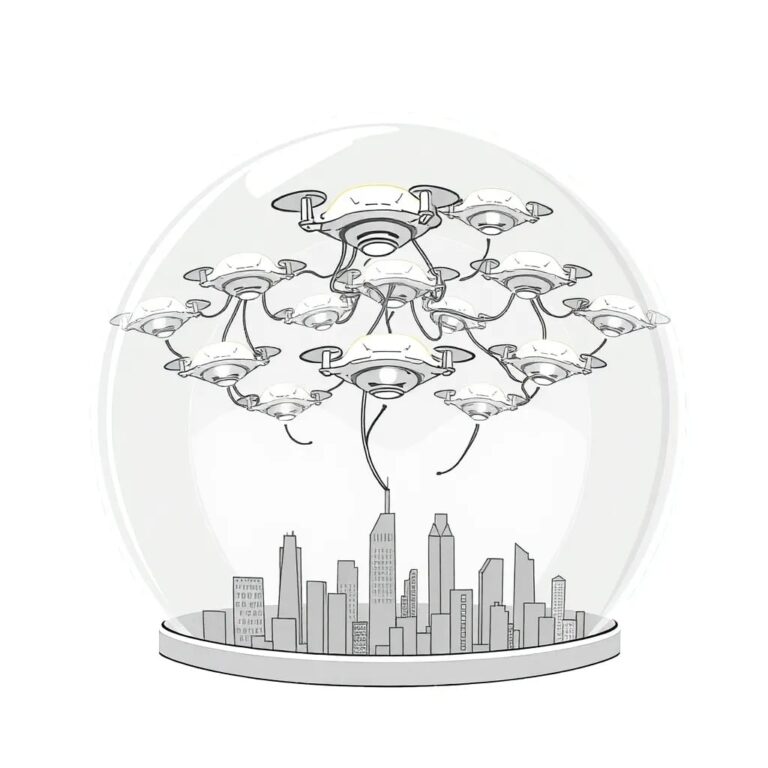

Gli agenti AI sono sistemi software che intraprendono azioni in base a obiettivi e regole, spesso tramite interfacce conversazionali. Nel governo, possono gestire compiti con logiche decisionali coerenti, come controlli di idoneità, triage, instradamento dei casi e programmazione degli appuntamenti. Possono anche attingere a diverse fonti di dati, inclusi testi e immagini, ampliando così il campo di applicazione dell’automazione.

Il collegamento tra la crescita degli agenti AI e i progressi nell’AI multimodale—che elabora diversi tipi di dati—insieme ai sistemi conversazionali, è fondamentale. La pressione sui leader tecnologici governativi per implementare rapidamente l’AI, rispettando nel contempo gli standard di responsabilità pubblica, è in aumento.

Problemi di frammentazione

Le barriere strutturali all’interno del governo rimangono un vincolo chiave sulla rapidità con cui l’AI può passare da progetti individuali a servizi condivisi. La frammentazione interna è stata identificata come uno degli ostacoli più persistenti nel fornire valore misurabile dall’AI nel settore pubblico. In un sondaggio condotto su 138 rispondenti governativi a livello mondiale, il 41% ha citato strategie isolate come una sfida chiave nell’adozione e implementazione di soluzioni digitali, mentre il 31% ha indicato i sistemi legacy come un problema maggiore.

Governance decisionale

La governance dell’AI nel settore pubblico sta cambiando, spostando l’attenzione dai modelli e algoritmi alle decisioni. Questo approccio, definito intelligenza decisionale, considera la decisione come un asset operativo da progettare e testare, con maggiore enfasi su percorsi decisionali chiari. Questo è cruciale soprattutto quando le decisioni automatizzate influenzano l’accesso ai servizi o la gestione di casi sensibili.

Il 39% dei rispondenti ha citato il miglioramento del servizio e della soddisfazione dei cittadini come motivi primari per investire nella costruzione della fiducia dei cittadini. Ciò collega la fiducia a risultati come tempestività, accuratezza e coerenza nella fornitura dei servizi.

Esperienza del cittadino

Seppur l’efficienza continui a sostenere molti casi aziendali di automazione, l’esperienza del cittadino sta diventando un parametro di valore sempre più forte. La metà dei rispondenti governativi ha classificato il miglioramento dell’esperienza del cittadino tra le proprie tre priorità principali. Con l’aumento dei servizi automatici e una diminuzione delle interazioni dirette, l’esperienza del cittadino dipende sempre più da equità, affidabilità e trasparenza.

Man mano che l’AI e l’intelligenza decisionale automatizzano e semplificano la fornitura dei servizi, il concetto tradizionale di “esperienza del cittadino” evolve. Quando i cittadini ricevono automaticamente ciò di cui hanno bisogno dal governo, le interazioni dirette possono diminuire, rendendo la fiducia nell’affidabilità, equità e trasparenza del sistema ancora più critica.

Conclusione

Le previsioni indicano che la prossima fase di implementazione dell’AI nel settore pubblico sarà definita meno da esperimenti e più da una governance che può resistere a controlli, con spiegabilità e revisione umana che diventano requisiti comuni man mano che gli agenti AI assumono una maggiore parte delle decisioni di routine.