AI nel 2026: i servizi finanziari accelerano, ma rischio e governance devono tenere il passoh2>

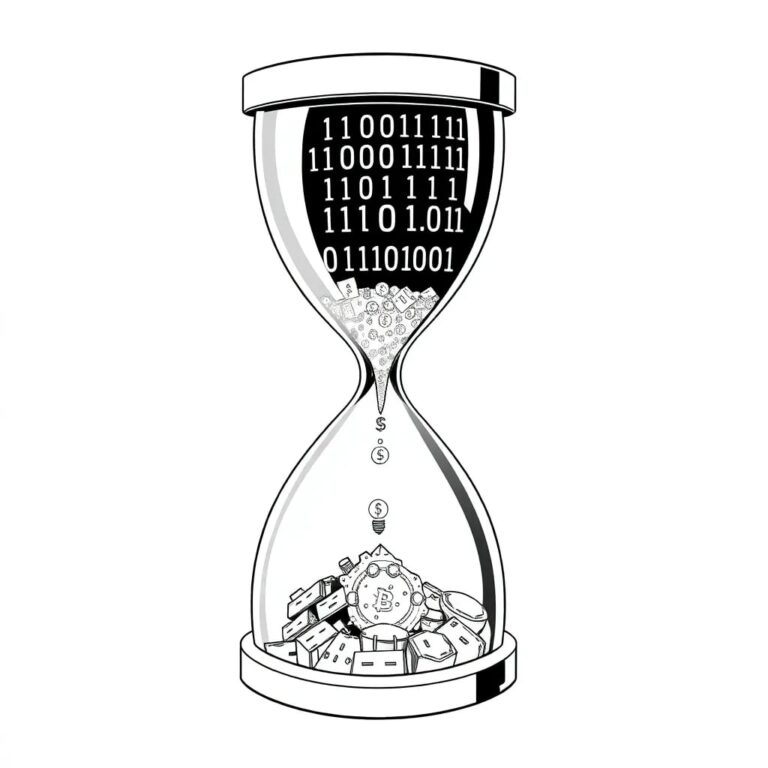

AI è ormai profondamente integrata nei servizi finanziari, ma la governance e il controllo non si sono adattati, creando crescenti rischi operativi, normativi e di fiducia per le aziende e i consulenti.

Nel 2026, è chiaro che l’AI non è più un’ambizione futuristica per i servizi finanziari. È sempre più presente nelle operazioni quotidiane di banche, assicurazioni e gestori patrimoniali, in aree come la rilevazione in tempo reale delle frodi e le decisioni di credito, offrendo percorsi clientelari più personalizzati.

Quando le decisioni basate su AI diventano mainstream

Le decisioni abilitate dall’AI influenzano ora approvazioni di credito, avvisi di frode, profilazione del rischio e segmentazione dei clienti. A differenza dei sistemi tradizionali, i modelli moderni sono spesso adattivi, aggiornandosi man mano che i nuovi dati arrivano. I controlli legacy che si basano su validazioni temporanee e test storici non sono sufficienti da soli. Senza supervisione continua, le aziende rischiano di subire un degrado delle performance, bias nascosti che danneggiano i risultati e scelte difficili da spiegare ai clienti o ai regolatori.

Oltre la gestione del rischio tradizionale

La gestione del rischio tradizionale rimane fondamentale, ma deve essere integrata per l’AI. Le aziende dovrebbero adottare monitoraggio continuo, governance del ciclo di vita e rigorosa documentazione della provenienza dei dati, addestramento, test e aggiornamenti. Non si tratta solo di conformità, ma di resilienza. I modelli non monitorati possono degradarsi silenziosamente fino a quando i problemi non diventano visibili per clienti o supervisori.

Un panorama delle minacce informatiche in rapida evoluzione

L’AI amplia sia la superficie di attacco che i vettori di attacco. Minacce come il “data poisoning” (manipolazione dei dati di addestramento), l’inversione del modello e gli attacchi di iniezione di prompt stanno diventando sempre più sofisticati. Una protezione efficace ora richiede una combinazione di disciplina informatica e comprensione di come i modelli apprendono e si comportano nel tempo, soprattutto quando sono in gioco dati e fiducia dei clienti.

Responsabilità del consiglio e supervisione etica

La responsabilità per la governance dell’AI si sta spostando decisamente verso i consigli e la leadership senior, insieme alla sicurezza informatica e ai controlli finanziari. Ciò include la formazione del personale non solo per utilizzare gli strumenti AI, ma anche per comprendere i rischi normativi, reputazionali, finanziari, etici e operativi e come gestirli.

La regolamentazione alza il livello

Le aspettative normative si stanno inasprendo. Le normative emergenti stanno spingendo le aziende a integrare principi di AI responsabile fin dall’inizio, coprendo la classificazione del rischio, la documentazione, la trasparenza e il monitoraggio post-mercato, piuttosto che adattare i controlli in un secondo momento. Anche se i consulenti non sono direttamente coinvolti, sentiranno l’impatto attraverso fornitori di piattaforme, produttori di prodotti e partner dei dati.

La governance come vantaggio competitivo

Nel 2026, il fattore differenziante non sarà quanto ampiamente l’AI è distribuita, ma quanto intelligentemente è governata. Le aziende che investono in un’adeguata supervisione, trasparenza e quadri etici innovano con fiducia, proteggono i clienti e rispondono in modo credibile ai controlli normativi. Per i consulenti e i loro clienti, una governance efficace dell’AI non è un problema tecnico astratto, ma è fondamentale per la fiducia, la resilienza e la credibilità della consulenza finanziaria in un mondo sempre più automatizzato.