Perché i Sistemi AI Agentici Necessitano di una Migliore Governance – Lezioni da OpenClaw

Le organizzazioni hanno urgentemente bisogno di strutture di governance costruite attorno alla visibilità, al controllo degli accessi e al monitoraggio del comportamento per gestire l’ampia superficie di attacco che questo crea.

OpenClaw e i Sistemi AI Agentici

OpenClaw è una piattaforma open-source per agenti AI autonomi che può essere auto-ospitata e eseguita localmente sul proprio computer per l’automazione dei compiti. Gli agenti AI ora interagiscono tra loro tramite una rete sociale sperimentale per agenti AI chiamata Moltbook. Anche un esperto ricercatore di sicurezza AI ha scoperto che OpenClaw non è privo di rischi, dimostrando che un agente AI ha accidentalmente cancellato le email di un utente.

Transizione da Raccomandazioni ad Autorità

Gli assistenti AI di OpenClaw non sono più chatbot legacy. Hanno subito un significativo aggiornamento e ora fungono da livello di esecuzione automatizzato tramite chat. Possono accedere a strumenti e sistemi, sfruttando la memoria persistente e i permessi ereditati per agire per conto dell’utente. Questa transizione implica che un singolo comando possa attivare l’accesso a file, chiamate API, messaggi a terzi o apportare modifiche all’infrastruttura.

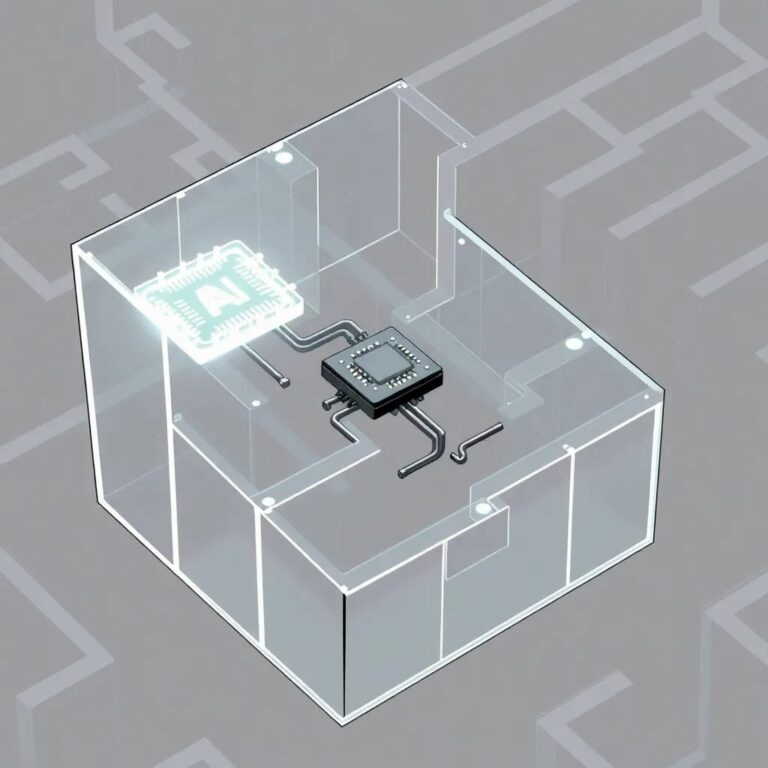

Il Framework di OpenClaw

Il gateway di OpenClaw funge da piano di controllo sempre attivo che riceve messaggi in arrivo, mantiene sessioni e connessioni di canale, e instrada richieste all’agente, agli strumenti o ai servizi giusti. Se questo ‘portone principale’ viene compromesso, il raggio d’azione del rischio cresce notevolmente, poiché l’esposizione può attivare azioni legittime attraverso più app e servizi.

Rischi e Sfide nella Governance

Le linee guida di OpenClaw si concentrano sulla riduzione dell’esposizione del gateway e sull’applicazione di un’autenticazione più forte. Tuttavia, queste linee guida possono risultare insufficienti su scala aziendale. Le aree ad alto rischio includono:

- Iniezione di Comandi: I comandi malevoli possono far accedere l’assistente a dati non autorizzati sfruttando i permessi ereditati.

- Deriva della Catena di Fornitura: L’aggiunta di estensioni può portare a un comportamento di terzi non controllato.

- Consegna di Malware: Strumenti noti possono essere utilizzati per consegnare malware attraverso installer falsi o estensioni compromesse.

Un Approccio Ideale alla Governance

La governance ideale dovrebbe essere fondata su:

- Visibilità: Rintracciare l’uso non autorizzato degli agenti AI per implementare politiche adeguate.

- Controllo: Stabilire guardrail di implementazione e distribuzione per OpenClaw e testare gli agenti in un’implementazione limitata.

- Blocco dei Percorsi Malevoli: Difese a livello di rete possono rilevare traffico sospetto e comportamenti anomali.

Gestire il rischio degli agenti AI richiede una comprensione più profonda delle minacce e delle vulnerabilità. È essenziale che le organizzazioni adottino una governance che contempli la complessità dei sistemi agentici e che si focalizzi su ricerca continua e migliori controlli comportamentali.