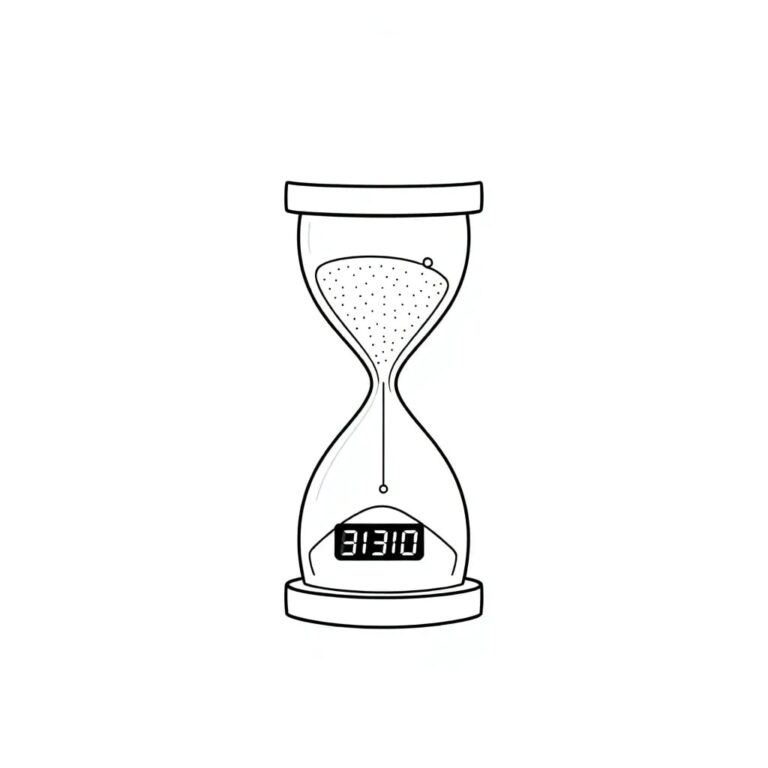

L’etica è la questione definitoria per il futuro dell’IA. E il tempo sta scadendo.

Con l’aumento degli investimenti nell’intelligenza artificiale (IA), un elemento critico non riceve sufficiente attenzione, aumentando i rischi per le persone, le aziende e la società. È necessario focalizzarsi di più sull’etica in relazione all’IA, sia in teoria che in pratica.

Perché l’etica dell’IA è in un momento cruciale ora?

La tecnologia sta crescendo più rapidamente delle normative o delle misure di sicurezza. L’IA sta già plasmando le vite delle persone, i danni sono reali, la regolamentazione è indietro e l’adozione sta accelerando. Le decisioni prese ora influenzeranno come l’IA sarà integrata nella società per decenni.

L’etica non può essere aggiunta in un secondo momento. Aspettare che l’IA sia completamente integrata nei sistemi critici per correggere i bias o le mancanze di governance sarà come installare le cinture di sicurezza dopo che le auto sono già in circolazione. I prossimi cinque anni rappresentano una finestra di opportunità per integrare i framework etici prima che i rischi diventino irreversibili.

Quali fattori hanno contribuito alla situazione attuale?

Una cultura di “muoversi rapidamente e sistemare dopo” può funzionare nella tecnologia per i consumatori, ma è pericolosa quando applicata ai sistemi di IA che determinano la solvibilità o il trattamento medico. Una volta che questi sistemi sono stati implementati, aggiungere etica dopo il fatto è più lento, costoso e difficile da far rispettare.

Le normative sono frammentate e in ritardo. La legge sull’IA dell’UE, che entrerà completamente in vigore nel 2026, rappresenta il primo regime normativo completo. Altrove, il panorama è irregolare: ci sono solo linee guida parziali negli Stati Uniti, mentre paesi come il Brasile, il Sudafrica e l’Indonesia stanno ancora sviluppando politiche.

Qual è la differenza tra etica dell’IA e IA etica?

Sebbene siano correlate, descrivono due prospettive: una teorica, l’altra pratica. L’etica dell’IA è lo studio accademico e filosofico delle questioni morali, sociali e politiche sollevate dall’intelligenza artificiale. Si preoccupa di principi, framework e dibattiti normativi. L’IA etica, al contrario, si riferisce all’implementazione pratica di quei principi nella progettazione, sviluppo e implementazione dei sistemi di IA.

Come viene affrontata l’IA etica?

L’IA etica è vista come una catena del valore, un insieme di attività interconnesse dove l’etica deve essere progettata e continuamente verificata. Ogni fase crea opportunità per il valore e rischi etici distinti che necessitano di controlli e responsabilità integrate fin dall’inizio. Questo approccio trasforma “essere etici” in chi fa cosa, quando e con quale evidenza.

L’etica dell’IA è un pensiero secondario per molte aziende?

Troppo spesso, l’etica dell’IA è stata trattata come un pensiero secondario piuttosto che come un principio di design centrale. Le organizzazioni possono aderire a principi “etici” ampi, ma quando si tratta di costruire o implementare l’IA, l’etica viene aggiunta in un secondo momento, se non del tutto.

Le pressioni competitive spingono le aziende a implementare l’IA rapidamente?

Le aziende si sentono spesso sotto pressione da parte di investitori, consigli o concorrenti per lanciare rapidamente i prodotti di IA. Quando l’IA viene implementata in fretta, piccoli errori possono trasformarsi in danni sistemici. La velocità può fornire un vantaggio competitivo temporaneo, ma spesso si ritorce contro. I lanci difettosi danneggiano la fiducia dei consumatori e attirano azioni legali e sanzioni normative.

C’è un vantaggio competitivo per le aziende che si concentrano maggiormente sull’IA etica?

Le aziende che sono trasparenti e giuste costruiscono una fiducia e una fedeltà al marchio più forti. L’IA etica sta passando da un centro di costo a un asset strategico. Le aziende che comprendono questo fin dall’inizio saranno meglio posizionate per il prossimo decennio.

Da dove verrà la leadership su queste questioni?

Da coloro che progettano, acquistano, implementano, assicurano e auditano l’IA. Questi attori possono muoversi più rapidamente rispetto alla legislazione e plasmare le norme attraverso l’adozione di standard e disciplina di mercato.

Come l’IA sta influenzando i MBA?

L’IA sta automatizzando parti di analisi e creazione di contenuti, ma il lavoro manageriale per cui i MBA sono formati sta diventando sempre più importante man mano che l’IA si espande. L’IA non sostituisce i MBA, ma crea nuovi ruoli di gestione che premiano i laureati in grado di connettere team tecnici, funzioni legali e di conformità, e le funzioni di profitto e perdita.

Cosa sta facendo l’istituto in modo diverso rispetto ad altre istituzioni accademiche che si concentrano sull’IA?

Si distingue per il suo focus operativo e manageriale, trattando l’etica dell’IA come una disciplina guidata dalla leadership integrata nella ricerca, educazione e coinvolgimento pratico. Equipaggia i leader aziendali con strumenti reali per governare l’IA in modo etico ed efficace.