Il conflitto tra Anthropic e il Pentagono durante la guerra in Iran mette in discussione l’etica della guerra con AI

(OSV News) — Mentre il fumo si alzava dalle rovine e i soccorritori estraevano 175 corpi dalle macerie della scuola elementare di Shajarah-Tayyebeh in Iran, il 28 febbraio, sono iniziate le domande su come questo potesse essere accaduto nelle prime ore della guerra tra Stati Uniti e Israele contro l’Iran.

Rapporti preliminari suggeriscono che la scuola sia stata scambiata per un sito militare a causa di informazioni umane obsoleti quando è stata colpita da un missile da crociera Tomahawk statunitense. Tuttavia, l’incidente ha anche attirato l’attenzione sul complesso intreccio tra l’uso dell’intelligenza artificiale generativa per l’elaborazione di mass data in potenziali obiettivi militari, identificati e classificati per l’approvazione da parte di revisori umani.

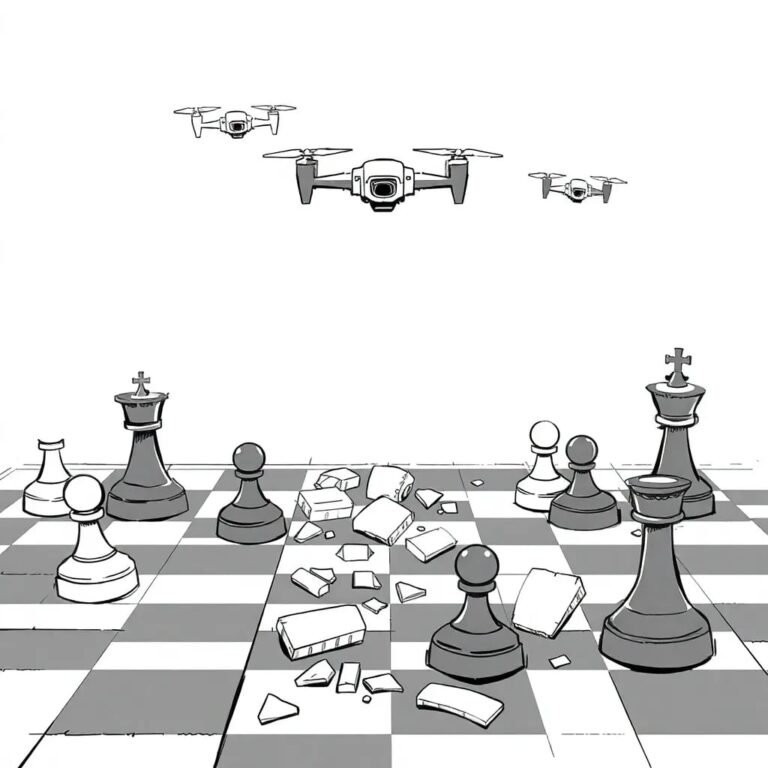

La “prima guerra AI”

In quello che alcuni commentatori definiscono “la prima guerra AI” — il conflitto attuale tra Stati Uniti, Israele e Iran — emergono numerose considerazioni etiche, sia vecchie che nuove. Ma molte di esse ruotano attorno alla stessa preoccupazione: l’AI non dovrebbe essere lasciata a se stessa.

Tuttavia, il 27 febbraio, alla vigilia dell’Operazione Epic Fury, il presidente ha diretto le agenzie governative a non lavorare più con il gigante tecnologico Anthropic, a causa di una differenza critica di opinioni sull’uso accettabile della sua tecnologia da parte del Dipartimento della Difesa. In risposta, Anthropic ha intentato causa contro il Pentagono il 9 marzo.

Il CEO di Anthropic ha affermato che in alcuni casi l’AI può minare, piuttosto che difendere, i valori democratici, sostenendo che alcuni usi sono semplicemente al di fuori dei limiti di ciò che la tecnologia attuale può fare in modo sicuro e affidabile.

Considerazioni etiche e morali

Un gruppo di 14 teologi morali cattolici ha presentato un documento di supporto a favore di Anthropic, notando che le obiezioni di Anthropic all’uso dell’AI per la sorveglianza di massa degli americani sono “allineate” con l’insegnamento cattolico sulla privacy. Hanno sostenuto che le armi letali autonome oscurano problematicamente l’agenzia umana, spostando pericolosamente la responsabilità dai decisori umani alle macchine.

Alcuni legislatori democratici hanno espresso preoccupazione riguardo ai rapporti che indicano come gli attacchi statunitensi e israeliani in Iran abbiano colpito scuole, ospedali e altri spazi pubblici. Hanno chiesto quale ruolo stesse giocando l’AI nella selezione degli obiettivi e nella valutazione delle informazioni, e a che punto fosse soggetta a revisione umana per la verifica.

Implicazioni della guerra AI

Le questioni etiche della guerra sono storicamente state protette da regole di ingaggio e supervisione rigorosa. Tuttavia, ci sono preoccupazioni riguardo all’approccio dell’amministrazione attuale su come viene condotta la guerra. I funzionari hanno affermato di non voler alcun freno sull’AI.

Osservatori hanno espresso preoccupazioni riguardo alla mancanza di controlli morali sulla tecnologia. Si è discusso se le istituzioni più grandi, come lo stato, debbano sopraffare le più piccole, come le aziende, nel determinare i valori che guidano l’uso dell’AI.

Conclusione

È fondamentale che l’uso dell’AI in contesti di guerra sia guidato da considerazioni morali e legali, con un’agenzia umana sempre presente nel processo decisionale. Deumanizzare la guerra potrebbe rendere troppo facile l’uso della forza letale, portando a conseguenze sproporzionate che devono essere attentamente monitorate.