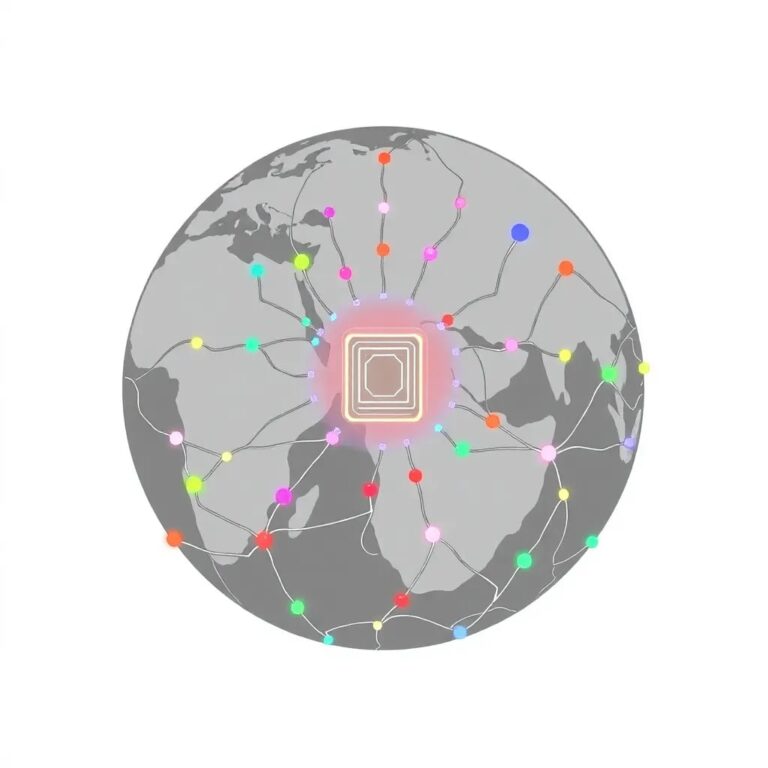

Governing A.I. Across Borders: Why Provenance Demands Global Cooperation

La questione della provenienza dell’IA si trova a un punto critico dell’intersezione tra diritti fondamentali e governance delle tecnologie emergenti. Verificare le origini sia dei dati di addestramento dell’IA che del contenuto generato implica direttamente le protezioni costituzionali per la libertà di espressione e la lotta contro la disinformazione. Man mano che il contenuto sintetico trascende i confini nazionali e erode la fiducia nel discorso democratico, queste sfide richiedono nuovi quadri che armonizzino gli standard internazionali rispettando al contempo la sovranità statale.

Problemi Attuali e Necessità di Governance Internazionale

Recenti ricerche mostrano che i consumatori identificano correttamente il contenuto generato dall’IA solo nel 50% dei casi, non facendo meglio del caso casuale. Questa crisi di autenticazione colpisce le democrazie in tutto il mondo, abilitando ciò che i ricercatori chiamano il “dividendo del bugiardo”, in cui attori malintenzionati possono respingere prove genuine affermando falsamente che i sistemi di IA le hanno prodotte. Inoltre, l’assenza di standard internazionali per la verifica dei dati di addestramento dell’IA e delle uscite generate minaccia di frammentare gli sforzi di governance globale, creando lacune normative che gli attori malintenzionati sfrutteranno inevitabilmente.

Limiti delle Soluzioni Nazionali

Leggi innovative, come quelle sulla trasparenza dell’IA, rappresentano progressi significativi nella regolamentazione domestica. Tuttavia, questi approcci nazionali divergenti creano problemi critici che solo il coordinamento internazionale può risolvere. Il contenuto sintetico circola globalmente, rendendo inefficaci i requisiti di autenticazione nazionali quando il contenuto attraversa i confini giurisdizionali. Inoltre, le normative frammentate impongono oneri di conformità impossibili per i fornitori di IA che operano a livello internazionale.

Sfruttare le Istituzioni Internazionali Esistenti

Una governance efficace dell’IA dovrebbe sfruttare le strutture istituzionali esistenti, come l’Organizzazione Mondiale del Commercio (OMC), per armonizzare gli standard tecnici. L’OMC potrebbe espandere il proprio quadro per includere specifiche relative agli standard dei dati di addestramento dell’IA. Inoltre, l’Organizzazione Mondiale della Proprietà Intellettuale (OMPI) potrebbe coordinare la verifica della provenienza delle uscite attraverso un sistema di certificazione a più livelli.

Progressi Recenti e Gap Residui

Eventi recenti come il Summit Internazionale sugli Standard dell’IA hanno segnato cambiamenti significativi verso strategie di attuazione orientate all’azione. Tuttavia, gli sforzi internazionali attuali si concentrano principalmente sulla provenienza delle uscite, trascurando le sfide relative all’origine, alla qualità e alla raccolta etica dei dati di addestramento. Inoltre, le pratiche lavorative dei lavoratori che etichettano i dati ricevono scarsa attenzione, nonostante il loro ruolo fondamentale nello sviluppo dei sistemi di IA.

Conclusione

Una governance internazionale efficace deve prevenire che le capacità dell’IA creino nuove forme di disuguaglianza tecnologica. La strada da percorrere richiede un equilibrio tra innovazione e responsabilità, sofisticazione tecnica e attuazione pratica, coordinamento globale e rispetto per la sovranità nazionale. Recenti sviluppi suggeriscono che la comunità internazionale sta riconoscendo sempre più queste sfide e l’urgenza di un’azione coordinata.