Il divario nell’AI vocale aziendale: Perché l’architettura — non la qualità del modello — definisce la tua posizione di conformità

Negli ultimi anni, i decisori aziendali si sono trovati di fronte a un trade-off architettonico rigido nell’AI vocale: adottare un modello “nativo” da parlato a parlato (S2S) per velocità e fedeltà emotiva, o rimanere con uno stack “modulare” per controllo e auditabilità. Questa scelta binaria si è evoluta in una segmentazione di mercato distinta, guidata da due forze simultanee che stanno rimodellando il panorama.

Ciò che un tempo era una decisione di prestazione è diventata una decisione di governance e conformità, mentre gli agenti vocali passano da piloti a flussi di lavoro regolamentati e a contatto con i clienti.

Le forze in gioco

Da un lato, Google ha commoditizzato il livello di “intelligenza grezza”. Con il rilascio di nuove versioni, Google si è posizionata come fornitore di utilità ad alto volume, rendendo l’automazione vocale economicamente sostenibile per flussi di lavoro precedentemente troppo economici da giustificare. Dall’altro lato, sta emergendo una nuova architettura “unificata” modulare. Fornitori come Together AI stanno affrontando i problemi di latenza che in precedenza ostacolavano i design modulari, offrendo velocità simile a quella nativa mantenendo le tracce di audit e i punti di intervento necessari per le industrie regolamentate.

I percorsi architettonici

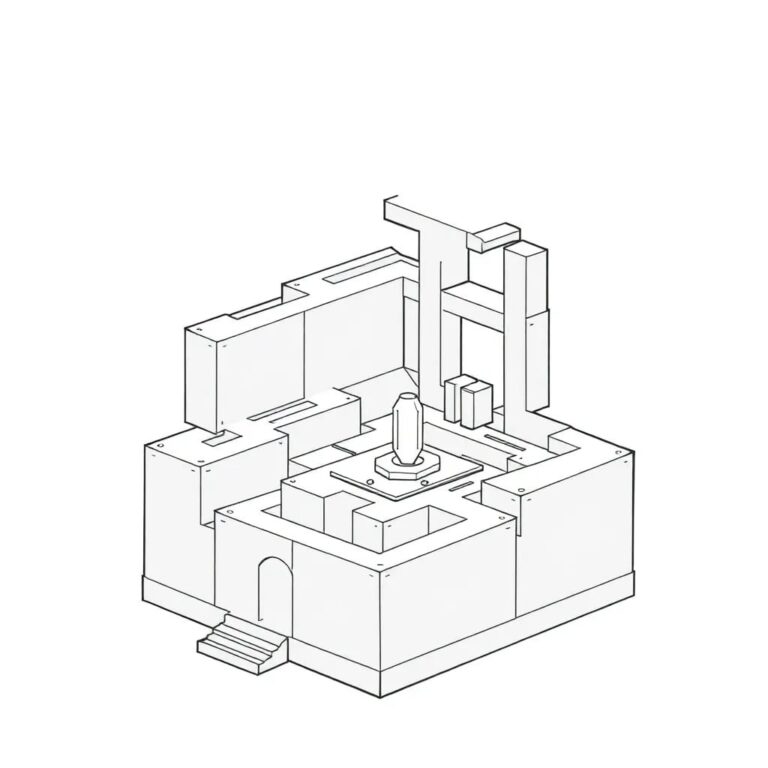

Le differenze architettoniche non sono solo accademiche; influenzano direttamente la latenza, l’auditabilità e la possibilità di intervenire nelle interazioni vocali dal vivo. Il mercato dell’AI vocale aziendale si è consolidato attorno a tre architetture distinte, ciascuna ottimizzata per diversi trade-off tra velocità, controllo e costo.

I modelli S2S, come quelli attuali, elaborano gli input audio in modo nativo per preservare segnali paralinguistici come toni e pause. Tuttavia, non sono veri modelli end-to-end. Operano come “Half-Cascades”: la comprensione audio avviene in modo nativo, ma il modello esegue ancora un ragionamento basato su testo prima di sintetizzare l’output vocale. Questo approccio ibrido raggiunge latenze nella gamma di 200-300 ms, mimando da vicino i tempi di risposta umani.

Modularità e controllo

Per le industrie regolamentate come la sanità e la finanza, “economico” e “veloce” sono secondari rispetto alla governance. I modelli nativi S2S funzionano come “scatole nere”, rendendo difficile l’audit di ciò che il modello ha elaborato prima di rispondere. Senza visibilità sui passaggi intermedi, le aziende non possono verificare che i dati sensibili siano stati gestiti correttamente.

Il modello modulare, d’altra parte, mantiene uno strato di testo tra trascrizione e sintesi, consentendo interventi impossibili con l’elaborazione audio end-to-end. Alcuni casi d’uso includono la redazione di PII, che consente di ridurre il rischio di conformità, e l’iniezione di memoria, che trasforma gli agenti in sistemi basati sulla relazione.

Conclusione

Il mercato è andato oltre la scelta tra “intelligente” e “veloce”. Le aziende devono ora mappare i propri requisiti specifici — posizione di conformità, tolleranza alla latenza, vincoli di costo — all’architettura che meglio le supporta. Per flussi di lavoro ad alto volume e a basso rischio, una soluzione economica può essere la scelta migliore, mentre per flussi di lavoro complessi e regolamentati, l’architettura modulare offre il controllo e l’auditabilità necessari.