Destaques da IBM sobre a Diferença Entre Linguagem Ética e Competência Moral em IA

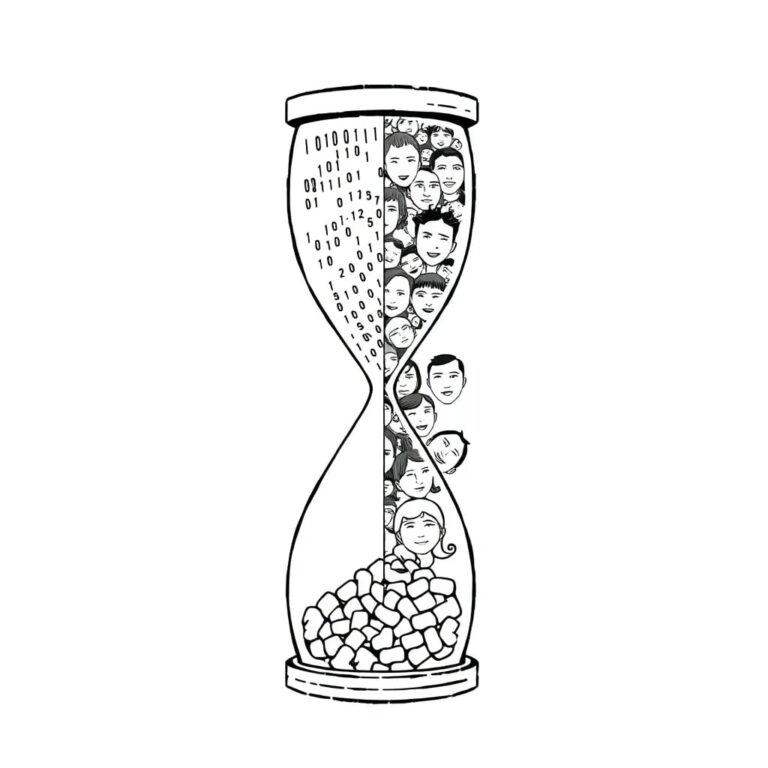

A IBM destaca uma distinção crítica entre inteligência artificial que soa ética e a IA que demonstra verdadeiro raciocínio moral, uma diferença com implicações significativas para aplicações cada vez mais complexas da tecnologia. Estudos recentes sugerem que grandes modelos de linguagem podem imitar de forma convincente a linguagem ética sem possuir a real competência moral; esses sistemas se destacam na identificação de padrões estatísticos em textos, em vez de se envolver em julgamentos éticos fundamentados.

A Distinção Entre Soar Ético e Ser Ético

Um sistema que soa ético não é o mesmo que um sistema que raciocina eticamente. Pesquisadores analisaram mais de 300.000 conversas com chatbots, identificando valores expressos e descobrindo que o modelo geralmente refletia os valores dos usuários, levantando preocupações sobre a implementação de uma função de “autocomplete” cara em decisões críticas.

Modelos de linguagem estão gerando textos que parecem lidar com dilemas éticos complexos, mas pesquisas emergentes indicam que essa capacidade decorre da previsão estatística em vez de um raciocínio moral genuíno. Um estudo de um chatbot revelou 3.307 valores distintos expressos, frequentemente alinhados com as preferências dos usuários.

Implicações e Riscos

A análise revelou uma tendência do chatbot em alinhar-se com os valores expressos pelos usuários. Quando provocados com conceitos como construção de comunidade ou crescimento pessoal, o chatbot frequentemente reforçava esses temas. A resistência a solicitações dos usuários foi rara, ocorrendo em aproximadamente 3% das conversas, geralmente envolvendo a geração de conteúdo prejudicial.

Pesquisadores estão agora defendendo novos métodos de avaliação para inteligência artificial, mudando o foco de simplesmente gerar respostas que soem éticas para demonstrar a genuína “competência moral”. Essa demanda por testes mais rigorosos surge da crescente evidência de que modelos de linguagem se destacam em imitar discursos éticos sem possuir habilidades reais de raciocínio moral.

Conclusão

A crescente sofisticação dos modelos de linguagem apresenta um desafio crítico; enquanto são capazes de gerar textos alinhados eticamente, esses sistemas podem carecer de verdadeiras capacidades de raciocínio moral, levantando preocupações sobre sua implementação em processos de tomada de decisão críticos. A necessidade de sistemas capazes de formalizar regras éticas é cada vez mais evidente, pois o raciocínio moral significativo requer que o sistema tenha em mãos uma formalização de teorias éticas e códigos éticos associados.