Risco sem Fronteiras: O Uso Malicioso da IA e o Alcance Global da Lei de IA da UE

Mensagens-chave

A Lei de Inteligência Artificial (IA) da UE é uma das primeiras regulamentações vinculativas de IA no mundo. Os formuladores de políticas da UE pretendem que ela sirva como um modelo para a governança global da IA, confiando no chamado Efeito Bruxelas.

Em um domínio que avança rapidamente, a qualidade regulatória é um pré-requisito para influência como modelo. Isso inclui fornecer uma cobertura adequada dos riscos mais críticos associados ao uso, implantação e adoção da IA.

Entre esses riscos está o uso malicioso, que surge do uso intencional das capacidades da IA para causar danos. Esta análise testa as disposições da Lei de IA contra os riscos de uso malicioso.

Análise dos Esforços de Segurança da IA Diante de Pressões Competitivas

No cenário geopolítico atual, a corrida pela dominância da IA entre estados e corporações foca na liderança tecnológica e capacidades, não na segurança e gestão de riscos. Os EUA lançaram o Plano de Ação da IA Americana em 2025, visando posicionar a IA americana como padrão global.

A China também busca liderança global em IA até 2030, por meio de políticas industriais coordenadas ao longo de toda a cadeia de valor da IA.

A UE lançou o Plano de Ação do Continente da IA em 2025, visando mobilizar infraestrutura de computação, dados e talentos.

Desigualdade na Cobertura de Riscos de Uso Malicioso

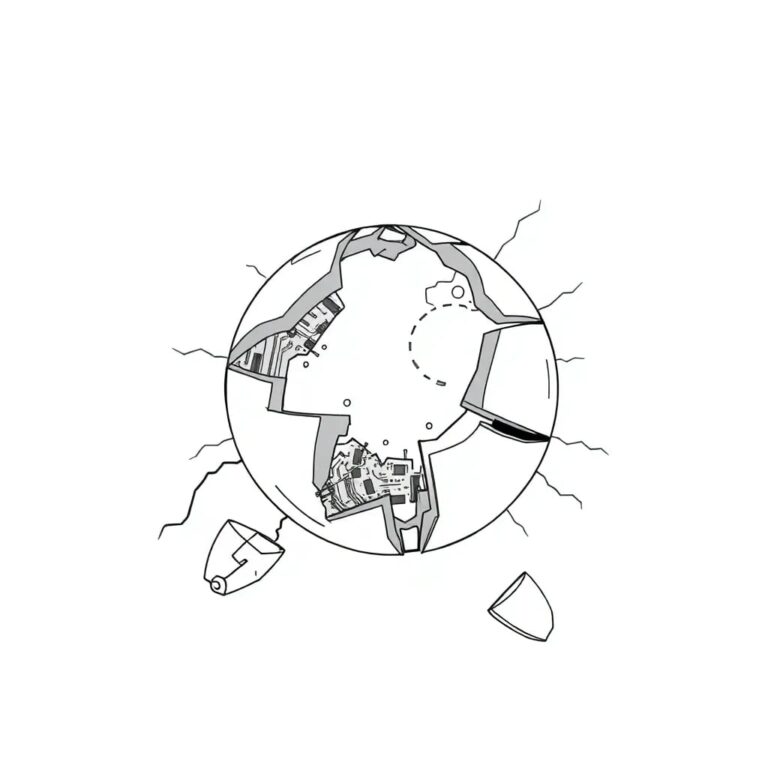

A cobertura da Lei de IA sobre os sub-riscos de uso malicioso é desigual. Quatro sub-riscos não têm cobertura direta, enquanto outros são abordados apenas parcialmente. Apenas um sub-risco, a vigilância estatal e opressão, possui cobertura extensa.

Os sub-riscos não cobertos diretamente incluem armas biológicas, IAs intencionais, armas autônomas e concentração de poder. Riscos como desinformação e fraudes são abordados apenas parcialmente.

Implicações e Conclusões

A Lei de IA da UE apresenta um passo importante para a governança da IA, mas seu alcance e influência global serão limitados não apenas por obstáculos de implementação, mas também por seu design. Os formuladores de políticas devem reconhecer as limitações significativas na cobertura de riscos, especialmente os riscos de uso malicioso.

Para que a Lei de IA possa servir como modelo de gestão de riscos, deve abordar adequadamente os riscos de uso malicioso. Caso contrário, sua influência global será reduzida e poderá ser superada por outras estruturas regulatórias que tratem melhor os riscos conhecidos.