Inteligência Artificial Inspirada no Cérebro Necessita de Novas Regras

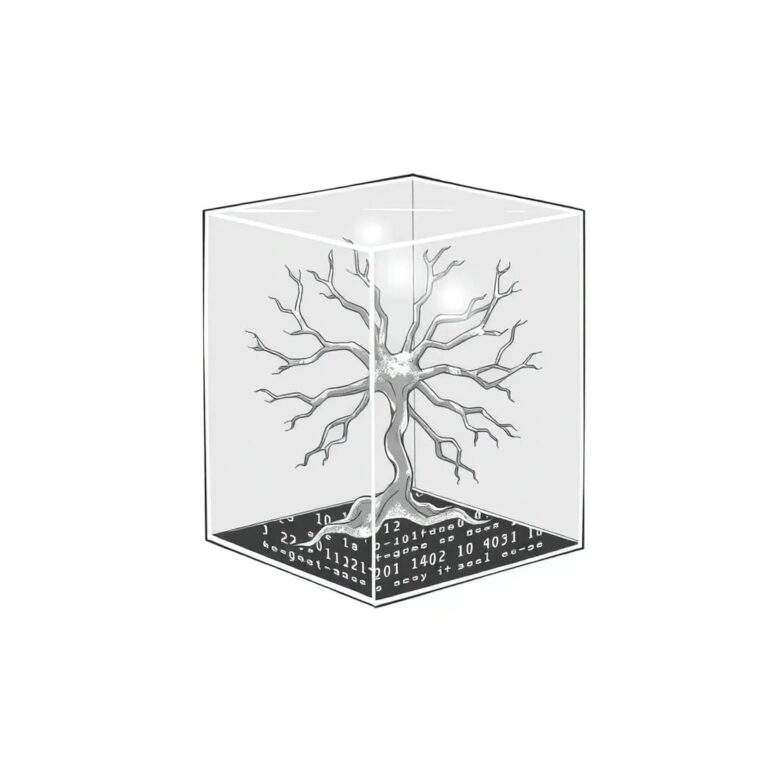

A pesquisa sobre a governança de sistemas NeuroAI e neuromórficos está ganhando cada vez mais atenção. As abordagens regulatórias atuais mostram-se inadequadas para estas arquiteturas, que diferem fundamentalmente das redes neurais artificiais estáticas que operam em hardware convencional. É necessário reavaliar os métodos de garantia e auditoria, promovendo uma co-evolução da regulação junto com a computação inspirada no cérebro para assegurar uma supervisão eficaz e tecnicamente sólida.

Desafios na Governança de NeuroAI

Os sistemas NeuroAI, construídos sobre hardware neuromórfico e utilizando redes neurais de disparo, desafiam as suposições que fundamentam as normas regulatórias atuais. Este trabalho destaca a necessidade de os métodos de auditoria evoluírem junto com essas novas arquiteturas, alinhando as métricas tradicionais de regulação com a física única e as dinâmicas de aprendizado da computação inspirada no cérebro.

Avanços e Implicações

A computação neuromórfica representa uma convergência entre neurociência e inteligência artificial, visando criar sistemas mais inteligentes e eficientes. Essa mudança é realizada através das redes neurais de disparo, que operam de maneira assíncrona e são impulsionadas por eventos. No nível algorítmico, isso se traduz em uma comunicação que utiliza picos discretos para codificar informações.

As implicações para a governança são significativas, especialmente em aplicações críticas, como dispositivos de saúde e veículos autônomos, onde a segurança e a responsabilidade são fundamentais. As estruturas de governança atuais, como o Ato de IA da UE e a estrutura de gestão de risco de IA dos EUA, foram projetadas para modelos de IA estáticos e centralmente treinados, não capturando o comportamento adaptativo dos sistemas neuromórficos.

Necessidade de Novas Abordagens Regulatórias

Os métodos tradicionais de auditoria e avaliação são inadequados para os sistemas NeuroAI, que aprendem continuamente e interagem com dados do mundo real. A pesquisa sugere a criação de novos frameworks, como o NeuroBench, que avaliam o desempenho em níveis de tarefa, modelo e plataforma, ligando a performance algorítmica à eficiência do hardware.

A análise demonstra que as características computacionais dos processadores neuromórficos não se encaixam nas premissas de avaliação atuais, que consideram que mais operações flutuantes por segundo (FLOPs) equivalem a maior capacidade e risco. A pesquisa enfatiza que a auditoria em sistemas NeuroAI requer uma análise dinâmica e não pode depender de métricas estáticas.

Conclusão

À medida que a computação neuromórfica avança de laboratórios para aplicações do mundo real, é crucial que a governança evolua para lidar com os desafios éticos e de segurança que surgem. O desenvolvimento de métodos de garantia e auditoria que se alinhem com as dinâmicas de aprendizado e a física subjacente da computação inspirada no cérebro é essencial para garantir uma transição responsável para aplicações práticas.