Estado das Leis de Segurança de IA: Califórnia e Nova York

Insights Regulatórios

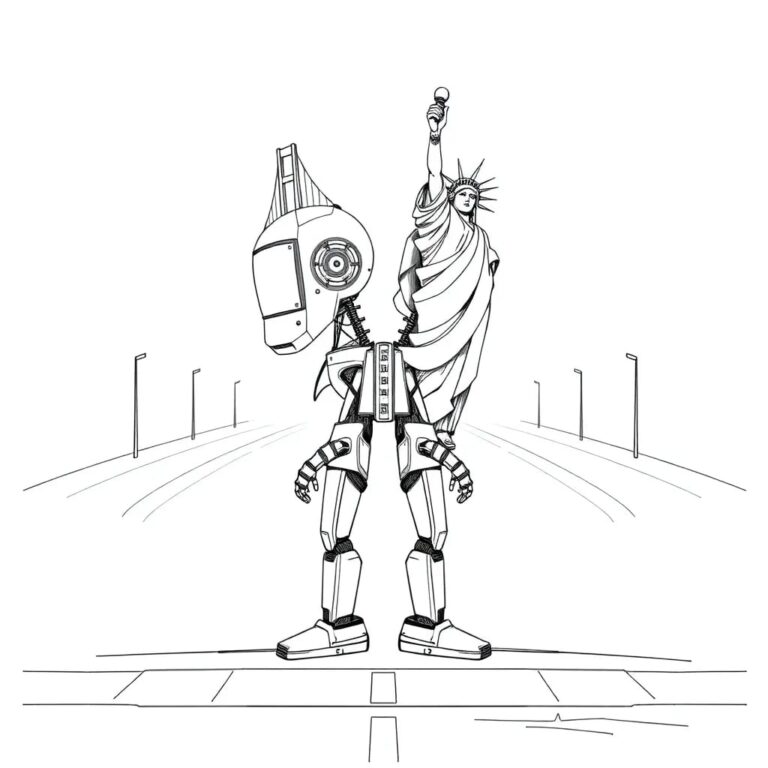

Convergência Marcante

A lei TFAIA da Califórnia foi a primeira a abordar os riscos potencialmente catastróficos da IA. Notavelmente, o governador de Nova York optou por adotar a maior parte das disposições da Califórnia para criar um “padrão unificado” entre os estados.

Desenvolvedores e Modelos Grandes

Atualmente, apenas algumas empresas e modelos podem atender aos limiares de receita e computação, que serão avaliados anualmente e poderão ser revisados com base no desenvolvimento tecnológico e/ou padrões.

Futuro Incerto

Algumas leis estaduais de IA podem ser desafiadas sob o EO 14365; não está claro se a opção de deferir para as leis ou orientações federais pode aliviar alguns ou todos esses riscos.

Legislação de Segurança em IA

No final de 2025, a Califórnia e Nova York promulgaram leis para impor proteções para a implantação segura de grandes “modelos de IA de fronteira”. As leis visam mitigar riscos catastróficos exigindo que os desenvolvedores publiquem informações sobre seus protocolos de segurança, incluindo avaliações de risco, e relatem incidentes de segurança críticos ao estado.

A lei da Califórnia, chamada de Lei de Transparência em Inteligência Artificial de Fronteira (TFAIA), foi sancionada em 29 de setembro de 2025 e entrou em vigor em 1º de janeiro de 2026. A lei de Nova York, chamada de Lei de Segurança e Educação em IA Responsável (RAISE Act), foi sancionada em 16 de dezembro de 2025 e entrará em vigor em 1º de janeiro de 2027.

Pontos Notáveis

O Escritório da Casa Branca emitiu a Ordem Executiva 14365, “Garantindo um Quadro de Política Nacional para Inteligência Artificial”, em 11 de dezembro de 2025. A EO estabelece diretrizes para criar um quadro de política federal para leis e regulamentos de IA, limitando a fragmentação regulatória e leis excessivas que possam inibir a inovação.

A versão final da RAISE Act, acordada pelo governador, difere substancialmente da versão aprovada pela legislatura. Antes de assinar, o governador pode negociar com os líderes legislativos para fazer alterações, referidas como “emendas de capítulo”, que são introduzidas como uma legislação separada.

Principais Disposições e Comparação das Leis da Califórnia e Nova York

- Requisito Principal: Framework de IA de Fronteira – um conjunto de protocolos técnicos e organizacionais documentados que um grande desenvolvedor deve implementar.

- Modelos: Modelo de Fronteira, definido como um modelo fundamentado treinado com mais de 1026 operações.

- Desenvolvedores: Inclui “desenvolvedores de fronteira” com receita anual superior a 500 milhões de dólares.

- Risco: Risco catastrófico é definido como um risco que pode resultar em morte ou dano significativo.

- Agência Líder do Estado: Escritório de Serviços de Emergência da Califórnia para relatórios (CA); não aplicável (NY).

- Definição de Incidente: Incidente de Segurança Crítico, incluindo acesso não autorizado a modelos.

- Relato de Incidentes: Relatar incidentes críticos ao OES dentro de 15 dias (CA); não aplicável (NY).

- Divulgação Pública: Publicar o “Framework de IA de Fronteira” e um “Relatório de Transparência” para cada novo modelo.

- Penalidades Principais: Ação civil pelo escritório do procurador-geral.

- Proteções de Denunciantes: Protege funcionários que relatam incidentes críticos (CA); não aplicável (NY).

- Âmbito: Aplica-se a qualquer modelo de fronteira desenvolvido ou operando dentro do estado.

- Cláusula de Severabilidade: Se qualquer parte da lei for considerada inválida, as disposições restantes permanecerão em vigor.

- Proibição de Declarações Falsas: Proíbe declarações falsas sobre riscos ou conformidade.

Conclusão

A promulgação das leis de segurança em IA na Califórnia e Nova York representa um passo significativo na regulamentação do uso de tecnologias de IA. Com a implementação de requisitos rigorosos de segurança e transparência, espera-se que essas legislações ajudem a mitigar os riscos associados ao desenvolvimento e uso de modelos de IA de fronteira. No entanto, a incerteza sobre a interação entre as legislações estaduais e as diretrizes federais ainda precisa ser resolvida.