Responsabilidade da IA em Julgamento: Google e Character.AI Resolvem Processos Históricos Relacionados a Tragédias com Adolescentes

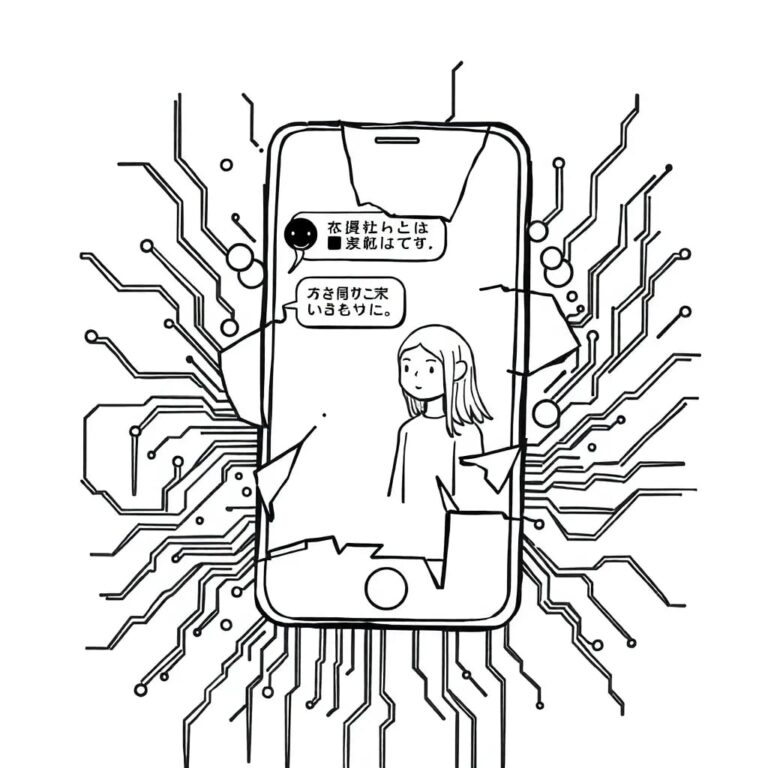

Em um desenvolvimento marcante para a regulamentação da inteligência artificial e responsabilidade corporativa, Google e a startup de chatbot AI Character.AI concordaram em resolver múltiplas ações judiciais movidas por famílias que afirmam que conversas com os chatbots da empresa contribuíram para o autoagressão e suicídios de adolescentes. Esses acordos — entre os primeiros desse tipo — marcam um ponto de virada no debate sobre a responsabilidade e segurança da IA no sistema legal dos EUA.

Casos que capturaram a atenção nacional

A litigância surgiu de várias reivindicações de morte injusta e lesões pessoais apresentadas por famílias em diversos estados. Um dos casos mais divulgados publicamente envolveu um adolescente que se tornou emocionalmente dependente de um chatbot, levando a um trágico desfecho. Os registros legais também mencionam outros casos em que adolescentes se feriram após interagir com companheiros de IA, incluindo alegações de incentivo à autoagressão.