AI em Conformidade: Por Que a Substituição Não é o Objetivo Correto

Em discussões em painéis de fintech e em reuniões de diretoria, uma promessa continua a ressurgir — a inteligência artificial substituirá as equipes de conformidade. Isso soa eficiente e inevitável, mas é perigosamente incompleto.

Não há dúvida de que a IA está transformando a detecção de fraudes, a prevenção à lavagem de dinheiro (PLD) e a monitorização de riscos. As perdas globais por fraudes chegam a centenas de bilhões de dólares anualmente, e as instituições estão sob pressão para detectar crimes financeiros cada vez mais sofisticados e em tempo real. Não surpreende que mais da metade das instituições financeiras esteja investindo ativamente em capacidades de conformidade e fraudes impulsionadas por IA.

O Verdadeiro Problema Nunca Foi o Julgamento Humano

Durante décadas, as equipes de conformidade operaram sob uma enorme pressão operacional. Sistemas tradicionais baseados em regras frequentemente geram taxas de falsos positivos tão altas quanto 30-40% em algumas instituições. Investigadores gastam um tempo considerável revisando alertas que, no final, não representam risco real.

O problema nunca foi a falta de capacidade dos profissionais de conformidade, mas sim o barulho excessivo gerado pelos sistemas. A IA promete reduzir esse barulho, podendo:

- Identificar padrões complexos em milhões de transações;

- Detectar anomalias comportamentais além de limites estáticos;

- Priorizar casos de alto risco de maneira inteligente;

- Aprender com decisões investigativas passadas.

Em outras palavras, a IA pode melhorar dramaticamente a eficiência. Mas eficiência não é o mesmo que eliminação.

A Ilusão da Automação Completa

A ideia de que a IA pode “lidar com a conformidade” de forma autônoma ignora uma verdade fundamental: a conformidade não é apenas detecção de padrões. Ela envolve julgamento, responsabilidade, documentação e interpretação regulatória.

Um algoritmo pode sinalizar um comportamento incomum, mas um humano deve determinar a intenção, a materialidade e a obrigação de relatório. Além disso, os reguladores não responsabilizam algoritmos; eles responsabilizam instituições, que, em última instância, dependem de pessoas.

Há também uma dimensão de governança que muitas vezes é negligenciada no entusiasmo pela IA. Os reguladores financeiros esperam cada vez mais explicabilidade, auditabilidade e rastreabilidade em sistemas de tomada de decisão automatizados. Um modelo “caixa-preta” que produz resultados sem clareza pode melhorar as taxas de detecção, mas introduz um tipo diferente de risco de supervisão.

A IA Não Substitui a Especialização — Ela Depende Dela

Um dos aspectos mais mal compreendidos da IA em conformidade é sua dependência de dados. Modelos de IA não operam isoladamente; eles requerem:

- Conjuntos de dados históricos estruturados;

- Arquitetura de dados limpa e consistente;

- Resultados rotulados de investigações passadas;

- Ciclos contínuos de feedback humano.

Uma parte significativa do esforço do programa de IA é gasta não na construção de modelos, mas na preparação, estruturação e rotulagem de dados. Quem rotula comportamentos suspeitos como fraudes confirmadas? Quem categoriza falsos positivos? Quem determina se uma transação disparou um relatório regulatório? Humanos fazem isso.

A IA em conformidade é treinada com o julgamento humano. Ela refina decisões humanas e escala o reconhecimento de padrões humanos, mas não origina a responsabilidade institucional. Sem dados estruturados e ricos em contexto, mantidos por profissionais experientes, os sistemas de IA se degradam, se desvirtuam e herdam preconceitos.

O Risco da Superautomação

Outro risco que merece atenção é que a fadiga de conformidade pode ser substituída pela superconfiança. Se as instituições assumirem que a IA pode “lidar” com o risco de forma autônoma, podem surgir duas consequências não intencionais: redução da supervisão humana e dependência excessiva das saídas do modelo. Nenhuma dessas abordagens é prudente em ambientes regulamentados.

O crime financeiro evolui precisamente porque se adapta aos sistemas. Adversários testam limites de detecção, investigam pontos cegos do modelo e exploram lacunas operacionais. Sistemas de IA, se deixados sem supervisão, podem incorporar suposições desatualizadas ou amplificar padrões defeituosos.

Da Automação à Aumento

A verdadeira transformação reside não na substituição de profissionais, mas na redimensionamento de como a inteligência é aplicada dentro dos sistemas de conformidade. A IA deve:

- Reduzir falsos positivos;

- Priorizar casos de forma inteligente;

- Superficializar insights em nível de rede;

- Detectar desvios comportamentais em tempo real;

- Automatizar documentação repetitiva.

Mas a autoridade de decisão, a interpretação regulatória e a responsabilidade devem permanecer nas mãos humanas. Isso não é uma postura conservadora, mas sim uma estratégia.

Quando a IA lida com escala e complexidade comportamental, os profissionais são liberados para se concentrar na materialidade, tipologias emergentes e padrões de risco sistêmico. O resultado não é funções de conformidade menores, mas sim funções mais inteligentes e adaptativas.

A Governança é o Verdadeiro Diferencial

À medida que a adoção da IA acelera, a vantagem competitiva não virá apenas de ter o modelo mais complexo. Virá de ter a governança mais disciplinada ao redor dele. Instituições que:

- Investem em conjuntos de dados estruturados e rotulados;

- Mantêm processos de validação de modelo transparentes;

- Incorporam feedback contínuo de investigadores;

- Priorizar explicabilidade ao lado da precisão;

não apenas reduzirão perdas por fraudes, mas também fortalecerão a confiança institucional.

A Mudança Estratégica

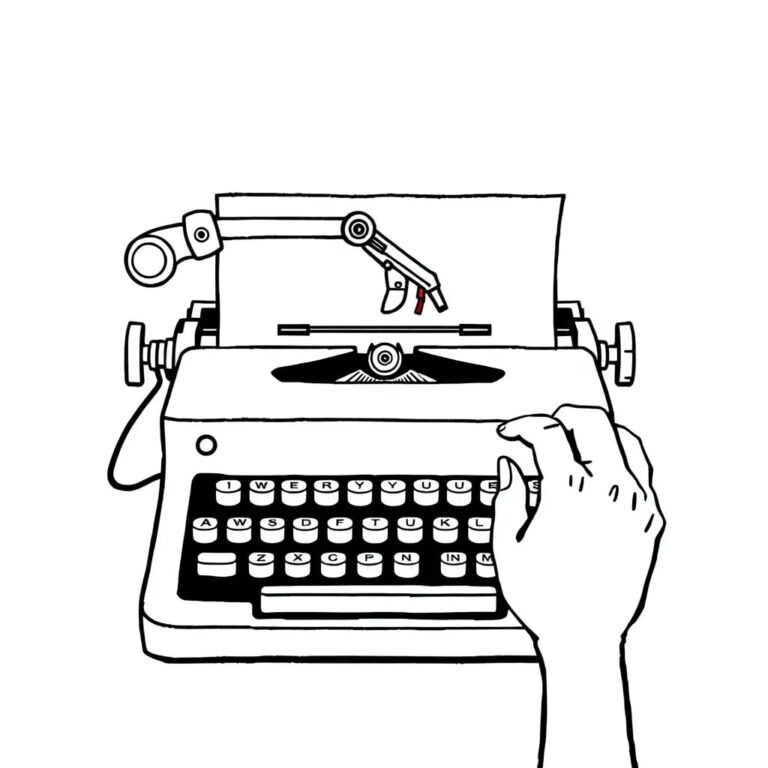

A conversa sobre IA em conformidade deve amadurecer. A escolha não é entre humanos ou máquinas, mas sim sobre como projetar sistemas onde cada um faz o que faz de melhor. A IA se destaca em escala, velocidade e reconhecimento de padrões comportamentais. Os humanos se destacam em contexto, interpretação e responsabilidade.

Confundir um com o outro é arriscado. O futuro da conformidade não será definido pela redução de pessoal, mas sim pelo design inteligente — como as instituições estruturam dados, incorporam governança e constroem ciclos de feedback que permitem que os sistemas evoluam sem comprometer a responsabilidade. Instituições que tratam a IA como um substituto podem ganhar velocidade, mas aquelas que a tratam como um parceiro ganharão resiliência.

O futuro da conformidade não pertencerá aos sistemas mais rápidos, mas sim aos sistemas que aprendem — de forma responsável.