A IA selou o capô. Em breve, ninguém poderá corrigir o código quando ele quebrar

Desde a chegada do motor de combustão interna, as oficinas de reparo automotivo podiam consertar praticamente qualquer coisa de qualquer marca e modelo com ferramentas básicas. Então veio a modernização; os motores com injeção de combustível tomaram conta.

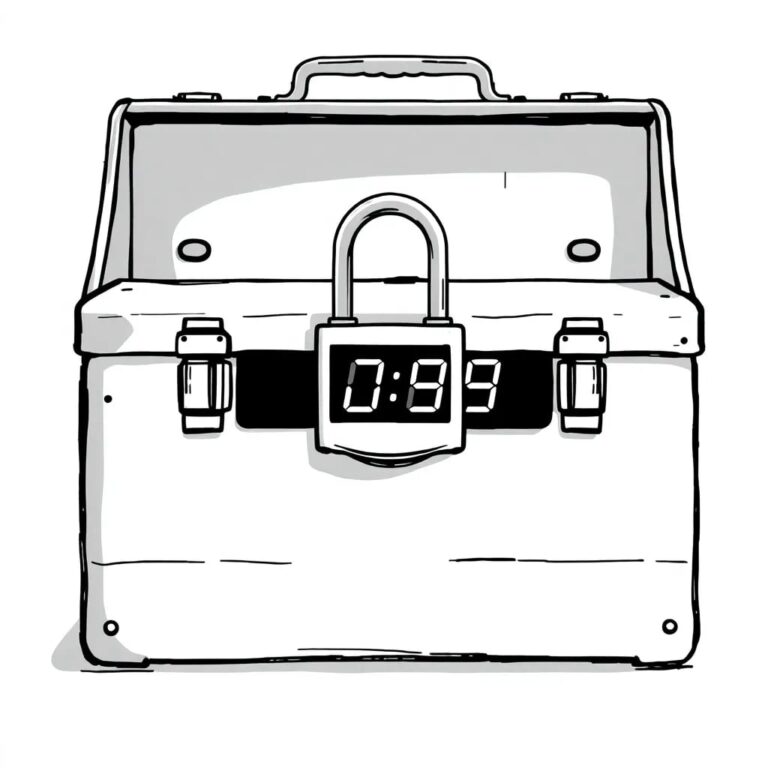

Da mesma forma que os motores com injeção de combustível substituíram pistões, velas de ignição e carburadores, garantindo que ninguém olhe sob o capô de seu carro, a codificação por IA está substituindo a capacidade de serviço da codificação, não sua existência. Agora, ninguém está olhando para suas aplicações web.

O risco de código ruim aparecendo em toda parte é um aspecto do problema. Mas o risco mais profundo é a perda de habilidades fundamentais em serviço e manutenção do código. Não há componentes substituíveis em campo quando tudo é uma máquina de Rube Goldberg desgastada de funções e bibliotecas de software que podem funcionar quando implantadas, mas se tornam inadministráveis e insustentáveis.

As aplicações funcionam, mas menos pessoas realmente sabem por quê ou como. Conforme explorado, a perda de nossa relação com a maquinaria subjacente também resulta na perda de nossa conexão com a qualidade. Essa perda de capacidade de serviço não é apenas inconveniente. É uma nova forma de risco.

A evidência não é teórica

Estudos mostram que uma em cada cinco organizações já sofreu um incidente sério devido ao código gerado por IA. Quase 70% descobriram vulnerabilidades introduzidas por assistentes de IA.

Quando a IA introduz uma falha, ninguém sabe quem arca com as consequências. Ao perguntar quem seria o responsável por uma violação introduzida pela IA, as respostas foram divididas entre engenharia, segurança e o fornecedor, indicando que a governança não acompanhou a automação.

Engenheiros em início de carreira agora trabalham quase inteiramente na camada de abstração. Eles entregam código mais rápido, mas com muito menos exposição a sistemas, redes ou modos de falha. Isso enfraquece o julgamento humano necessário para desafiar a saída da IA antes que ela chegue à produção. É tudo um processo posterior e parece que os humanos estão envolvidos apenas para serem responsabilizados.

O código gerado pela IA é um amplificador dos valores centrais e da cultura de segurança de uma organização. Se a organização tem um bom DNA de segurança, as ferramentas de IA melhorarão essa cultura. Mas se uma organização carece de disciplina e gestão de risco básica, o desenvolvimento de software autônomo refletirá essa cultura de segurança imatura.

Quando o algoritmo falha, quem é culpado?

Considere uma empresa de negociação que inicia um experimento de negociação autônoma. Quando o algoritmo falha, a empresa perde dinheiro. Não há muito apontar dedos porque foi um experimento usando seu próprio capital. Agora, vamos aumentar as apostas.

Uma empresa de saúde oferece conselhos através de clínicos. Mais de uma organização está buscando aproveitar modelos de linguagem como personagens não jogáveis (NPCs) sussurrando a profissionais de saúde durante discussões de atendimento ao paciente. Certamente haverá uma troca de culpados quando um paciente sofrer um resultado inesperado parcialmente devido a um algoritmo não determinístico. Quem é responsável por lesões ou perda de vida?

Imagine um conselho de NPCs checando o trabalho uns dos outros. Cada um baseado em um modelo diferente, com dados de treinamento diferentes e diferentes potenciais de alucinação. O número precisará ser ímpar para evitar um empate. Esse tipo de trabalho já está surgindo com iniciativas atuais.

Mas nunca devemos esquecer que a documentação inicial de modelos de linguagem advertia contra o uso em programas de saúde mental. Sua abordagem à resolução de problemas é prever o próximo token mais provável. Quando se discute depressão e suicídio, os modelos sugerirão, naturalmente, o suicídio como o resultado mais lógico.

O setor de seguros não está preparado

Ouvindo risadas nervosas ao mencionar seguros para perdas devido à IA autônoma. Mas faz sentido que seguradoras criem coberturas para negligência, infração de propriedade intelectual e responsabilidades regulatórias. O seguro de responsabilidade por IA terá que crescer à medida que os incidentes ocorrem. O oposto também está acontecendo, com grandes seguradoras buscando exclusões de IA em coberturas existentes, dadas as imprevisibilidades de sistemas não determinísticos.

A simplificação da codificação

Mas voltando à raiz do problema. Desenvolvedores iniciantes não estão sendo substituídos, mas seu trabalho está mudando. Analistas de SOC de nível básico monitoram algoritmos decidindo se eventos de log são maliciosos. Estagiários de marketing produzem apresentações sem designers gráficos.

O termo “sobras” é aplicado às saídas de modelos de linguagem com uma intenção decididamente pejorativa. Para o mundo da arte, isso deve parecer um ataque. A arte e o design existem em constante diálogo com o passado, reagindo a movimentos anteriores com gosto cultivado. Agora, visualizações são reduzidas a estética mundana, produzidas sem esforço e desprovidas de respeito.

Estamos experimentando o equivalente no desenvolvimento de software à mesma simplificação. Alguém escreveu que podemos ser ampliados pela IA ou abdicar dela. Mas abdicação sugere a renúncia a um trono de responsabilidade. Muitos usuários de codificação por IA nunca atingiram essa posição em primeiro lugar.

A proliferação de ferramentas agrava tudo

Estudos mostram que equipes que sofreram incidentes de segurança usaram mais ferramentas de fornecedores do que aquelas que não sofreram. E, no entanto, o ciclo continua se repetindo; novos problemas de segurança são inventados para serem resolvidos. Algumas ferramentas são o problema para seu problema. Algumas soluções são piores do que a doença. A proliferação de ferramentas tem sido parte do DNA da indústria de segurança desde o advento do firewall.

Existem dois tipos de profissionais de segurança: certificados e qualificados, com uma fina camada de sobreposição. Prefiro talentos qualificados. Muitos certificados não entendem como a internet funciona.

Existem também dois tipos de CISOs: CISOs pré-incidente e CISOs pós-incidente. CISOs pré-incidente estão focados em ferramentas e software. CISOs pós-incidente aprenderam que todas as ferramentas eventualmente falharão. Pessoas e processos são mais importantes. Muitas ferramentas são um problema. O código gerado por IA agrava isso.

A lacuna entre política e prática

Um auditor SOC2 procura a diferença entre política escrita e técnica praticada. Se você publica uma política armazenando dados de clientes em um bucket S3 acessível ao público e é isso que você faz, o auditor não terá objeções. Isso porque o SOC2 não é uma certificação. É a opinião de um contador sobre se você segue suas políticas.

Você pode se complicar em relação às suas políticas e procedimentos de duas maneiras: políticas perfeitas que não podem ser aplicadas ou nenhuma política escrita. Muitas empresas pulam da última para a primeira sem entender por que têm tantas constatações. Portanto, tenha cuidado ao pedir a um modelo de linguagem para escrever suas políticas, pois elas podem ser frequentemente “boas demais” ou avançadas em comparação com sua técnica e capacidades de aplicação reais.

A fome digital

Prevejo um cenário em que um agente de ameaça negligencia a QA adequada de seu malware, travando todos os dispositivos iOS na versão mais recente do sistema operacional. Esse é o elemento de monocultura porque uma porcentagem significativa de usuários de iOS está sempre na versão mais recente do software. A IA pode escrever malware que nem mesmo o suporte técnico da Apple pode redefinir.

No extremo oposto, o Android tem tantas variantes e versões que possui imunidade natural a eventos de fome digital. A Apple, no entanto, estará feliz em vender dispositivos de reposição para todos no mundo.

O NIST CSF 2.0 move “governar” para o centro do palco, mas esses controles não funcionarão se a experiência em software e segurança continuar diminuindo. A IA amplifica padrões bons e ruins, espalhando lógica falha rapidamente. O risco de monocultura aumenta à medida que as equipes dependem das mesmas estruturas geradas por IA. Quando perdemos a capacidade de manter nossos próprios sistemas, perdemos a própria qualidade.

O que as diretorias devem perguntar

As diretorias devem perguntar: “Você pode me mostrar exatamente onde o código gerado por IA está rodando em produção agora e quem é responsável por seu comportamento?”

Os CISOs precisam responder: “Podemos identificar cada instância de código gerado por IA, rastrear quem o aprovou, demonstrar como foi revisado e explicar quais barreiras impediram que ele tocasse sistemas de alto risco.”

Se você não pode responder a essa pergunta, você não tem governança. Você tem uma ficção bem escrita.