UK und EU: Wie ein Problem wie Grok gelöst werden kann

Am 3. Februar eröffnete das UK Information Commissioner’s Office eine formelle Untersuchung gegen xAI in Bezug auf die Verarbeitung personenbezogener Daten bei der Erstellung von nicht einvernehmlichen sexualisierten Bildern durch Grok. Das ICO überprüft, ob Grok die UK-Datenschutzgesetze eingehalten hat. Sollte xAI personenbezogene Daten rechtswidrig verarbeitet haben, kann das ICO gemäß dem Data Protection Act 2018 und dem UK GDPR eine Geldbuße von bis zu 17,5 Millionen Pfund oder 4 % des weltweiten Jahresumsatzes von xAI verhängen (je nachdem, welcher Betrag höher ist).

Dies folgt auf die Eröffnung einer Untersuchung durch Ofcom im Rahmen des Online Safety Act 2023, der das Teilen intimer Deepfakes ohne Zustimmung kriminalisiert. Ein weiteres Gesetz, das in dieser Untersuchung eine Rolle spielt, ist das Data (Use and Access) Act 2025, das es zu einem Straftatbestand macht, Deepfake-Inhalte von Erwachsenen im UK zu erstellen oder anzufordern – bisher jedoch nicht, die Technologie bereitzustellen, die die Erstellung von Deepfakes ermöglicht. Die Labour-Regierung plant jedoch, das Gesetz weiter zu ändern.

Unterschiedliche Ansätze in der Gesetzgebung

Die Untersuchung von Groks Einhaltung des UK-Datenschutzrechts folgt auf Razzien französischer Staatsanwälte im Cybercrime-Büro, die am selben Tag in den Büros von X in Paris stattfanden, sowie auf die formelle Eröffnung einer Untersuchung durch die Europäische Kommission unter dem Digital Services Act, um zu bewerten, ob das Unternehmen systemische Risiken im Zusammenhang mit Grok, einschließlich der Verbreitung illegaler Inhalte und geschlechtsspezifischer Gewalt, gemindert hat.

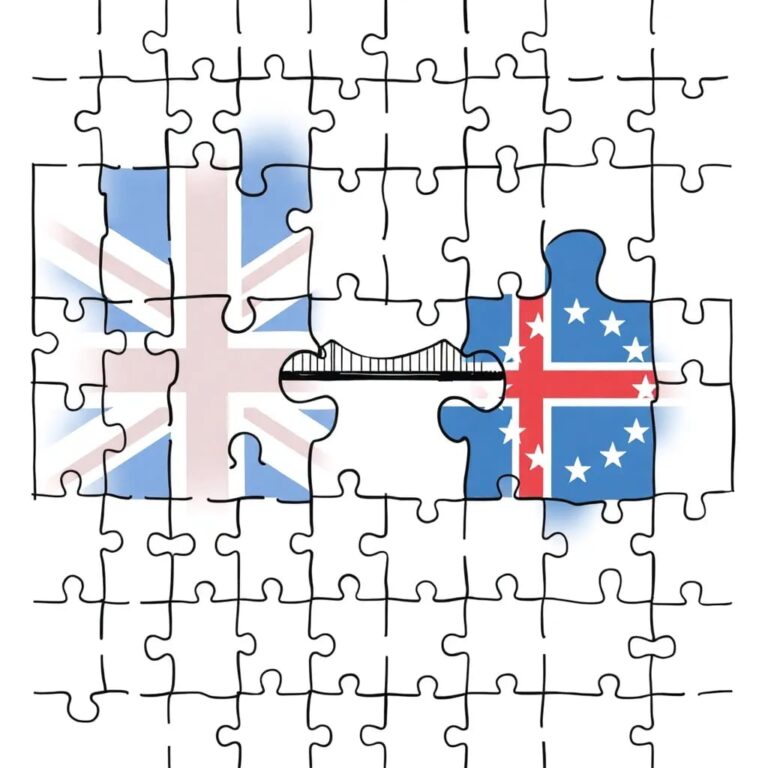

Die Durchsetzungsmaßnahmen gegen Grok zeigen den unterschiedlichen Fokus der britischen und der EU-Datenschutz- und Online-Sicherheitsregime auf – der britische Ansatz, typisch für eine Common-Law-Rechtsordnung, konzentriert sich auf die Bekämpfung spezifischer Schäden. Der EU-Ansatz hingegen fokussiert sich auf den Aufbau eines präventiven Rahmens für das Management systemischer Risiken.

Die Herausforderungen der Regulierung

Der Brussels Effect war erfolgreich, um die Datenschutzbedenken der Ära des „Überwachungs-Kapitalismus“ zu adressieren, hat jedoch Schwierigkeiten, mit der Geschwindigkeit der KI-Entwicklung Schritt zu halten. Dies führte dazu, dass die Europäische Kommission im November 2025 den Vorschlag für die “Digital Omnibus”-Verordnung präsentierte, um die Verabschiedung von Teilen des AI Act bezüglich biometrischer ID bis Dezember 2027 zu verzögern und die DSGVO zu ändern, um zuzulassen, dass KI-Modelle mit europäischen Daten trainiert werden. Dies wird weithin als ein Schritt in Richtung Deregulierung angesehen.

Die UK-Behörden reagierten schnell auf das Problem der Deepfakes, wobei das ICO sowohl xAI (den Technologieentwickler) als auch X (die Plattform/Verteiler) ins Visier nahm. Dies zeigt, dass die Durchsetzung auf verschiedenen Ebenen des Datenzyklus erfolgt. Aufgrund des Common-Law-Erbes ist das UK möglicherweise flexibler in der Reaktion auf spezifische Fälle von Online-Schäden, während das EU-System bessere Strukturen für die Durchsetzung einheitlicher Standards über einen längeren Zeitraum bietet.

Schlussfolgerung

Der britische Ansatz zur Bekämpfung von Deepfakes konzentriert sich darauf, das Erstellen und Verbreiten einzelner Deepfake-Bilder rechtlich herausfordernd zu gestalten. Der EU-Ansatz hingegen konzentriert sich auf die prozeduralen Mängel von X bei der Risikobewertung seiner Software vor der Bereitstellung. Beide Systeme, mit ihren unterschiedlichen Schwerpunkten, können zusammen eine umfassende Möglichkeit bieten, um gemeinsame Standards durchzusetzen und die Rechte des Einzelnen gegenüber großen Unternehmen zu schützen.